–†–∞–±–Њ—В–∞ —Б Postgresql: –љ–∞—Б—В—А–Њ–є–Ї–∞, –Љ–∞—Б—И—В–∞–±–Є—А–Њ–≤–∞–љ–Є–µ

=0.1

–Т–∞—Б–Є–ї—М–µ–≤ –Р.–Ѓ.

–†–∞–±–Њ—В–∞ —Б Postgresql

–љ–∞—Б—В—А–Њ–є–Ї–∞, –Љ–∞—Б—И—В–∞–±–Є—А–Њ–≤–∞–љ–Є–µ

—Б–њ—А–∞–≤–Њ—З–љ–Њ–µ –њ–Њ—Б–Њ–±–Є–µ

2010

CREATIVE COMMONS ATTRIBUTION-NONCOMMERCIAL 2.5

–Я—А–Є –љ–∞–њ–Є—Б–∞–љ–Є–Є –Ї–љ–Є–≥–Є(–Љ–∞–љ—Г–∞–ї–∞, –Є–ї–Є –њ—А–Њ—Б—В–Њ —И–њ–∞—А–≥–∞–ї–Ї–Є) –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–ї–Є—Б—М –Љ–∞—В–µ—А–Є–∞–ї—Л:

- PostgreSQL: –љ–∞—Б—В—А–Њ–є–Ї–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є. –Р–ї–µ–Ї—Б–µ–є –С–Њ—А–Ј–Њ–≤ (Sad Spirit) borz_off@cs.msu.su,

http://www.phpclub.ru/detail/store/pdf/postgresql-performance.pdf - –Э–∞—Б—В—А–Њ–є–Ї–∞ —А–µ–њ–ї–Є–Ї–∞—Ж–Є–Є –≤ PostgreSQL —Б –њ–Њ–Љ–Њ—Й—М—О —Б–Є—Б—В–µ–Љ—Л Slony-I, Eugene Kuzin eugene@kuzin.net,

http://www.kuzin.net/work/sloniki-privet.html - –£—Б—В–∞–љ–Њ–≤–Ї–∞ Londiste –≤ –њ–Њ–і—А–Њ–±–љ–Њ—Б—В—П—Е, Sergey Konoplev gray.ru@gmail.com,

http://gray-hemp.blogspot.com/2010/04/londiste.html - –£—З–µ–±–љ–Њ–µ —А—Г–Ї–Њ–≤–Њ–і—Б—В–≤–Њ –њ–Њ pgpool-II, Dmitry Stasyuk,

http://undenied.ru/2009/03/04/uchebnoe-rukovodstvo-po-pgpool-ii/ - –У–Њ—А–Є–Ј–Њ–љ—В–∞–ї—М–љ–Њ–µ –Љ–∞—Б—И—В–∞–±–Є—А–Њ–≤–∞–љ–Є–µ PostgreSQL —Б –њ–Њ–Љ–Њ—Й—М—О PL/Proxy, –І–Є—А–Ї–Є–љ –Ф–Є–Љ–∞ dmitry.chirkin@gmail.com,

http://habrahabr.ru/blogs/postgresql/45475/ - Hadoop, –Ш–≤–∞–љ –С–ї–Є–љ–Ї–Њ–≤ wordpress@insight-it.ru,

http://www.insight-it.ru/masshtabiruemost/hadoop/ - Up and Running with HadoopDB, Padraig O'Sullivan,

http://posulliv.github.com/2010/05/10/hadoopdb-mysql.html - –Ь–∞—Б—И—В–∞–±–Є—А–Њ–≤–∞–љ–Є–µ PostgreSQL: –≥–Њ—В–Њ–≤—Л–µ —А–µ—И–µ–љ–Є—П –Њ—В Skype, –Ш–≤–∞–љ –Ч–Њ–ї–Њ—В—Г—Е–Є–љ,

http://postgresmen.ru/articles/view/25 - Streaming Replication,

http://wiki.postgresql.org/wiki/Streaming_Replication - –®–∞—А–і–Є–љ–≥, –њ–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ, —А–µ–њ–ї–Є–Ї–∞—Ж–Є—П - –Ј–∞—З–µ–Љ –Є –Ї–Њ–≥–і–∞?, Den Golotyuk,

http://highload.com.ua/index.php/2009/05/06/—И–∞—А–і–Є–љ–≥-–њ–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ-—А–µ–њ–ї–Є–Ї–∞—Ж/

ell

Contents

- 1 –Т–≤–µ–і–µ–љ–Є–µ

- 2 –Э–∞—Б—В—А–Њ–є–Ї–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є

- 1 –Т–≤–µ–і–µ–љ–Є–µ

- 2 –Э–∞—Б—В—А–Њ–є–Ї–∞ —Б–µ—А–≤–µ—А–∞

- 3 –Ф–Є—Б–Ї–Є –Є —Д–∞–є–ї–Њ–≤—Л–µ —Б–Є—Б—В–µ–Љ—Л

- 4 –Я—А–Є–Љ–µ—А—Л –љ–∞—Б—В—А–Њ–µ–Ї

- 1 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–є –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є

- 2 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П –Њ–Ї–Њ–љ–љ–Њ–≥–Њ –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П (1–°), 2 –У–С –њ–∞–Љ—П—В–Є

- 3 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П Web –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, 2 –У–С –њ–∞–Љ—П—В–Є

- 4 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П Web –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, 8 –У–С –њ–∞–Љ—П—В–Є

- 5 –Р–≤—В–Њ–Љ–∞—В–Є—З–µ—Б–Ї–Њ–µ —Б–Њ–Ј–і–∞–љ–Є–µ –Њ–њ—В–Є–Љ–∞–ї—М–љ—Л—Е –љ–∞—Б—В—А–Њ–µ–Ї: pgtune

- 6 –Ю–њ—В–Є–Љ–Є–Ј–∞—Ж–Є—П –С–Ф –Є –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П

- 7 –Ч–∞–Ї–ї—О—З–µ–љ–Є–µ

- 3 –Я–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ

- 1 –Т–≤–µ–і–µ–љ–Є–µ

- 2 –Ґ–µ–Њ—А–Є—П

- 3 –Я—А–∞–Ї—В–Є–Ї–∞ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П

- 4 –Ч–∞–Ї–ї—О—З–µ–љ–Є–µ

- 4 –†–µ–њ–ї–Є–Ї–∞—Ж–Є—П

- 5 –®–∞—А–і–Є–љ–≥

- 6 –Ь—Г–ї—М—В–Є–њ–ї–µ–Ї—Б–Њ—А—Л —Б–Њ–µ–і–Є–љ–µ–љ–Є–є

- 7 –С—Н–Ї–∞–њ –Є –≤–Њ—Б—Б—В–∞–љ–Њ–≤–ї–µ–љ–Є–µ PostgreSQL

1 –Т–≤–µ–і–µ–љ–Є–µ

–Ф–∞–љ–љ–∞—П –Ї–љ–Є–≥–∞ –љ–µ –і–∞–µ—В –Њ—В–≤–µ—В—Л –љ–∞ –≤—Б–µ –≤–Њ–њ—А–Њ—Б—Л –њ–Њ —А–∞–±–Њ—В–µ —Б PostgreSQL. –У–ї–∞–≤–љ–Њ–µ –µ—С –Ј–∞–і–∞–љ–Є–µ -- –њ–Њ–Ї–∞–Ј–∞—В—М –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В–Є PostgreSQL, –Љ–µ—В–Њ–і–Є–Ї–Є –љ–∞—Б—В—А–Њ–є–Ї–Є –Є –Љ–∞—Б—И—В–∞–±–Є—А—Г–µ–Љ–Њ—Б—В–Є —Н—В–Њ–є –°–£–С–Ф. –Т –ї—О–±–Њ–Љ —Б–ї—Г—З–∞–µ, –≤—Л–±–Њ—А –Љ–µ—В–Њ–і–∞ —А–µ—И–µ–љ–Є—П –њ–Њ—Б—В–∞–≤–ї–µ–љ–љ–Њ–є –Ј–∞–і–∞—З–Є –Њ—Б—В–∞–µ—В—Б—П –Ј–∞ —А–∞–Ј—А–∞–±–Њ—В—З–Є–Ї–Њ–Љ –Є–ї–Є –∞–і–Љ–Є–љ–Є—Б—В—А–∞—В–Њ—А–Њ–Љ –°–£–С–Ф.

2 –Э–∞—Б—В—А–Њ–є–Ї–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є

1 –Т–≤–µ–і–µ–љ–Є–µ

–°–Ї–Њ—А–Њ—Б—В—М —А–∞–±–Њ—В—Л, –≤–Њ–Њ–±—Й–µ –≥–Њ–≤–Њ—А—П, –љ–µ —П–≤–ї—П–µ—В—Б—П –Њ—Б–љ–Њ–≤–љ–Њ–є –њ—А–Є—З–Є–љ–Њ–є –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П —А–µ–ї—П—Ж–Є–Њ–љ–љ—Л—Е –°–£–С–Ф. –С–Њ–ї–µ–µ —В–Њ–≥–Њ, –њ–µ—А–≤—Л–µ —А–µ–ї—П—Ж–Є–Њ–љ–љ—Л–µ –±–∞–Ј—Л —А–∞–±–Њ—В–∞–ї–Є –Љ–µ–і–ї–µ–љ–љ–µ–µ —Б–≤–Њ–Є—Е –њ—А–µ–і—И–µ—Б—В–≤–µ–љ–љ–Є–Ї–Њ–≤. –Т—Л–±–Њ—А —Н—В–Њ–є —В–µ—Е–љ–Њ–ї–Њ–≥–Є–Є –±—Л–ї –≤—Л–Ј–≤–∞–љ —Б–Ї–Њ—А–µ–µ- –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В—М—О –≤–Њ–Ј–ї–Њ–ґ–Є—В—М –њ–Њ–і–і–µ—А–ґ–Ї—Г —Ж–µ–ї–Њ—Б—В–љ–Њ—Б—В–Є –і–∞–љ–љ—Л—Е –љ–∞ –°–£–С–Ф;

- –љ–µ–Ј–∞–≤–Є—Б–Є–Љ–Њ—Б—В—М—О –ї–Њ–≥–Є—З–µ—Б–Ї–Њ–є —Б—В—А—Г–Ї—В—Г—А—Л –і–∞–љ–љ—Л—Е –Њ—В —Д–Є–Ј–Є—З–µ—Б–Ї–Њ–є.

–≠—В–Є –Њ—Б–Њ–±–µ–љ–љ–Њ—Б—В–Є –њ–Њ–Ј–≤–Њ–ї—П—О—В —Б–Є–ї—М–љ–Њ —Г–њ—А–Њ—Б—В–Є—В—М –љ–∞–њ–Є—Б–∞–љ–Є–µ –њ—А–Є–ї–Њ–ґ–µ–љ–Є–є, –љ–Њ —В—А–µ–±—Г—О—В –і–ї—П —Б–≤–Њ–µ–є —А–µ–∞–ї–Є–Ј–∞—Ж–Є–Є –і–Њ–њ–Њ–ї–љ–Є—В–µ–ї—М–љ—Л—Е —А–µ—Б—Г—А—Б–Њ–≤.

–Ґ–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, –њ—А–µ–ґ–і–µ, —З–µ–Љ –Є—Б–Ї–∞—В—М –Њ—В–≤–µ—В –љ–∞ –≤–Њ–њ—А–Њ—Б «–Ї–∞–Ї –Ј–∞—Б—В–∞–≤–Є—В—М –†–°–£–С–Ф —А–∞–±–Њ—В–∞—В—М –±—Л—Б—В—А–µ–µ –≤ –Љ–Њ–µ–є –Ј–∞–і–∞—З–µ?» —Б–ї–µ–і—Г–µ—В –Њ—В–≤–µ—В–Є—В—М –љ–∞ –≤–Њ–њ—А–Њ—Б «–љ–µ—В –ї–Є –±–Њ–ї–µ–µ –њ–Њ–і—Е–Њ–і—П—Й–µ–≥–Њ —Б—А–µ–і—Б—В–≤–∞ –і–ї—П —А–µ—И–µ–љ–Є—П –Љ–Њ–µ–є –Ј–∞–і–∞—З–Є, —З–µ–Љ –†–°–£–С–Ф?» –Ш–љ–Њ–≥–і–∞ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –і—А—Г–≥–Њ–≥–Њ —Б—А–µ–і—Б—В–≤–∞ –њ–Њ—В—А–µ–±—Г–µ—В –Љ–µ–љ—М—И–µ —Г—Б–Є–ї–Є–є, —З–µ–Љ –љ–∞—Б—В—А–Њ–є–Ї–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є.

–Ф–∞–љ–љ–∞—П –≥–ї–∞–≤–∞ –њ–Њ—Б–≤—П—Й–µ–љ–∞ –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В—П–Љ –њ–Њ–≤—Л—И–µ–љ–Є—П –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є PostgreSQL. –У–ї–∞–≤–∞ –љ–µ –њ—А–µ—В–µ–љ–і—Г–µ—В –љ–∞ –Є—Б—З–µ—А–њ—Л–≤–∞—О—Й–µ–µ –Є–Ј–ї–Њ–ґ–µ–љ–Є–µ –≤–Њ–њ—А–Њ—Б–∞, –љ–∞–Є–±–Њ–ї–µ–µ –њ–Њ–ї–љ—Л–Љ –Є —В–Њ—З–љ—Л–Љ —А—Г–Ї–Њ–≤–Њ–і—Б—В–≤–Њ–Љ –њ–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—О PostgreSQL —П–≤–ї—П–µ—В—Б—П, –Ї–Њ–љ–µ—З–љ–Њ, –Њ—Д–Є—Ж–Є–∞–ї—М–љ–∞—П –і–Њ–Ї—Г–Љ–µ–љ—В–∞—Ж–Є—П –Є –Њ—Д–Є—Ж–Є–∞–ї—М–љ—Л–є FAQ. –Ґ–∞–Ї–ґ–µ —Б—Г—Й–µ—Б—В–≤—Г–µ—В –∞–љ–≥–ї–Њ—П–Ј—Л—З–љ—Л–є —Б–њ–Є—Б–Њ–Ї —А–∞—Б—Б—Л–ї–Ї–Є postgresql-performance, –њ–Њ—Б–≤—П—Й—С–љ–љ—Л–є –Є–Љ–µ–љ–љ–Њ —Н—В–Є–Љ –≤–Њ–њ—А–Њ—Б–∞–Љ. –У–ї–∞–≤–∞ —Б–Њ—Б—В–Њ–Є—В –Є–Ј –і–≤—Г—Е —А–∞–Ј–і–µ–ї–Њ–≤, –њ–µ—А–≤—Л–є –Є–Ј –Ї–Њ—В–Њ—А—Л—Е –Њ—А–Є–µ–љ—В–Є—А–Њ–≤–∞–љ —Б–Ї–Њ—А–µ–µ –љ–∞ –∞–і–Љ–Є–љ–Є—Б—В—А–∞—В–Њ—А–∞, –≤—В–Њ—А–Њ–є -- –љ–∞ —А–∞–Ј—А–∞–±–Њ—В—З–Є–Ї–∞ –њ—А–Є–ї–Њ–ґ–µ–љ–Є–є. –†–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П –њ—А–Њ—З–µ—Б—В—М –Њ–±–∞ —А–∞–Ј–і–µ–ї–∞: –Њ—В–љ–µ—Б–µ–љ–Є–µ –Љ–љ–Њ–≥–Є—Е –≤–Њ–њ—А–Њ—Б–Њ–≤ –Ї –Ї–∞–Ї–Њ–Љ—Г-—В–Њ –Њ–і–љ–Њ–Љ—Г –Є–Ј –љ–Є—Е –≤–µ—Б—М–Љ–∞ —Г—Б–ї–Њ–≤–љ–Њ.

1 –Э–µ –Є—Б–њ–Њ–ї—М–Ј—Г–є—В–µ –љ–∞—Б—В—А–Њ–є–Ї–Є –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О

–Я–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О PostgreSQL —Б–Ї–Њ–љ—Д–Є–≥—Г—А–Є—А–Њ–≤–∞–љ —В–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, —З—В–Њ–±—Л –Њ–љ –Љ–Њ–≥ –±—Л—В—М –Ј–∞–њ—Г—Й–µ–љ –њ—А–∞–Ї—В–Є—З–µ—Б–Ї–Є –љ–∞ –ї—О–±–Њ–Љ –Ї–Њ–Љ–њ—М—О—В–µ—А–µ –Є –љ–µ —Б–ї–Є—И–Ї–Њ–Љ –Љ–µ—И–∞–ї –њ—А–Є —Н—В–Њ–Љ —А–∞–±–Њ—В–µ –і—А—Г–≥–Є—Е –њ—А–Є–ї–Њ–ґ–µ–љ–Є–є. –≠—В–Њ –Њ—Б–Њ–±–µ–љ–љ–Њ –Ї–∞—Б–∞–µ—В—Б—П –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ–Њ–є –њ–∞–Љ—П—В–Є. –Э–∞—Б—В—А–Њ–є–Ї–Є –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О –њ–Њ–і—Е–Њ–і—П—В —В–Њ–ї—М–Ї–Њ –і–ї—П —Б–ї–µ–і—Г—О—Й–µ–≥–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П: —Б –љ–Є–Љ–Є –≤—Л —Б–Љ–Њ–ґ–µ—В–µ –њ—А–Њ–≤–µ—А–Є—В—М, —А–∞–±–Њ—В–∞–µ—В –ї–Є —Г—Б—В–∞–љ–Њ–≤–Ї–∞ PostgreSQL, —Б–Њ–Ј–і–∞—В—М —В–µ—Б—В–Њ–≤—Г—О –±–∞–Ј—Г —Г—А–Њ–≤–љ—П –Ј–∞–њ–Є—Б–љ–Њ–є –Ї–љ–Є–ґ–Ї–Є –Є –њ–Њ—В—А–µ–љ–Є—А–Њ–≤–∞—В—М—Б—П –њ–Є—Б–∞—В—М –Ї –љ–µ–є –Ј–∞–њ—А–Њ—Б—Л. –Х—Б–ї–Є –≤—Л —Б–Њ–±–Є—А–∞–µ—В–µ—Б—М —А–∞–Ј—А–∞–±–∞—В—Л–≤–∞—В—М (–∞ —В–µ–Љ –±–Њ–ї–µ–µ –Ј–∞–њ—Г—Б–Ї–∞—В—М –≤ —А–∞–±–Њ—В—Г) —А–µ–∞–ї—М–љ—Л–µ –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, —В–Њ –љ–∞—Б—В—А–Њ–є–Ї–Є –њ—А–Є–і—С—В—Б—П —А–∞–і–Є–Ї–∞–ї—М–љ–Њ –Є–Ј–Љ–µ–љ–Є—В—М. –Т –і–Є—Б—В—А–Є–±—Г—В–Є–≤–µ PostgreSQL, –Ї —Б–Њ–ґ–∞–ї–µ–љ–Є—О, –љ–µ –њ–Њ—Б—В–∞–≤–ї—П–µ—В—Б—П —Д–∞–є–ї–Њ–≤ —Б «—А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ–Љ—Л–Љ–Є» –љ–∞—Б—В—А–Њ–є–Ї–∞–Љ–Є. –Т–Њ–Њ–±—Й–µ –≥–Њ–≤–Њ—А—П, —В–∞–Ї–Є–µ —Д–∞–є–ї—Л —Б–Њ–Ј–і–∞—В—М –≤–µ—Б—М–Љ–∞ —Б–ї–Њ–ґ–љ–Њ, —В.–Ї. –Њ–њ—В–Є–Љ–∞–ї—М–љ—Л–µ –љ–∞—Б—В—А–Њ–є–Ї–Є –Ї–Њ–љ–Ї—А–µ—В–љ–Њ–є —Г—Б—В–∞–љ–Њ–≤–Ї–Є PostgreSQL –±—Г–і—Г—В –Њ–њ—А–µ–і–µ–ї—П—В—М—Б—П:- –Ї–Њ–љ—Д–Є–≥—Г—А–∞—Ж–Є–µ–є –Ї–Њ–Љ–њ—М—О—В–µ—А–∞;

- –Њ–±—К—С–Љ–Њ–Љ –Є —В–Є–њ–Њ–Љ –і–∞–љ–љ—Л—Е, —Е—А–∞–љ—П—Й–Є—Е—Б—П –≤ –±–∞–Ј–µ;

- –Њ—В–љ–Њ—И–µ–љ–Є–µ–Љ —З–Є—Б–ї–∞ –Ј–∞–њ—А–Њ—Б–Њ–≤ –љ–∞ —З—В–µ–љ–Є–µ –Є –љ–∞ –Ј–∞–њ–Є—Б—М;

- —В–µ–Љ, –Ј–∞–њ—Г—Й–µ–љ—Л –ї–Є –і—А—Г–≥–Є–µ —В—А–µ–±–Њ–≤–∞—В–µ–ї—М–љ—Л–µ –Ї —А–µ—Б—Г—А—Б–∞–Љ –њ—А–Њ—Ж–µ—Б—Б—Л (–љ–∞–њ—А–Є–Љ–µ—А, –≤–µ–±—Б–µ—А–≤–µ—А).

2 –Ш—Б–њ–Њ–ї—М–Ј—Г–є—В–µ –∞–Ї—В—Г–∞–ї—М–љ—Г—О –≤–µ—А—Б–Є—О —Б–µ—А–≤–µ—А–∞

–Х—Б–ї–Є —Г –≤–∞—Б —Б—В–Њ–Є—В —Г—Б—В–∞—А–µ–≤—И–∞—П –≤–µ—А—Б–Є—П PostgreSQL, —В–Њ –љ–∞–Є–±–Њ–ї—М—И–µ–≥–Њ —Г—Б–Ї–Њ—А–µ–љ–Є—П —А–∞–±–Њ—В—Л –≤—Л —Б–Љ–Њ–ґ–µ—В–µ –і–Њ–±–Є—В—М—Б—П, –Њ–±–љ–Њ–≤–Є–≤ –µ—С –і–Њ —В–µ–Ї—Г—Й–µ–є. –£–Ї–∞–ґ–µ–Љ –ї–Є—И—М –љ–∞–Є–±–Њ–ї–µ–µ –Ј–љ–∞—З–Є—В–µ–ї—М–љ—Л–µ –Є–Ј —Б–≤—П–Ј–∞–љ–љ—Л—Е —Б –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М—О –Є–Ј–Љ–µ–љ–µ–љ–Є–є.- –Т –≤–µ—А—Б–Є–Є 7.1 –њ–Њ—П–≤–Є–ї—Б—П –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є, –і–Њ —В–Њ–≥–Њ –і–∞–љ–љ—Л–µ –≤ —В–∞–±–ї–Є—Ж—Г —Б–±—А–∞—Б—Л–≤–∞–ї–Є—Б—М –Ї–∞–ґ–і—Л–є —А–∞–Ј –њ—А–Є —Г—Б–њ–µ—И–љ–Њ–Љ –Ј–∞–≤–µ—А—И–µ–љ–Є–Є —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є.

- –Т –≤–µ—А—Б–Є–Є 7.2 –њ–Њ—П–≤–Є–ї–Є—Б—М:

- –љ–Њ–≤–∞—П –≤–µ—А—Б–Є—П –Ї–Њ–Љ–∞–љ–і—Л VACUUM, –љ–µ —В—А–µ–±—Г—О—Й–∞—П –±–ї–Њ–Ї–Є—А–Њ–≤–Ї–Є;

- –Ї–Њ–Љ–∞–љ–і–∞ ANALYZE, —Б—В—А–Њ—П—Й–∞—П –≥–Є—Б—В–Њ–≥—А–∞–Љ–Љ—Г —А–∞—Б–њ—А–µ–і–µ–ї–µ–љ–Є—П –і–∞–љ–љ—Л—Е –≤ —Б—В–Њ–ї–±—Ж–∞—Е, —З—В–Њ –њ–Њ–Ј–≤–Њ–ї—П–µ—В –≤—Л–±–Є—А–∞—В—М –±–Њ–ї–µ–µ –±—Л—Б—В—А—Л–µ –њ–ї–∞–љ—Л –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–Њ–≤;

- –њ–Њ–і—Б–Є—Б—В–µ–Љ–∞ —Б–±–Њ—А–∞ —Б—В–∞—В–Є—Б—В–Є–Ї–Є.

- –Т –≤–µ—А—Б–Є–Є 7.4 –±—Л–ї–∞ —Г—Б–Ї–Њ—А–µ–љ–∞ —А–∞–±–Њ—В–∞ –Љ–љ–Њ–≥–Є—Е —Б–ї–Њ–ґ–љ—Л—Е –Ј–∞–њ—А–Њ—Б–Њ–≤ (–≤–Ї–ї—О—З–∞—П –њ–µ—З–∞–ї—М–љ–Њ –Є–Ј–≤–µ—Б—В–љ—Л–µ –њ–Њ–і–Ј–∞–њ—А–Њ—Б—Л IN/NOT IN).

- –Т –≤–µ—А—Б–Є–Є 8.0 –±—Л–ї–Њ –≤–љ–µ–і—А–µ–љ–Њ –Љ–µ—В–Ї–Є –≤–Њ—Б—В–∞–љ–Њ–≤–ї–µ–љ–Є—П, —Г–ї—Г—З—И–µ–љ–Є–µ —Г–њ—А–∞–≤–ї–µ–љ–Є—П –±—Г—Д–µ—А–Њ–Љ, CHECKPOINT –Є VACUUM —Г–ї—Г—З—И–µ–љ—Л.

- –Т –≤–µ—А—Б–Є–Є 8.1 –±—Л–ї–Њ —Г–ї—Г—З—И–µ–љ–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ—Л–є –і–Њ—Б—В—Г–њ –Ї —А–∞–Ј–і–µ–ї—П–µ–Љ–Њ–є –њ–∞–Љ—П—В–Є, –∞–≤—В–Њ–Љ–∞—В–Є—З–µ—Б–Ї–Є –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –Є–љ–і–µ–Ї—Б–Њ–≤ –і–ї—П MIN() –Є MAX(), pg_autovacuum –≤–љ–µ–і—А–µ–љ –≤ —Б–µ—А–≤–µ—А (–∞–≤—В–Њ–Љ–∞—В–Є–Ј–Є—А–Њ–≤–∞–љ), –њ–Њ–≤—Л—И–µ–љ–Є–µ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є –і–ї—П —Б–µ–Ї—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–љ—Л—Е —В–∞–±–ї–Є—Ж.

- –Т –≤–µ—А—Б–Є–Є 8.2 –±—Л–ї–Њ —Г–ї—Г—З—И–µ–љ–Њ —Б–Ї–Њ—А–Њ—Б—В—М –Љ–љ–Њ–ґ–µ—Б—В–≤–∞ SQL –Ј–∞–њ—А–Њ—Б–Њ–≤, —Г—Б–Њ–≤–µ—А—И–µ–љ—Б—В–≤–Њ–≤–∞–љ —Б–∞–Љ —П–Ј—Л–Ї –Ј–∞–њ—А–Њ—Б–Њ–≤.

- –Т –≤–µ—А—Б–Є–Є 8.3 –≤–љ–µ–і—А–µ–љ –њ–Њ–ї–љ–Њ—В–µ–Ї—Б—В–Њ–≤—Л–є –њ–Њ–Є—Б–Ї, –њ–Њ–і–і–µ—А–ґ–Ї–∞ SQL/XML —Б—В–∞–љ–і–∞—А—В–∞, –њ–∞—А–∞–Љ–µ—В—А—Л –Ї–Њ–љ—Д–Є–≥—Г—А–∞—Ж–Є–Є —Б–µ—А–≤–µ—А–∞ –Љ–Њ–≥—Г—В –±—Л—В—М —Г—Б—В–∞–љ–Њ–≤–ї–µ–љ—Л –љ–∞ –Њ—Б–љ–Њ–≤–µ –Њ—В–і–µ–ї—М–љ—Л—Е —Д—Г–љ–Ї—Ж–Є–є.

- –Т –≤–µ—А—Б–Є–Є 8.4 –±—Л–ї–Њ –≤–љ–µ–і—А–µ–љ–Њ –Њ–±—Й–Є–µ —В–∞–±–ї–Є—З–љ—Л–µ –≤—Л—А–∞–ґ–µ–љ–Є—П, —А–µ–Ї—Г—А—Б–Є–≤–љ—Л–µ –Ј–∞–њ—А–Њ—Б—Л, –њ–∞—А–∞–ї–ї–µ–ї—М–љ–Њ–µ –≤–Њ—Б—Б—В–∞–љ–Њ–≤–ї–µ–љ–Є–µ, —Г–ї—Г—З—И–µ–љ–љ–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М –і–ї—П EXISTS/NOT EXISTS –Ј–∞–њ—А–Њ—Б–Њ–≤.

- –Т –≤–µ—А—Б–Є–Є 9.0 «—А–µ–њ–ї–Є–Ї–∞—Ж–Є—П –Є–Ј –Ї–Њ—А–Њ–±–Ї–Є», VACUUM/VACUUM FULL —Б—В–∞–ї–Є –±—Л—Б—В—А–µ–µ, —А–∞—Б—И–Є—А–µ–љ—Л —Е—А–∞–љ–Є–Љ—Л–µ –њ—А–Њ—Ж–µ–і—Г—А—Л.

3 –°—В–Њ–Є—В –ї–Є –і–Њ–≤–µ—А—П—В—М —В–µ—Б—В–∞–Љ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є

–Я–µ—А–µ–і —В–µ–Љ, –Ї–∞–Ї –Ј–∞–љ–Є–Љ–∞—В—М—Б—П –љ–∞—Б—В—А–Њ–є–Ї–Њ–є —Б–µ—А–≤–µ—А–∞, –≤–њ–Њ–ї–љ–µ –µ—Б—В–µ—Б—В–≤–µ–љ–љ–Њ –Њ–Ј–љ–∞–Ї–Њ–Љ–Є—В—М—Б—П —Б –Њ–њ—Г–±–ї–Є–Ї–Њ–≤–∞–љ–љ—Л–Љ–Є –і–∞–љ–љ—Л–Љ–Є –њ–Њ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є, –≤ —В–Њ–Љ —З–Є—Б–ї–µ –≤ —Б—А–∞–≤–љ–µ–љ–Є–Є —Б –і—А—Г–≥–Є–Љ–Є –°–£–С–Ф. –Ъ —Б–Њ–ґ–∞–ї–µ–љ–Є—О, –Љ–љ–Њ–≥–Є–µ —В–µ—Б—В—Л —Б–ї—Г–ґ–∞—В –љ–µ —Б—В–Њ–ї—М–Ї–Њ –і–ї—П –Њ–±–ї–µ–≥—З–µ–љ–Є—П –≤–∞—И–µ–≥–Њ –≤—Л–±–Њ—А–∞, —Б–Ї–Њ–ї—М–Ї–Њ –і–ї—П –њ—А–Њ–і–≤–Є–ґ–µ–љ–Є—П –Ї–Њ–љ–Ї—А–µ—В–љ—Л—Е –њ—А–Њ–і—Г–Ї—В–Њ–≤ –≤ –Ї–∞—З–µ—Б—В–≤–µ «—Б–∞–Љ—Л—Е –±—Л—Б—В—А—Л—Е». –Я—А–Є –Є–Ј—Г—З–µ–љ–Є–Є –Њ–њ—Г–±–ї–Є–Ї–Њ–≤–∞–љ–љ—Л—Е —В–µ—Б—В–Њ–≤ –≤ –њ–µ—А–≤—Г—О –Њ—З–µ—А–µ–і—М –Њ–±—А–∞—В–Є—В–µ –≤–љ–Є–Љ–∞–љ–Є–µ, —Б–Њ–Њ—В–≤–µ—В—Б—В–≤—Г–µ—В –ї–Є –≤–µ–ї–Є—З–Є–љ–∞ –Є —В–Є–њ –љ–∞–≥—А—Г–Ј–Ї–Є, –Њ–±—К—С–Љ –і–∞–љ–љ—Л—Е –Є —Б–ї–Њ–ґ–љ–Њ—Б—В—М –Ј–∞–њ—А–Њ—Б–Њ–≤ –≤ —В–µ—Б—В–µ —В–Њ–Љ—Г, —З—В–Њ –≤—Л —Б–Њ–±–Є—А–∞–µ—В–µ—Б—М –і–µ–ї–∞—В—М —Б –±–∞–Ј–Њ–є? –Я—Г—Б—В—М, –љ–∞–њ—А–Є–Љ–µ—А, –Њ–±—Л—З–љ–Њ–µ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –≤–∞—И–µ–≥–Њ –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П –њ–Њ–і—А–∞–Ј—Г–Љ–µ–≤–∞–µ—В –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ–Њ —А–∞–±–Њ—В–∞—О—Й–Є—Е –Ј–∞–њ—А–Њ—Б–Њ–≤ –љ–∞ –Њ–±–љ–Њ–≤–ї–µ–љ–Є–µ –Ї —В–∞–±–ї–Є—Ж–µ –≤ –Љ–Є–ї–ї–Є–Њ–љ—Л –Ј–∞–њ–Є—Б–µ–є. –Т —Н—В–Њ–Љ —Б–ї—Г—З–∞–µ –°–£–С–Ф, –Ї–Њ—В–Њ—А–∞—П –≤ –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ —А–∞–Ј –±—Л—Б—В—А–µ–µ –≤—Б–µ—Е –Њ—Б—В–∞–ї—М–љ—Л—Е –Є—Й–µ—В –Ј–∞–њ–Є—Б—М –≤ —В–∞–±–ї–Є—Ж–µ –≤ —В—Л—Б—П—З—Г –Ј–∞–њ–Є—Б–µ–є, –Љ–Њ–ґ–µ—В –Њ–Ї–∞–Ј–∞—В—М—Б—П –љ–µ –ї—Г—З—И–Є–Љ –≤—Л–±–Њ—А–Њ–Љ. –Э—Г –Є –љ–∞–Ї–Њ–љ–µ—Ж, –≤–µ—Й–Є, –Ї–Њ—В–Њ—А—Л–µ –і–Њ–ї–ґ–љ—Л —Б—А–∞–Ј—Г –љ–∞—Б—В–Њ—А–Њ–ґ–Є—В—М:- –Ґ–µ—Б—В–Є—А–Њ–≤–∞–љ–Є–µ —Г—Б—В–∞—А–µ–≤—И–µ–є –≤–µ—А—Б–Є–Є –°–£–С–Ф.

- –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –љ–∞—Б—В—А–Њ–µ–Ї –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О (–Є–ї–Є –Њ—В—Б—Г—В—Б—В–≤–Є–µ –Є–љ—Д–Њ—А–Љ–∞—Ж–Є–Є –Њ –љ–∞—Б—В—А–Њ–є–Ї–∞—Е).

- –Ґ–µ—Б—В–Є—А–Њ–≤–∞–љ–Є–µ –≤ –Њ–і–љ–Њ–њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—М—Б–Ї–Њ–Љ —А–µ–ґ–Є–Љ–µ (–µ—Б–ї–Є, –Ї–Њ–љ–µ—З–љ–Њ, –≤—Л –љ–µ –њ—А–µ–і–њ–Њ–ї–∞–≥–∞–µ—В–µ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –°–£–С–Ф –Є–Љ–µ–љ–љ–Њ —В–∞–Ї).

- –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ —А–∞—Б—И–Є—А–µ–љ–љ—Л—Е –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В–µ–є –Њ–і–љ–Њ–є –°–£–С–Ф –њ—А–Є –Є–≥–љ–Њ—А–Є—А–Њ–≤–∞–љ–Є–Є —А–∞—Б—И–Є—А–µ–љ–љ—Л—Е –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В–µ–є –і—А—Г–≥–Њ–є.

- –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –Ј–∞–≤–µ–і–Њ–Љ–Њ –Љ–µ–і–ї–µ–љ–љ–Њ —А–∞–±–Њ—В–∞—О—Й–Є—Е –Ј–∞–њ—А–Њ—Б–Њ–≤ (—Б–Љ. –њ—Г–љ–Ї—В 3.4).

2 –Э–∞—Б—В—А–Њ–є–Ї–∞ —Б–µ—А–≤–µ—А–∞

–Т —Н—В–Њ–Љ —А–∞–Ј–і–µ–ї–µ –Њ–њ–Є—Б–∞–љ—Л —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ–Љ—Л–µ –Ј–љ–∞—З–µ–љ–Є—П –њ–∞—А–∞–Љ–µ—В—А–Њ–≤, –≤–ї–Є—П—О—Й–Є—Е –љ–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М –°–£–С–Ф. –≠—В–Є –њ–∞—А–∞–Љ–µ—В—А—Л –Њ–±—Л—З–љ–Њ —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—О—В—Б—П –≤ –Ї–Њ–љ—Д–Є–≥—Г—А–∞—Ж–Є–Њ–љ–љ–Њ–Љ —Д–∞–є–ї–µ postgresql.conf –Є –≤–ї–Є—П—О—В –љ–∞ –≤—Б–µ –±–∞–Ј—Л –≤ —В–µ–Ї—Г—Й–µ–є —Г—Б—В–∞–љ–Њ–≤–Ї–µ.

1 –Ш—Б–њ–Њ–ї—М–Ј—Г–µ–Љ–∞—П –њ–∞–Љ—П—В—М

1 –Ю–±—Й–Є–є –±—Г—Д–µ—А —Б–µ—А–≤–µ—А–∞: shared_buffers

PostgreSQL –љ–µ —З–Є—В–∞–µ—В –і–∞–љ–љ—Л–µ –љ–∞–њ—А—П–Љ—Г—О —Б –і–Є—Б–Ї–∞ –Є –љ–µ –њ–Є—И–µ—В –Є—Е —Б—А–∞–Ј—Г –љ–∞ –і–Є—Б–Ї. –Ф–∞–љ–љ—Л–µ –Ј–∞–≥—А—Г–ґ–∞—О—В—Б—П –≤ –Њ–±—Й–Є–є –±—Г—Д–µ—А —Б–µ—А–≤–µ—А–∞, –љ–∞—Е–Њ–і—П—Й–Є–є—Б—П –≤ —А–∞–Ј–і–µ–ї—П–µ–Љ–Њ–є –њ–∞–Љ—П—В–Є, —Б–µ—А–≤–µ—А–љ—Л–µ –њ—А–Њ—Ж–µ—Б—Б—Л —З–Є—В–∞—О—В –Є –њ–Є—И—Г—В –±–ї–Њ–Ї–Є –≤ —Н—В–Њ–Љ –±—Г—Д–µ—А–µ, –∞ –Ј–∞—В–µ–Љ —Г–ґ–µ –Є–Ј–Љ–µ–љ–µ–љ–Є—П —Б–±—А–∞—Б—Л–≤–∞—О—В—Б—П –љ–∞ –і–Є—Б–Ї.–Х—Б–ї–Є –њ—А–Њ—Ж–µ—Б—Б—Г –љ—Г–ґ–µ–љ –і–Њ—Б—В—Г–њ –Ї —В–∞–±–ї–Є—Ж–µ, —В–Њ –Њ–љ —Б–љ–∞—З–∞–ї–∞ –Є—Й–µ—В –љ—Г–ґ–љ—Л–µ –±–ї–Њ–Ї–Є –≤ –Њ–±—Й–µ–Љ –±—Г—Д–µ—А–µ. –Х—Б–ї–Є –±–ї–Њ–Ї–Є –њ—А–Є—Б—Г—В—Б—В–≤—Г—О—В, —В–Њ –Њ–љ –Љ–Њ–ґ–µ—В –њ—А–Њ–і–Њ–ї–ґ–∞—В—М —А–∞–±–Њ—В—Г, –µ—Б–ї–Є –љ–µ—В -- –і–µ–ї–∞–µ—В—Б—П —Б–Є—Б—В–µ–Љ–љ—Л–є –≤—Л–Ј–Њ–≤ –і–ї—П –Є—Е –Ј–∞–≥—А—Г–Ј–Ї–Є. –Ч–∞–≥—А—Г–ґ–∞—В—М—Б—П –±–ї–Њ–Ї–Є –Љ–Њ–≥—Г—В –Ї–∞–Ї –Є–Ј —Д–∞–є–ї–Њ–≤–Њ–≥–Њ –Ї—Н—И–∞ –Ю–°, —В–∞–Ї –Є —Б –і–Є—Б–Ї–∞, –Є —Н—В–∞ –Њ–њ–µ—А–∞—Ж–Є—П –Љ–Њ–ґ–µ—В –Њ–Ї–∞–Ј–∞—В—М—Б—П –≤–µ—Б—М–Љ–∞ «–і–Њ—А–Њ–≥–Њ–є».

–Х—Б–ї–Є –Њ–±—К—С–Љ –±—Г—Д–µ—А–∞ –љ–µ–і–Њ—Б—В–∞—В–Њ—З–µ–љ –і–ї—П —Е—А–∞–љ–µ–љ–Є—П —З–∞—Б—В–Њ –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л—Е —А–∞–±–Њ—З–Є—Е –і–∞–љ–љ—Л—Е, —В–Њ –Њ–љ–Є –±—Г–і—Г—В –њ–Њ—Б—В–Њ—П–љ–љ–Њ –њ–Є—Б–∞—В—М—Б—П –Є —З–Є—В–∞—В—М—Б—П –Є–Ј –Ї—Н—И–∞ –Ю–° –Є–ї–Є —Б –і–Є—Б–Ї–∞, —З—В–Њ –Ї—А–∞–є–љ–µ –Њ—В—А–Є—Ж–∞—В–µ–ї—М–љ–Њ —Б–Ї–∞–ґ–µ—В—Б—П –љ–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є.

–Т —В–Њ –ґ–µ –≤—А–µ–Љ—П –љ–µ —Б–ї–µ–і—Г–µ—В —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М —Н—В–Њ –Ј–љ–∞—З–µ–љ–Є–µ —Б–ї–Є—И–Ї–Њ–Љ –±–Њ–ї—М—И–Є–Љ: —Н—В–Њ –Э–Х –≤—Б—П –њ–∞–Љ—П—В—М, –Ї–Њ—В–Њ—А–∞—П –љ—Г–ґ–љ–∞ –і–ї—П —А–∞–±–Њ—В—Л PostgreSQL, —Н—В–Њ —В–Њ–ї—М–Ї–Њ —А–∞–Ј–Љ–µ—А —А–∞–Ј–і–µ–ї—П–µ–Љ–Њ–є –Љ–µ–ґ–і—Г –њ—А–Њ—Ж–µ—Б—Б–∞–Љ–Є PostgreSQL –њ–∞–Љ—П—В–Є, –Ї–Њ—В–Њ—А–∞—П –љ—Г–ґ–љ–∞ –і–ї—П –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –∞–Ї—В–Є–≤–љ—Л—Е –Њ–њ–µ—А–∞—Ж–Є–є. –Ю–љ–∞ –і–Њ–ї–ґ–љ–∞ –Ј–∞–љ–Є–Љ–∞—В—М –Љ–µ–љ—М—И—Г—О —З–∞—Б—В—М –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є –≤–∞—И–µ–≥–Њ –Ї–Њ–Љ–њ—М—О—В–µ—А–∞, —В–∞–Ї –Ї–∞–Ї PostgreSQL –њ–Њ–ї–∞–≥–∞–µ—В—Б—П –љ–∞ —В–Њ, —З—В–Њ –Њ–њ–µ—А–∞—Ж–Є–Њ–љ–љ–∞—П —Б–Є—Б—В–µ–Љ–∞ –Ї—Н—И–Є—А—Г–µ—В —Д–∞–є–ї—Л, –Є –љ–µ —Б—В–∞—А–∞–µ—В—Б—П –і—Г–±–ї–Є—А–Њ–≤–∞—В—М —Н—В—Г —А–∞–±–Њ—В—Г. –Ъ—А–Њ–Љ–µ —В–Њ–≥–Њ, —З–µ–Љ –±–Њ–ї—М—И–µ –њ–∞–Љ—П—В–Є –±—Г–і–µ—В –Њ—В–і–∞–љ–Њ –њ–Њ–і –±—Г—Д–µ—А, —В–µ–Љ –Љ–µ–љ—М—И–µ –Њ—Б—В–∞–љ–µ—В—Б—П –Њ–њ–µ—А–∞—Ж–Є–Њ–љ–љ–Њ–є —Б–Є—Б—В–µ–Љ–µ –Є –і—А—Г–≥–Є–Љ –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П–Љ, —З—В–Њ –Љ–Њ–ґ–µ—В –њ—А–Є–≤–µ—Б—В–Є –Ї —Б–≤–Њ–њ–њ–Є–љ–≥—Г.

–Ъ —Б–Њ–ґ–∞–ї–µ–љ–Є—О, —З—В–Њ–±—Л –Ј–љ–∞—В—М —В–Њ—З–љ–Њ–µ —З–Є—Б–ї–Њ shared_buffers, –љ—Г–ґ–љ–Њ —Г—З–µ—Б—В—М –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є –Ї–Њ–Љ–њ—М—О—В–µ—А–∞, —А–∞–Ј–Љ–µ—А –±–∞–Ј—Л –і–∞–љ–љ—Л—Е, —З–Є—Б–ї–Њ —Б–Њ–µ–і–Є–љ–µ–љ–Є–є –Є —Б–ї–Њ–ґ–љ–Њ—Б—В—М –Ј–∞–њ—А–Њ—Б–Њ–≤, —В–∞–Ї —З—В–Њ –ї—Г—З—И–µ –≤–Њ—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Б—П –љ–µ—Б–Ї–Њ–ї—М–Ї–Є–Љ–Є –њ—А–Њ—Б—В—Л–Љ–Є –њ—А–∞–≤–Є–ї–∞–Љ–Є –љ–∞—Б—В—А–Њ–є–Ї–Є.

–Э–∞ –≤—Л–і–µ–ї–µ–љ–љ—Л—Е —Б–µ—А–≤–µ—А–∞—Е –њ–Њ–ї–µ–Ј–љ—Л–Љ –Њ–±—К–µ–Љ–Њ–Љ –±—Г–і–µ—В –Ј–љ–∞—З–µ–љ–Є–µ –Њ—В 8 –Ь–С –і–Њ 2 –У–С. –Ю–±—К–µ–Љ –Љ–Њ–ґ–µ—В –±—Л—В—М –≤—Л—И–µ, –µ—Б–ї–Є —Г –≤–∞—Б –±–Њ–ї—М—И–Є–µ –∞–Ї—В–Є–≤–љ—Л–µ –њ–Њ—А—Ж–Є–Є –±–∞–Ј—Л –і–∞–љ–љ—Л—Е, —Б–ї–Њ–ґ–љ—Л–µ –Ј–∞–њ—А–Њ—Б—Л, –±–Њ–ї—М—И–Њ–µ —З–Є—Б–ї–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ—Л—Е —Б–Њ–µ–і–Є–љ–µ–љ–Є–є, –і–ї–Є—В–µ–ї—М–љ—Л–µ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є, –≤–∞–Љ –і–Њ—Б—В—Г–њ–µ–љ –±–Њ–ї—М—И–Њ–є –Њ–±—К–µ–Љ –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є –Є–ї–Є –±–Њ–ї—М—И–µ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ—А–Њ—Ж–µ—Б—Б–Њ—А–Њ–≤. –Ш, –Ї–Њ–љ–µ—З–љ–Њ –ґ–µ, –љ–µ –Ј–∞–±—Л–≤–∞–µ–Љ –Њ–± –Њ—Б—В–∞–ї—М–љ—Л—Е –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П—Е. –Т—Л–і–µ–ї–Є–≤ —Б–ї–Є—И–Ї–Њ–Љ –Љ–љ–Њ–≥–Њ –њ–∞–Љ—П—В–Є –і–ї—П –±–∞–Ј—Л –і–∞–љ–љ—Л—Е, –Љ—Л –Љ–Њ–ґ–µ–Љ –њ–Њ–ї—Г—З–Є—В—М —Г—Е—Г–і—И–µ–љ–Є–µ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є. –Т –Ї–∞—З–µ—Б—В–≤–µ –љ–∞—З–∞–ї—М–љ—Л—Е –Ј–љ–∞—З–µ–љ–Є–є –Љ–Њ–ґ–µ—В–µ –њ–Њ–њ—А–Њ–±–Њ–≤–∞—В—М —Б–ї–µ–і—Г—О—Й–Є–µ:

- –Э–∞—З–љ–Є—В–µ —Б 4 –Ь–С (512) –і–ї—П —А–∞–±–Њ—З–µ–є —Б—В–∞–љ—Ж–Є–Є

- –°—А–µ–і–љ–Є–є –Њ–±—К—С–Љ –і–∞–љ–љ—Л—Е –Є 256-512 –Ь–С –і–Њ—Б—В—Г–њ–љ–Њ–є –њ–∞–Љ—П—В–Є: 16-32 –Ь–С (2048-4096)

- –С–Њ–ї—М—И–Њ–є –Њ–±—К—С–Љ –і–∞–љ–љ—Л—Е –Є 1-4 –У–С –і–Њ—Б—В—Г–њ–љ–Њ–є –њ–∞–Љ—П—В–Є: 64-256 –Ь–С (8192-32768)

–Ф–ї—П —В–Њ–љ–Ї–Њ–є –љ–∞—Б—В—А–Њ–є–Ї–Є –њ–∞—А–∞–Љ–µ—В—А–∞ —Г—Б—В–∞–љ–Њ–≤–Є—В–µ –і–ї—П –љ–µ–≥–Њ –±–Њ–ї—М—И–Њ–µ –Ј–љ–∞—З–µ–љ–Є–µ –Є –њ–Њ—В–µ—Б—В–Є—А—Г–є—В–µ –±–∞–Ј—Г –њ—А–Є –Њ–±—Л—З–љ–Њ–є –љ–∞–≥—А—Г–Ј–Ї–µ.

–Я—А–Њ–≤–µ—А—П–є—В–µ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ —А–∞–Ј–і–µ–ї—П–µ–Љ–Њ–є –њ–∞–Љ—П—В–Є –њ—А–Є –њ–Њ–Љ–Њ—Й–Є ipcs –Є–ї–Є –і—А—Г–≥–Є—Е —Г—В–Є–ї–Є—В(–љ–∞–њ—А–Є–Љ–µ—А, free –Є–ї–Є vmstat).

–†–µ–Ї–Њ–Љ–µ–љ–і—Г–µ–Љ–Њ–µ –Ј–љ–∞—З–µ–љ–Є–µ –њ–∞—А–∞–Љ–µ—В—А–∞

–±—Г–і–µ—В –њ—А–Є–Љ–µ—А–љ–Њ –≤ 1,2 -2 —А–∞–Ј–∞ –±–Њ–ї—М—И–µ, —З–µ–Љ –Љ–∞–Ї—Б–Є–Љ—Г–Љ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–љ–Њ–є –њ–∞–Љ—П—В–Є. –Ю–±—А–∞—В–Є—В–µ –≤–љ–Є–Љ–∞–љ–Є–µ, —З—В–Њ –њ–∞–Љ—П—В—М –њ–Њ–і –±—Г—Д–µ—А

–≤—Л–і–µ–ї—П—В—Б—П –њ—А–Є –Ј–∞–њ—Г—Б–Ї–µ —Б–µ—А–≤–µ—А–∞, –Є –µ—С –Њ–±—К—С–Љ –њ—А–Є —А–∞–±–Њ—В–µ –љ–µ –Є–Ј–Љ–µ–љ—П–µ—В—Б—П. –£—З—В–Є—В–µ —В–∞–Ї–ґ–µ, —З—В–Њ –љ–∞—Б—В—А–Њ–є–Ї–Є —П–і—А–∞ –Њ–њ–µ—А–∞—Ж–Є–Њ–љ–љ–Њ–є

—Б–Є—Б—В–µ–Љ—Л –Љ–Њ–≥—Г—В –љ–µ –і–∞—В—М –≤–∞–Љ –≤—Л–і–µ–ї–Є—В—М –±–Њ–ї—М—И–Њ–є –Њ–±—К—С–Љ –њ–∞–Љ—П—В–Є. –Т —А—Г–Ї–Њ–≤–Њ–і—Б—В–≤–µ –∞–і–Љ–Є–љ–Є—Б—В—А–∞—В–Њ—А–∞ PostgreSQL –Њ–њ–Є—Б–∞–љ–Њ, –Ї–∞–Ї

–Љ–Њ–ґ–љ–Њ –Є–Ј–Љ–µ–љ–Є—В—М —Н—В–Є –љ–∞—Б—В—А–Њ–є–Ї–Є:

http://developer.postgresql.org/docs/postgres/kernel-resources.html

–Т–Њ—В –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ –њ—А–Є–Љ–µ—А–Њ–≤, –њ–Њ–ї—Г—З–µ–љ–љ—Л—Е –љ–∞ –ї–Є—З–љ–Њ–Љ –Њ–њ—Л—В–µ –Є –њ—А–Є —В–µ—Б—В–Є—А–Њ–≤–∞–љ–Є–Є:

- Laptop, Celeron processor, 384 –Ь–С RAM, –±–∞–Ј–∞ –і–∞–љ–љ—Л—Е 25 –Ь–С: 12 –Ь–С

- Athlon server, 1 –У–С RAM, –±–∞–Ј–∞ –і–∞–љ–љ—Л—Е –њ–Њ–і–і–µ—А–ґ–Ї–Є –њ—А–Є–љ—П—В–Є—П —А–µ—И–µ–љ–Є–є 10 –У–С: 200 –Ь–С

- Quad PIII server, 4 –У–С RAM, 40 –У–С, 150 —Б–Њ–µ–і–Є–љ–µ–љ–Є–є, «—В—П–ґ–µ–ї—Л–µ» —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є: 1 –У–С

- Quad Xeon server, 8 –У–С RAM, 200 –У–С, 300 —Б–Њ–µ–і–Є–љ–µ–љ–Є–є, «—В—П–ґ–µ–ї—Л–µ» —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є: 2 –У–С

2 –Я–∞–Љ—П—В—М –і–ї—П —Б–Њ—А—В–Є—А–Њ–≤–Ї–Є —А–µ–Ј—Г–ї—М—В–∞—В–∞ –Ј–∞–њ—А–Њ—Б–∞: work_mem

–†–∞–љ–µ–µ –Є–Ј–≤–µ—Б—В–љ–Њ–µ –Ї–∞–Ї sort_mem, –±—Л–ї–Њ –њ–µ—А–µ–Є–Љ–µ–љ–Њ–≤–∞–љ–Њ, —В–∞–Ї –Ї–∞–Ї —Б–µ–є—З–∞—Б –Њ–њ—А–µ–і–µ–ї—П–µ—В –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є, –Ї–Њ—В–Њ—А–Њ–µ –Љ–Њ–ґ–µ—В –≤—Л–і–µ–ї–Є—В—М –Њ–і–љ–∞ –Њ–њ–µ—А–∞—Ж–Є—П —Б–Њ—А—В–Є—А–Њ–≤–Ї–Є, –∞–≥—А–µ–≥–∞—Ж–Є–Є –Є –і—А. –≠—В–Њ –љ–µ —А–∞–Ј–і–µ–ї—П–µ–Љ–∞—П –њ–∞–Љ—П—В—М, work_mem –≤—Л–і–µ–ї—П–µ—В—Б—П –Њ—В–і–µ–ї—М–љ–Њ –љ–∞ –Ї–∞–ґ–і—Г—О –Њ–њ–µ—А–∞—Ж–Є—О (–Њ—В –Њ–і–љ–Њ–≥–Њ –і–Њ –љ–µ—Б–Ї–Њ–ї—М–Ї–Є—Е —А–∞–Ј –Ј–∞ –Њ–і–Є–љ –Ј–∞–њ—А–Њ—Б). –†–∞–Ј—Г–Љ–љ–Њ–µ –Ј–љ–∞—З–µ–љ–Є–µ –њ–∞—А–∞–Љ–µ—В—А–∞ –Њ–њ—А–µ–і–µ–ї—П–µ—В—Б—П —Б–ї–µ–і—Г—О—Й–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ: –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –і–Њ—Б—В—Г–њ–љ–Њ–є –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є (–њ–Њ—Б–ї–µ —В–Њ–≥–Њ, –Ї–∞–Ї –Є–Ј –Њ–±—Й–µ–≥–Њ –Њ–±—К–µ–Љ–∞ –≤—Л—З–ї–Є –њ–∞–Љ—П—В—М, —В—А–µ–±—Г–µ–Љ—Г—О –і–ї—П –і—А—Г–≥–Є—Е –њ—А–Є–ї–Њ–ґ–µ–љ–Є–є, –Є shared_buffers) –і–µ–ї–Є—В—Б—П –љ–∞ –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–µ —З–Є—Б–ї–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ—Л—Е –Ј–∞–њ—А–Њ—Б–Њ–≤ —Г–Љ–љ–Њ–ґ–µ–љ–љ–Њ–µ –љ–∞ —Б—А–µ–і–љ–µ–µ —З–Є—Б–ї–Њ –Њ–њ–µ—А–∞—Ж–Є–є –≤ –Ј–∞–њ—А–Њ—Б–µ, –Ї–Њ—В–Њ—А—Л–µ —В—А–µ–±—Г—О—В –њ–∞–Љ—П—В–Є.–Х—Б–ї–Є –Њ–±—К—С–Љ –њ–∞–Љ—П—В–Є –љ–µ–і–Њ—Б—В–∞—В–Њ—З–µ–љ –і–ї—П —Б–Њ—А—В–Є—А–Њ–Ї–Є –љ–µ–Ї–Њ—В–Њ—А–Њ–≥–Њ —А–µ–Ј—Г–ї—М—В–∞—В–∞, —В–Њ —Б–µ—А–≤–µ—А–љ—Л–є –њ—А–Њ—Ж–µ—Б—Б –±—Г–і–µ—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –≤—А–µ–Љ–µ–љ–љ—Л–µ —Д–∞–є–ї—Л. –Х—Б–ї–Є –ґ–µ –Њ–±—К—С–Љ –њ–∞–Љ—П—В–Є —Б–ї–Є—И–Ї–Њ–Љ –≤–µ–ї–Є–Ї, —В–Њ —Н—В–Њ –Љ–Њ–ґ–µ—В –њ—А–Є–≤–µ—Б—В–Є –Ї —Б–≤–Њ–њ–њ–Є–љ–≥—Г.

–Ю–±—К—С–Љ –њ–∞–Љ—П—В–Є –Ј–∞–і–∞—С—В—Б—П –њ–∞—А–∞–Љ–µ—В—А–Њ–Љ work_mem –≤ —Д–∞–є–ї–µ postgresql.conf. –Х–і–Є–љ–Є—Ж–∞ –Є–Ј–Љ–µ—А–µ–љ–Є—П –њ–∞—А–∞–Љ–µ—В—А–∞ -- 1 –Ї–С. –Ч–љ–∞—З–µ–љ–Є–µ –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О -- 1024. –Т –Ї–∞—З–µ—Б—В–≤–µ –љ–∞—З–∞–ї—М–љ–Њ–≥–Њ –Ј–љ–∞—З–µ–љ–Є—П –і–ї—П –њ–∞—А–∞–Љ–µ—В—А–∞ –Љ–Њ–ґ–µ—В–µ –≤–Ј—П—В—М 2-4% –і–Њ—Б—В—Г–њ–љ–Њ–є –њ–∞–Љ—П—В–Є. –Ф–ї—П –≤–µ–±-–њ—А–Є–ї–Њ–ґ–µ–љ–Є–є –Њ–±—Л—З–љ–Њ —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—О—В –љ–Є–Ј–Ї–Є–µ –Ј–љ–∞—З–µ–љ–Є—П work_mem, —В–∞–Ї –Ї–∞–Ї –Ј–∞–њ—А–Њ—Б–Њ–≤ –Њ–±—Л—З–љ–Њ –Љ–љ–Њ–≥–Њ, –љ–Њ –Њ–љ–Є –њ—А–Њ—Б—В—Л–µ, –Њ–±—Л—З–љ–Њ —Е–≤–∞—В–∞–µ—В –Њ—В 512 –і–Њ 2048 –Ъ–С. –° –і—А—Г–≥–Њ–є —Б—В–Њ—А–Њ–љ—Л, –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П –і–ї—П –њ–Њ–і–і–µ—А–ґ–Ї–Є –њ—А–Є–љ—П—В–Є—П —А–µ—И–µ–љ–Є–є —Б —Б–Њ—В–љ—П–Љ–Є —Б—В—А–Њ–Ї –≤ –Ї–∞–ґ–і–Њ–Љ –Ј–∞–њ—А–Њ—Б–µ –Є –і–µ—Б—П—В–Ї–∞–Љ–Є –Љ–Є–ї–ї–Є–Њ–љ–Њ–≤ —Б—В–Њ–ї–±—Ж–Њ–≤ –≤ —В–∞–±–ї–Є—Ж–∞—Е —Д–∞–Ї—В–Њ–≤ —З–∞—Б—В–Њ —В—А–µ–±—Г—О—В work_mem –њ–Њ—А—П–і–Ї–∞ 500 –Ь–С. –Ф–ї—П –±–∞–Ј –і–∞–љ–љ—Л—Е, –Ї–Њ—В–Њ—А—Л–µ –Є—Б–њ–Њ–ї—М–Ј—Г—О—В—Б—П –Є —В–∞–Ї, –Є —В–∞–Ї, —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –Љ–Њ–ґ–љ–Њ —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М –і–ї—П –Ї–∞–ґ–і–Њ–≥–Њ –Ј–∞–њ—А–Њ—Б–∞ –Є–љ–і–Є–≤–Є–і—Г–∞–ї—М–љ–Њ, –Є—Б–њ–Њ–ї—М–Ј—Г—П –љ–∞—Б—В—А–Њ–є–Ї–Є —Б–µ—Б—Б–Є–Є. –Э–∞–њ—А–Є–Љ–µ—А, –њ—А–Є –њ–∞–Љ—П—В–Є 1-4 –У–С —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М 32-128 MB.

3 –Я–∞–Љ—П—В—М –і–ї—П —А–∞–±–Њ—В—Л –Ї–Њ–Љ–∞–љ–і—Л VACUUM: maintenance_work_mem

–Я—А–µ–і—Л–і—Г—Й–µ–µ –љ–∞–Ј–≤–∞–љ–Є–µ –≤ PostgreSQL 7.x vacuum_mem. –≠—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –Ј–∞–і–∞—С—В –Њ–±—К—С–Љ –њ–∞–Љ—П—В–Є, –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л–є –Ї–Њ–Љ–∞–љ–і–∞–Љ–Є VACUUM, ANALYZE, CREATE INDEX, –Є –і–Њ–±–∞–≤–ї–µ–љ–Є—П –≤–љ–µ—И–љ–Є—Е –Ї–ї—О—З–µ–є. –І—В–Њ–±—Л –Њ–њ–µ—А–∞—Ж–Є–Є –≤—Л–њ–Њ–ї–љ—П–ї–Є—Б—М –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ –±—Л—Б—В—А–Њ, –љ—Г–ґ–љ–Њ —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А —В–µ–Љ –≤—Л—И–µ, —З–µ–Љ –±–Њ–ї—М—И–µ —А–∞–Ј–Љ–µ—А —В–∞–±–ї–Є—Ж –≤ –≤–∞—И–µ–є –±–∞–Ј–µ –і–∞–љ–љ—Л—Е. –Э–µ–њ–ї–Њ—Е–Њ –±—Л —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М –µ–≥–Њ –Ј–љ–∞—З–µ–љ–Є–µ –Њ—В 50 –і–Њ 75% —А–∞–Ј–Љ–µ—А–∞ –≤–∞—И–µ–є —Б–∞–Љ–Њ–є –±–Њ–ї—М—И–Њ–є —В–∞–±–ї–Є—Ж—Л –Є–ї–Є –Є–љ–і–µ–Ї—Б–∞ –Є–ї–Є, –µ—Б–ї–Є —В–Њ—З–љ–Њ –Њ–њ—А–µ–і–µ–ї–Є—В—М –љ–µ–≤–Њ–Ј–Љ–Њ–ґ–љ–Њ, –Њ—В 32 –і–Њ 256 –Ь–С. –°–ї–µ–і—Г–µ—В —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М –±–Њ–ї—М—И–µ–µ –Ј–љ–∞—З–µ–љ–Є–µ, —З–µ–Љ –і–ї—П work_mem. –°–ї–Є—И–Ї–Њ–Љ –±–Њ–ї—М—И–Є–µ –Ј–љ–∞—З–µ–љ–Є—П –њ—А–Є–≤–µ–і—Г—В –Ї –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—О —Б–≤–Њ–њ–∞. –Э–∞–њ—А–Є–Љ–µ—А, –њ—А–Є –њ–∞–Љ—П—В–Є 1-4 –У–С —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М 128-512 MB.

4 Free Space Map: –Ї–∞–Ї –Є–Ј–±–∞–≤–Є—В—М—Б—П –Њ—В VACUUM FULL

–Ю—Б–Њ–±–µ–љ–љ–Њ—Б—В—П–Љ–Є –≤–µ—А—Б–Є–Њ–љ–љ—Л—Е –і–≤–Є–ґ–Ї–Њ–≤ –С–Ф (–Ї –Ї–Њ—В–Њ—А—Л–Љ –Њ—В–љ–Њ—Б–Є—В—Б—П –Є –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л–є –≤ PostgreSQL) —П–≤–ї—П–µ—В—Б—П —Б–ї–µ–і—Г—О—Й–µ–µ:- –Ґ—А–∞–љ–Ј–∞–Ї—Ж–Є–Є, –Є–Ј–Љ–µ–љ—П—О—Й–Є–µ –і–∞–љ–љ—Л–µ –≤ —В–∞–±–ї–Є—Ж–µ, –љ–µ –±–ї–Њ–Ї–Є—А—Г—О—В —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є, —З–Є—В–∞—О—Й–Є–µ –Є–Ј –љ–µ—С –і–∞–љ–љ—Л–µ, –Є –љ–∞–Њ–±–Њ—А–Њ—В (—Н—В–Њ —Е–Њ—А–Њ—И–Њ);

- –Я—А–Є –Є–Ј–Љ–µ–љ–µ–љ–Є–Є –і–∞–љ–љ—Л—Е –≤ —В–∞–±–ї–Є—Ж–µ (–Ї–Њ–Љ–∞–љ–і–∞–Љ–Є UPDATE –Є–ї–Є DELETE) –љ–∞–Ї–∞–њ–ї–Є–≤–∞–µ—В—Б—П –Љ—Г—Б–Њ—А1 (–∞ —Н—В–Њ –њ–ї–Њ—Е–Њ).

–Ф–Њ –≤–µ—А—Б–Є–Є 7.2 –Ї–Њ–Љ–∞–љ–і–∞ VACUUM –њ–Њ–ї–љ–Њ—Б—В—М—О –±–ї–Њ–Ї–Є—А–Њ–≤–∞–ї–∞ —В–∞–±–ї–Є—Ж—Г. –Э–∞—З–Є–љ–∞—П —Б –≤–µ—А—Б–Є–Є 7.2, –Ї–Њ–Љ–∞–љ–і–∞ VACUUM –љ–∞–Ї–ї–∞–і—Л–≤–∞–µ—В –±–Њ–ї–µ–µ —Б–ї–∞–±—Г—О –±–ї–Њ–Ї–Є—А–Њ–≤–Ї—Г, –њ–Њ–Ј–≤–Њ–ї—П—О—Й—Г—О –њ–∞—А–∞–ї–ї–µ–ї—М–љ–Њ –≤—Л–њ–Њ–ї–љ—П—В—М –Ї–Њ–Љ–∞–љ–і—Л SELECT, INSERT, UPDATE –Є DELETE –љ–∞–і –Њ–±—А–∞–±–∞—В—Л–≤–∞–µ–Љ–Њ–є —В–∞–±–ї–Є—Ж–µ–є. –°—В–∞—А—Л–є –≤–∞—А–Є–∞–љ—В –Ї–Њ–Љ–∞–љ–і—Л –љ–∞–Ј—Л–≤–∞–µ—В—Б—П —В–µ–њ–µ—А—М VACUUM FULL.

–Э–Њ–≤—Л–є –≤–∞—А–Є–∞–љ—В –Ї–Њ–Љ–∞–љ–і—Л –љ–µ –њ—Л—В–∞–µ—В—Б—П —Г–і–∞–ї–Є—В—М –≤—Б–µ —Б—В–∞—А—Л–µ –≤–µ—А—Б–Є–Є –Ј–∞–њ–Є—Б–µ–є –Є, —Б–Њ–Њ—В–≤–µ—В—Б—В–≤–µ–љ–љ–Њ, —Г–Љ–µ–љ—М—И–Є—В—М —А–∞–Ј–Љ–µ—А —Д–∞–є–ї–∞, —Б–Њ–і–µ—А–ґ–∞—Й–µ–≥–Њ —В–∞–±–ї–Є—Ж—Г, –∞ –ї–Є—И—М –њ–Њ–Љ–µ—З–∞–µ—В –Ј–∞–љ–Є–Љ–∞–µ–Љ–Њ–µ –Є–Љ–Є –Љ–µ—Б—В–Њ –Ї–∞–Ї —Б–≤–Њ–±–Њ–і–љ–Њ–µ. –Ф–ї—П –Є–љ—Д–Њ—А–Љ–∞—Ж–Є–Є –Њ —Б–≤–Њ–±–Њ–і–љ–Њ–Љ –Љ–µ—Б—В–µ –µ—Б—В—М —Б–ї–µ–і—Г—О—Й–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є:

- max_fsm_relations

–Ь–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —В–∞–±–ї–Є—Ж, –і–ї—П –Ї–Њ—В–Њ—А—Л—Е –±—Г–і–µ—В –Њ—В—Б–ї–µ–ґ–Є–≤–∞—В—М—Б—П —Б–≤–Њ–±–Њ–і–љ–Њ–µ –Љ–µ—Б—В–Њ –≤ –Њ–±—Й–µ–є –Ї–∞—А—В–µ —Б–≤–Њ–±–Њ–і–љ–Њ–≥–Њ –њ—А–Њ—Б—В—А–∞–љ—Б—В–≤–∞. –≠—В–Є –і–∞–љ–љ—Л–µ —Б–Њ–±–Є—А–∞—О—В—Б—П VACUUM. –Я–∞—А–∞–Љ–µ—В—А max_fsm_relations –і–Њ–ї–ґ–µ–љ –±—Л—В—М –љ–µ –Љ–µ–љ—М—И–µ –Њ–±—Й–µ–≥–Њ –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ —В–∞–±–ї–Є—Ж –≤–Њ –≤—Б–µ—Е –±–∞–Ј–∞—Е –і–∞–љ–љ–Њ–є —Г—Б—В–∞–љ–Њ–≤–Ї–Є (–ї—Г—З—И–µ —Б –Ј–∞–њ–∞—Б–Њ–Љ).

- max_fsm_pages

–Ф–∞–љ–љ—Л–є –њ–∞—А–∞–Љ–µ—В—А –Њ–њ—А–µ–і–µ–ї—П–µ—В —А–∞–Ј–Љ–µ—А —А–µ–µ—Б—В—А–∞, –≤ –Ї–Њ—В–Њ—А–Њ–Љ —Е—А–∞–љ–Є—В—Б—П –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П –Њ —З–∞—Б—В–Є—З–љ–Њ –Њ—Б–≤–Њ–±–Њ–ґ–і—С–љ–љ—Л—Е —Б—В—А–∞–љ–Є—Ж–∞—Е –і–∞–љ–љ—Л—Е, –≥–Њ—В–Њ–≤—Л—Е –Ї –Ј–∞–њ–Њ–ї–љ–µ–љ–Є—О –љ–Њ–≤—Л–Љ–Є –і–∞–љ–љ—Л–Љ–Є. –Ч–љ–∞—З–µ–љ–Є–µ —Н—В–Њ–≥–Њ –њ–∞—А–∞–Љ–µ—В—А–∞ –љ—Г–ґ–љ–Њ —Г—Б—В–∞–љ–Њ–≤–Є—В—М —З—Г—В—М –±–Њ–ї—М—И–µ, —З–µ–Љ –њ–Њ–ї–љ–Њ–µ —З–Є—Б–ї–Њ —Б—В—А–∞–љ–Є—Ж, –Ї–Њ—В–Њ—А—Л–µ –Љ–Њ–≥—Г—В –±—Л—В—М –Ј–∞—В—А–Њ–љ—Г—В—Л –Њ–њ–µ—А–∞—Ж–Є—П–Љ–Є –Њ–±–љ–Њ–≤–ї–µ–љ–Є—П –Є–ї–Є —Г–і–∞–ї–µ–љ–Є—П –Љ–µ–ґ–і—Г –≤—Л–њ–Њ–ї–љ–µ–љ–Є–µ–Љ VACUUM. –І—В–Њ–±—Л –Њ–њ—А–µ–і–µ–ї–Є—В—М —Н—В–Њ —З–Є—Б–ї–Њ, –Љ–Њ–ґ–љ–Њ –Ј–∞–њ—Г—Б—В–Є—В—М VACUUM VERBOSE ANALYZE –Є –≤—Л—П—Б–љ–Є—В—М –Њ–±—Й–µ–µ —З–Є—Б–ї–Њ —Б—В—А–∞–љ–Є—Ж, –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л—Е –±–∞–Ј–Њ–є –і–∞–љ–љ—Л—Е. max_fsm_pages –Њ–±—Л—З–љ–Њ —В—А–µ–±—Г–µ—В –љ–µ–Љ–љ–Њ–≥–Њ –њ–∞–Љ—П—В–Є, —В–∞–Ї —З—В–Њ –љ–∞ —Н—В–Њ–Љ –њ–∞—А–∞–Љ–µ—В—А–µ –ї—Г—З—И–µ –љ–µ —Н–Ї–Њ–љ–Њ–Љ–Є—В—М.

–Х—Б–ї–Є —Н—В–Є –њ–∞—А–∞–Љ–µ—В—А—Л —Г—Б—В–∞–љ–Њ–≤–ї–µ–љ–љ—Л –≤–µ—А–љ–Њ –Є –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П –Њ–±–Њ –≤—Б–µ—Е –Є–Ј–Љ–µ–љ–µ–љ–Є—П—Е –њ–Њ–Љ–µ—Й–∞–µ—В—Б—П –≤ FSM, —В–Њ –Ї–Њ–Љ–∞–љ–і—Л VACUUM –±—Г–і–µ—В –і–Њ—Б—В–∞—В–Њ—З–љ–Њ –і–ї—П —Б–±–Њ—А–Ї–Є –Љ—Г—Б–Њ—А–∞, –µ—Б–ї–Є –љ–µ—В - –њ–Њ–љ–∞–і–Њ–±–Є—В—Б—П VACUUM FULL, –≤–Њ –≤—А–µ–Љ—П —А–∞–±–Њ—В—Л –Ї–Њ—В–Њ—А–Њ–є –љ–Њ—А–Љ–∞–ї—М–љ–Њ–µ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –С–Ф —Б–Є–ї—М–љ–Њ –Ј–∞—В—А—Г–і–љ–µ–љ–Њ.

–Т–Э–Ш–Ь–Р–Э–Ш–Х! –Э–∞—З–Є–љ–∞—П —Б 8.4 –≤–µ—А—Б–Є–Є fsm –њ–∞—А–∞–Љ–µ—В—А—Л –±—Л–ї–Є —Г–±—А–∞–љ—Л, –њ–Њ—Б–Ї–Њ–ї—М–Ї—Г Free Space Map —Б–Њ—Е—А–∞–љ—П–µ—В—Б—П –љ–∞ –ґ–µ—Б—В–Ї–Є–є –і–Є—Б–Ї, –∞ –љ–µ –≤ –њ–∞–Љ—П—В—М.

5 –Я—А–Њ—З–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є

- temp_buffers

–С—Г—Д–µ—А –њ–Њ–і –≤—А–µ–Љ–µ–љ–љ—Л–µ –Њ–±—К–µ–Ї—В—Л, –≤ –Њ—Б–љ–Њ–≤–љ–Њ–Љ –і–ї—П –≤—А–µ–Љ–µ–љ–љ—Л—Е —В–∞–±–ї–Є—Ж. –Ь–Њ–ґ–љ–Њ —Г—Б—В–∞–љ–Њ–≤–Є—В—М –њ–Њ—А—П–і–Ї–∞ 16 –Ь–С.

- max_prepared_transactions

–Ъ–Њ–ї–Є—З–µ—Б—В–≤–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ–Њ –њ–Њ–і–≥–Њ—В–∞–≤–ї–Є–≤–∞–µ–Љ—Л—Е —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є (PREPARE TRANSACTION). –Ь–Њ–ґ–љ–Њ –Њ—Б—В–∞–≤–Є—В—М –њ–Њ –і–µ—Д–Њ–ї—В—Г -- 5.

- vacuum_cost_delay

–Х—Б–ї–Є —Г –≤–∞—Б –±–Њ–ї—М—И–Є–µ —В–∞–±–ї–Є—Ж—Л, –Є –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В—Б—П –Љ–љ–Њ–≥–Њ –Њ–і–љ–Њ–≤—А–µ–Љ–µ–љ–љ—Л—Е –Њ–њ–µ—А–∞—Ж–Є–є –Ј–∞–њ–Є—Б–Є, –≤–∞–Љ –Љ–Њ–ґ–µ—В –њ—А–Є–≥–Њ–і–Є—В—М—Б—П —Д—Г–љ–Ї—Ж–Є—П, –Ї–Њ—В–Њ—А–∞—П —Г–Љ–µ–љ—М—И–∞–µ—В –Ј–∞—В—А–∞—В—Л –љ–∞ I/O –і–ї—П VACUUM, —А–∞—Б—В—П–≥–Є–≤–∞—П—П –µ–≥–Њ –њ–Њ –≤—А–µ–Љ–µ–љ–Є. –І—В–Њ–±—Л –≤–Ї–ї—О—З–Є—В—М —Н—В—Г —Д—Г–љ–Ї—Ж–Є–Њ–љ–∞–ї—М–љ–Њ—Б—В—М, –љ—Г–ґ–љ–Њ –њ–Њ–і–љ—П—В—М –Ј–љ–∞—З–µ–љ–Є–µ vacuum_cost_delay –≤—Л—И–µ 0. –Ш—Б–њ–Њ–ї—М–Ј—Г–є—В–µ —А–∞–Ј—Г–Љ–љ—Г—О –Ј–∞–і–µ—А–ґ–Ї—Г –Њ—В 50 –і–Њ 200 –Љ—Б. –Ф–ї—П –±–Њ–ї–µ–µ —В–Њ–љ–Ї–Њ–є –љ–∞—Б—В—А–Њ–є–Ї–Є –њ–Њ–≤—Л—И–∞–є—В–µ vacuum_cost_page_hit –Є –њ–Њ–љ–Є–ґ–∞–є—В–µ vacuum_cost_page_limit. –≠—В–Њ –Њ—Б–ї–∞–±–Є—В –≤–ї–Є—П–љ–Є–µ VACUUM, —Г–≤–µ–ї–Є—З–Є–≤ –≤—А–µ–Љ—П –µ–≥–Њ –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П. –Т —В–µ—Б—В–∞—Е —Б –њ–∞—А–∞–ї–ї–µ–ї—М–љ—Л–Љ–Є —В—А–∞–љ–Ј–∞–Ї—Ж–Є—П–Љ–Є –ѓ–љ –Т–Є–Ї (Jan Wieck) –њ–Њ–ї—Г—З–Є–ї, —З—В–Њ –њ—А–Є –Ј–љ–∞—З–µ–љ–Є—П—Е delay -- 200, page_hit -- 6 –Є –њ—А–µ–і–µ–ї -- 100 –≤–ї—П–љ–Є–µ VACUUM —Г–Љ–µ–љ—М—И–Є–ї–Њ—Б—М –±–Њ–ї–µ–µ —З–µ–Љ –љ–∞ 80%, –љ–Њ –µ–≥–Њ –і–ї–Є—В–µ–ї—М–љ–Њ—Б—В—М —Г–≤–µ–ї–Є—З–Є–ї–∞—Б—М –≤—В—А–Њ–µ.

- max_stack_depth

–°–њ–µ—Ж–Є–∞–ї—М–љ—Л–є —Б—В–µ–Ї –і–ї—П —Б–µ—А–≤–µ—А–∞, –≤ –Є–і–µ–∞–ї–µ –Њ–љ –і–Њ–ї–ґ–µ–љ —Б–Њ–≤–њ–∞–і–∞—В—М —Б —А–∞–Ј–Љ–µ—А–Њ–Љ —Б—В–µ–Ї–∞, –≤—Л—Б—В–∞–≤–ї–µ–љ–љ–Њ–Љ –≤ —П–і—А–µ –Ю–°. –£—Б—В–∞–љ–Њ–≤–Ї–∞ –±–Њ–ї—М—И–µ–≥–Њ –Ј–љ–∞—З–µ–љ–Є—П, —З–µ–Љ –≤ —П–і—А–µ, –Љ–Њ–ґ–µ—В –њ—А–Є–≤–µ—Б—В–Є –Ї –Њ—И–Є–±–Ї–∞–Љ. –†–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М 2-4 MB.

- max_files_per_process

–Ь–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —Д–∞–є–ї–Њ–≤, –Њ—В–Ї—А—Л–≤–∞–µ–Љ—Л—Е –њ—А–Њ—Ж–µ—Б—Б–Њ–Љ –Є –µ–≥–Њ –њ–Њ–і–њ—А–Њ—Ж–µ—Б—Б–∞–Љ–Є –≤ –Њ–і–Є–љ –Љ–Њ–Љ–µ–љ—В –≤—А–µ–Љ–µ–љ–Є. –£–Љ–µ–љ—М—И–Є—В–µ –і–∞–љ–љ—Л–є –њ–∞—А–∞–Љ–µ—В—А, –µ—Б–ї–Є –≤ –њ—А–Њ—Ж–µ—Б—Б–µ —А–∞–±–Њ—В—Л –љ–∞–±–ї—О–і–∞–µ—В—Б—П —Б–Њ–Њ–±—Й–µ–љ–Є–µ «Too many open files».

2 –Ц—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –Є –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–µ —В–Њ—З–Ї–Є

–Ц—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є PostgreSQL —А–∞–±–Њ—В–∞–µ—В —Б–ї–µ–і—Г—О—Й–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ: –≤—Б–µ –Є–Ј–Љ–µ–љ–µ–љ–Є—П –≤ —Д–∞–є–ї–∞—Е –і–∞–љ–љ—Л—Е (–≤ –Ї–Њ—В–Њ—А—Л—Е –љ–∞—Е–Њ–і—П—В—Б—П —В–∞–±–ї–Є—Ж—Л –Є –Є–љ–і–µ–Ї—Б—Л) –њ—А–Њ–Є–Ј–≤–Њ–і—П—В—Б—П —В–Њ–ї—М–Ї–Њ –њ–Њ—Б–ї–µ —В–Њ–≥–Њ, –Ї–∞–Ї –Њ–љ–Є –±—Л–ї–Є –Ј–∞–љ–µ—Б–µ–љ—Л –≤ –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є, –њ—А–Є —Н—В–Њ–Љ –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї–µ –і–Њ–ї–ґ–љ—Л –±—Л—В—М –≥–∞—А–∞–љ—В–Є—А–Њ–≤–∞–љ–љ–Њ –Ј–∞–њ–Є—Б–∞–љ—Л –љ–∞ –і–Є—Б–Ї.–Т —Н—В–Њ–Љ —Б–ї—Г—З–∞–µ –љ–µ—В –љ–µ–Њ–±—Е–Њ–і–Є–Љ–Њ—Б—В–Є —Б–±—А–∞—Б—Л–≤–∞—В—М –љ–∞ –і–Є—Б–Ї –Є–Ј–Љ–µ–љ–µ–љ–Є—П –і–∞–љ–љ—Л—Е –њ—А–Є –Ї–∞–ґ–і–Њ–Љ —Г—Б–њ–µ—И–љ–Њ–Љ –Ј–∞–≤–µ—А—И–µ–љ–Є–Є —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є: –≤ —Б–ї—Г—З–∞–µ —Б–±–Њ—П –С–Ф –Љ–Њ–ґ–µ—В –±—Л—В—М –≤–Њ—Б—Б—В–∞–љ–Њ–≤–ї–µ–љ–∞ –њ–Њ –Ј–∞–њ–Є—Б—П–Љ –≤ –ґ—Г—А–љ–∞–ї–µ. –Ґ–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, –і–∞–љ–љ—Л–µ –Є–Ј –±—Г—Д–µ—А–Њ–≤ —Б–±—А–∞—Б—Л–≤–∞—О—В—Б—П –љ–∞ –і–Є—Б–Ї –њ—А–Є –њ—А–Њ—Е–Њ–і–µ –Ї–Њ–љ—В—А–Њ–ї—М–љ–Њ–є —В–Њ—З–Ї–Є: –ї–Є–±–Њ –њ—А–Є –Ј–∞–њ–Њ–ї–љ–µ–љ–Є–Є –љ–µ—Б–Ї–Њ–ї—М–Ї–Є—Е (–њ–∞—А–∞–Љ–µ—В—А checkpoint_segments, –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О 3) —Б–µ–≥–Љ–µ–љ—В–Њ–≤ –ґ—Г—А–љ–∞–ї–∞ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є, –ї–Є–±–Њ —З–µ—А–µ–Ј –Њ–њ—А–µ–і–µ–ї—С–љ–љ—Л–є –Є–љ—В–µ—А–≤–∞–ї –≤—А–µ–Љ–µ–љ–Є (–њ–∞—А–∞–Љ–µ—В—А checkpoint_timeout, –Є–Ј–Љ–µ—А—П–µ—В—Б—П –≤ —Б–µ–Ї—Г–љ–і–∞—Е, –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О 300).

–Ш–Ј–Љ–µ–љ–µ–љ–Є–µ —Н—В–Є—Е –њ–∞—А–∞–Љ–µ—В—А–Њ–≤ –њ—А—П–Љ–Њ –љ–µ –њ–Њ–≤–ї–Є—П–µ—В –љ–∞ —Б–Ї–Њ—А–Њ—Б—В—М —З—В–µ–љ–Є—П, –љ–Њ –Љ–Њ–ґ–µ—В –њ—А–Є–љ–µ—Б—В–Є –±–Њ–ї—М—И—Г—О –њ–Њ–ї—М–Ј—Г, –µ—Б–ї–Є –і–∞–љ–љ—Л–µ –≤ –±–∞–Ј–µ –∞–Ї—В–Є–≤–љ–Њ –Є–Ј–Љ–µ–љ—П—О—В—Б—П.

1 –£–Љ–µ–љ—М—И–µ–љ–Є–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л—Е —В–Њ—З–µ–Ї: checkpoint_segments

–Х—Б–ї–Є –≤ –±–∞–Ј—Г –Ј–∞–љ–Њ—Б—П—В—Б—П –±–Њ–ї—М—И–Є–µ –Њ–±—К—С–Љ—Л –і–∞–љ–љ—Л—Е, —В–Њ –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–µ —В–Њ—З–Ї–Є –Љ–Њ–≥—Г—В –њ—А–Њ–Є—Б—Е–Њ–і–Є—В—М —Б–ї–Є—И–Ї–Њ–Љ —З–∞—Б—В–Њ2. –Я—А–Є —Н—В–Њ–Љ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М —Г–њ–∞–і—С—В –Є–Ј-–Ј–∞ –њ–Њ—Б—В–Њ—П–љ–љ–Њ–≥–Њ —Б–±—А–∞—Б—Л–≤–∞–љ–Є—П –љ–∞ –і–Є—Б–Ї –і–∞–љ–љ—Л—Е –Є–Ј –±—Г—Д–µ—А–∞.–Ф–ї—П —Г–≤–µ–ї–Є—З–µ–љ–Є—П –Є–љ—В–µ—А–≤–∞–ї–∞ –Љ–µ–ґ–і—Г –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–Љ–Є —В–Њ—З–Ї–∞–Љ–Є –љ—Г–ґ–љ–Њ —Г–≤–µ–ї–Є—З–Є—В—М –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —Б–µ–≥–Љ–µ–љ—В–Њ–≤ –ґ—Г—А–љ–∞–ї–∞ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є (checkpoint_segments). –Ф–∞–љ–љ—Л–є –њ–∞—А–∞–Љ–µ—В—А –Њ–њ—А–µ–і–µ–ї—П–µ—В –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —Б–µ–≥–Љ–µ–љ—В–Њ–≤ (–Ї–∞–ґ–і—Л–є –њ–Њ 16 –Ь–С) –ї–Њ–≥–∞ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –Љ–µ–ґ–і—Г –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–Љ–Є —В–Њ—З–Ї–∞–Љ–Є. –≠—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –љ–µ –Є–Љ–µ–µ—В –Њ—Б–Њ–±–Њ–≥–Њ –Ј–љ–∞—З–µ–љ–Є—П –і–ї—П –±–∞–Ј—Л –і–∞–љ–љ—Л—Е, –њ—А–µ–і–љ–∞–Ј–љ–∞—З–µ–љ–љ–Њ–є –њ—А–µ–Є–Љ—Г—Й–µ—Б—В–≤–µ–љ–љ–Њ –і–ї—П —З—В–µ–љ–Є—П, –љ–Њ –і–ї—П –±–∞–Ј –і–∞–љ–љ—Л—Е —Б–Њ –Љ–љ–Њ–ґ–µ—Б—В–≤–Њ–Љ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є —Г–≤–µ–ї–Є—З–µ–љ–Є–µ —Н—В–Њ–≥–Њ –њ–∞—А–∞–Љ–µ—В—А–∞ –Љ–Њ–ґ–µ—В –Њ–Ї–∞–Ј–∞—В—М—Б—П –ґ–Є–Ј–љ–µ–љ–љ–Њ –љ–µ–Њ–±—Е–Њ–і–Є–Љ—Л–Љ. –Т –Ј–∞–≤–Є—Б–Є–Љ–Њ—Б—В–Є –Њ—В –Њ–±—К–µ–Љ–∞ –і–∞–љ–љ—Л—Е —Г—Б—В–∞–љ–Њ–≤–Є—В–µ —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –≤ –і–Є–∞–њ–∞–Ј–Њ–љ–µ –Њ—В 12 –і–Њ 256 —Б–µ–≥–Љ–µ–љ—В–Њ–≤ –Є, –µ—Б–ї–Є –≤ –ї–Њ–≥–µ –њ–Њ—П–≤–ї—П—О—В—Б—П –њ—А–µ–і—Г–њ—А–µ–ґ–і–µ–љ–Є—П (warning) –Њ —В–Њ–Љ, —З—В–Њ –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–µ —В–Њ—З–Ї–Є –њ—А–Њ–Є—Б—Е–Њ–і—П—В —Б–ї–Є—И–Ї–Њ–Љ —З–∞—Б—В–Њ, –њ–Њ—Б—В–µ–њ–µ–љ–љ–Њ —Г–≤–µ–ї–Є—З–Є–≤–∞–є—В–µ –µ–≥–Њ. –Ь–µ—Б—В–Њ, —В—А–µ–±—Г–µ–Љ–Њ–µ –љ–∞ –і–Є—Б–Ї–µ, –≤—Л—З–Є—Б–ї—П–µ—В—Б—П –њ–Њ —Д–Њ—А–Љ—Г–ї–µ (checkpoint_segments * 2 + 1) * 16 –Ь–С, —В–∞–Ї —З—В–Њ —Г–±–µ–і–Є—В–µ—Б—М, —З—В–Њ —Г –≤–∞—Б –і–Њ—Б—В–∞—В–Њ—З–љ–Њ —Б–≤–Њ–±–Њ–і–љ–Њ–≥–Њ –Љ–µ—Б—В–∞. –Э–∞–њ—А–Є–Љ–µ—А, –µ—Б–ї–Є –≤—Л –≤—Л—Б—В–∞–≤–Є—В–µ –Ј–љ–∞—З–µ–љ–Є–µ 32, –≤–∞–Љ –њ–Њ—В—А–µ–±—Г–µ—В—Б—П –±–Њ–ї—М—И–µ 1 –У–С –і–Є—Б–Ї–Њ–≤–Њ–≥–Њ –њ—А–Њ—Б—В—А–∞–љ—Б—В–≤–∞.

–°–ї–µ–і—Г–µ—В —В–∞–Ї–ґ–µ –Њ—В–Љ–µ—В–Є—В—М, —З—В–Њ —З–µ–Љ –±–Њ–ї—М—И–µ –Є–љ—В–µ—А–≤–∞–ї –Љ–µ–ґ–і—Г –Ї–Њ–љ—В—А–Њ–ї—М–љ—Л–Љ–Є —В–Њ—З–Ї–∞–Љ–Є, —В–µ–Љ –і–Њ–ї—М—И–µ –±—Г–і—Г—В –≤–Њ—Б—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М—Б—П –і–∞–љ–љ—Л–µ –њ–Њ –ґ—Г—А–љ–∞–ї—Г —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –њ–Њ—Б–ї–µ —Б–±–Њ—П.

2 fsync –Є —Б—В–Њ–Є—В –ї–Є –µ–≥–Њ —В—А–Њ–≥–∞—В—М

–Э–∞–Є–±–Њ–ї–µ–µ —А–∞–і–Є–Ї–∞–ї—М–љ–Њ–µ –Є–Ј –≤–Њ–Ј–Љ–Њ–ґ–љ—Л—Е —А–µ—И–µ–љ–Є–є -- –≤—Л—Б—В–∞–≤–Є—В—М –Ј–љ–∞—З–µ–љ–Є–µ «off» –њ–∞—А–∞–Љ–µ—В—А—Г fsync. –Я—А–Є —Н—В–Њ–Љ –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї–µ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –љ–µ –±—Г–і—Г—В –њ—А–Є–љ—Г–і–Є—В–µ–ї—М–љ–Њ —Б–±—А–∞—Б—Л–≤–∞—В—М—Б—П –љ–∞ –і–Є—Б–Ї, —З—В–Њ –і–∞—Б—В –±–Њ–ї—М—И–Њ–є –њ—А–Є—А–Њ—Б—В —Б–Ї–Њ—А–Њ—Б—В–Є –Ј–∞–њ–Є—Б–Є. –£—З—В–Є—В–µ: –≤—Л –ґ–µ—А—В–≤—Г–µ—В–µ –љ–∞–і—С–ґ–љ–Њ—Б—В—М—О, –≤ —Б–ї—Г—З–∞–µ —Б–±–Њ—П —Ж–µ–ї–Њ—Б—В–љ–Њ—Б—В—М –±–∞–Ј—Л –±—Г–і–µ—В –љ–∞—А—Г—И–µ–љ–∞, –Є –µ—С –њ—А–Є–і—С—В—Б—П –≤–Њ—Б—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М –Є–Ј —А–µ–Ј–µ—А–≤–љ–Њ–є –Ї–Њ–њ–Є–Є!–Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П –ї–Є—И—М –≤ —В–Њ–Љ —Б–ї—Г—З–∞–µ, –µ—Б–ї–Є –≤—Л –≤—Б–µ—Ж–µ–ї–Њ –і–Њ–≤–µ—А—П–µ—В–µ —Б–≤–Њ–µ–Љ—Г «–ґ–µ–ї–µ–Ј—Г» –Є —Б–≤–Њ–µ–Љ—Г –Є—Б—В–Њ—З–љ–Є–Ї—Г –±–µ—Б–њ–µ—А–µ–±–Њ–є–љ–Њ–≥–Њ –њ–Є—В–∞–љ–Є—П. –Э—Г –Є–ї–Є –µ—Б–ї–Є –і–∞–љ–љ—Л–µ –≤ –±–∞–Ј–µ –љ–µ –њ—А–µ–і—Б—В–∞–≤–ї—П—О—В –і–ї—П –≤–∞—Б –Њ—Б–Њ–±–Њ–є —Ж–µ–љ–љ–Њ—Б—В–Є.

3 –Я—А–Њ—З–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є

- commit_delay (–≤ –Љ–Є–Ї—А–Њ—Б–µ–Ї—Г–љ–і–∞—Е, 0 –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О) –Є commit_siblings (5 –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О)

–Њ–њ—А–µ–і–µ–ї—П—О—В –Ј–∞–і–µ—А–ґ–Ї—Г –Љ–µ–ґ–і—Г –њ–Њ–њ–∞–і–∞–љ–Є–µ–Љ –Ј–∞–њ–Є—Б–Є –≤ –±—Г—Д–µ—А –ґ—Г—А–љ–∞–ї–∞ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –Є —Б–±—А–Њ—Б–Њ–Љ –µ—С –љ–∞ –і–Є—Б–Ї. –Х—Б–ї–Є –њ—А–Є —Г—Б–њ–µ—И–љ–Њ–Љ –Ј–∞–≤–µ—А—И–µ–љ–Є–Є —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є –∞–Ї—В–Є–≤–љ–Њ –љ–µ –Љ–µ–љ–µ–µ commit_siblings —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є, —В–Њ –Ј–∞–њ–Є—Б—М –±—Г–і–µ—В –Ј–∞–і–µ—А–ґ–∞–љ–∞ –љ–∞ –≤—А–µ–Љ—П commit_delay. –Х—Б–ї–Є –Ј–∞ —Н—В–Њ –≤—А–µ–Љ—П –Ј–∞–≤–µ—А—И–Є—В—Б—П –і—А—Г–≥–∞—П —В—А–∞–љ–Ј–∞–Ї—Ж–Є—П, —В–Њ –Є—Е –Є–Ј–Љ–µ–љ–µ–љ–Є—П –±—Г–і—Г—В —Б–±—А–Њ—И–µ–љ—Л –љ–∞ –і–Є—Б–Ї –≤–Љ–µ—Б—В–µ, –њ—А–Є –њ–Њ–Љ–Њ—Й–Є –Њ–і–љ–Њ–≥–Њ —Б–Є—Б—В–µ–Љ–љ–Њ–≥–Њ –≤—Л–Ј–Њ–≤–∞. –≠—В–Є –њ–∞—А–∞–Љ–µ—В—А—Л –њ–Њ–Ј–≤–Њ–ї—П—В —Г—Б–Ї–Њ—А–Є—В—М —А–∞–±–Њ—В—Г, –µ—Б–ї–Є –њ–∞—А–∞–ї–ї–µ–ї—М–љ–Њ –≤—Л–њ–Њ–ї–љ—П–µ—В—Б—П –Љ–љ–Њ–≥–Њ «–Љ–µ–ї–Ї–Є—Е» —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є.

- wal_sync_method

–Ь–µ—В–Њ–і, –Ї–Њ—В–Њ—А—Л–є –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В—Б—П –і–ї—П –њ—А–Є–љ—Г–і–Є—В–µ–ї—М–љ–Њ–є –Ј–∞–њ–Є—Б–Є –і–∞–љ–љ—Л—Е –љ–∞ –і–Є—Б–Ї. –Х—Б–ї–Є fsync=off, —В–Њ —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –љ–µ –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В—Б—П. –Т–Њ–Ј–Љ–Њ–ґ–љ—Л–µ –Ј–љ–∞—З–µ–љ–Є—П:

- open_datasync -- –Ј–∞–њ–Є—Б—М –і–∞–љ–љ—Л—Е –Љ–µ—В–Њ–і–Њ–Љ open() —Б –њ–∞—А–∞–Љ–µ—В—А–Њ–Љ O_DSYNC

- fdatasync -- –≤—Л–Ј–Њ–≤ –Љ–µ—В–Њ–і–∞ fdatasync() –њ–Њ—Б–ї–µ –Ї–∞–ґ–і–Њ–≥–Њ commit

- fsync_writethrough -- –≤—Л–Ј—Л–≤–∞—В—М fsync() –њ–Њ—Б–ї–µ –Ї–∞–ґ–і–Њ–≥–Њ commit –Є–≥–љ–Њ—А–Є—А—Г—О –њ–∞—А–∞–ї–µ–ї—М–љ—Л–µ –њ—А–Њ—Ж–µ—Б—Б—Л

- fsync -- –≤—Л–Ј–Њ–≤ fsync() –њ–Њ—Б–ї–µ –Ї–∞–ґ–і–Њ–≥–Њ commit

- open_sync -- –Ј–∞–њ–Є—Б—М –і–∞–љ–љ—Л—Е –Љ–µ—В–Њ–і–Њ–Љ open() —Б –њ–∞—А–∞–Љ–µ—В—А–Њ–Љ O_SYNC

–Э–µ –≤—Б–µ —Н—В–Є –Љ–µ—В–Њ–і—Л –і–Њ—Б—В—Г–њ–љ—Л –љ–∞ —А–∞–Ј–љ—Л—Е –Ю–°. –Я–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞–µ—В—Б—П –њ–µ—А–≤—Л–є, –Ї–Њ—В–Њ—А—Л–є –і–Њ—Б—В—Г–њ–µ–љ –і–ї—П —Б–Є—Б—В–µ–Љ—Л.

- full_page_writes

–£—Б—В–∞–љ–Њ–≤–Є—В–µ –і–∞–љ–љ—Л–є –њ–∞—А–∞–Љ–µ—В—А –≤ off, –µ—Б–ї–Є fsync=off. –Ш–љ–∞—З–µ, –Ї–Њ–≥–і–∞ —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А on, PostgreSQL –Ј–∞–њ–Є—Б—Л–≤–∞–µ—В —Б–Њ–і–µ—А–ґ–Є–Љ–Њ–µ –Ї–∞–ґ–і–Њ–є –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –њ—А–Є –њ–µ—А–≤–Њ–є –Љ–Њ–і–Є—Д–Є–Ї–∞—Ж–Є–Є —В–∞–±–ї–Є—Ж—Л. –≠—В–Њ –љ–µ–Њ–±—Е–Њ–і–Є–Љ–Њ, –њ–Њ—Б–Ї–Њ–ї—М–Ї—Г –і–∞–љ–љ—Л–µ –Љ–Њ–≥—Г—В –Ј–∞–њ–Є—Б–∞—В—М—Б—П –ї–Є—И—М —З–∞—Б—В–Є—З–љ–Њ, –µ—Б–ї–Є –≤ —Е–Њ–і–µ –њ—А–Њ—Ж–µ—Б—Б–∞ «—Г–њ–∞–ї–∞» –Ю–°. –≠—В–Њ –њ—А–Є–≤–µ–і–µ—В –Ї —В–Њ–Љ—Г, —З—В–Њ –љ–∞ –і–Є—Б–Ї–µ –Њ–Ї–∞–ґ—Г—В—Б—П –љ–Њ–≤—Л–µ –і–∞–љ–љ—Л–µ —Б–Љ–µ—И–∞–љ–љ—Л–µ —Б–Њ —Б—В–∞—А—Л–Љ–Є. –°—В—А–Њ–Ї–Њ–≤–Њ–≥–Њ —Г—А–Њ–≤–љ—П –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –Љ–Њ–ґ–µ—В –±—Л—В—М –љ–µ –і–Њ—Б—В–∞—В–Њ—З–љ–Њ, —З—В–Њ –±—Л –њ–Њ–ї–љ–Њ—Б—В—М –≤–Њ—Б—Б—В–∞–љ–Њ–≤–Є—В—М –і–∞–љ–љ—Л–µ –њ–Њ—Б–ї–µ «–њ–∞–і–µ–љ–Є—П». full_page_writes –≥–∞—А–∞–љ—В–Є—А—Г–µ—В –Ї–Њ—А—А–µ–Ї—В–љ–Њ–µ –≤–Њ—Б—Б—В–∞–љ–Њ–≤–ї–µ–љ–Є–µ, —Ж–µ–љ–Њ–є —Г–≤–µ–ї–µ—З–µ–љ–Є—П –Ј–∞–њ–Є—Б—Л–≤–∞–µ–Љ—Л—Е –і–∞–љ–љ—Л—Е –≤ –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є (–Х–і–Є–љ—Б—В–≤–µ–љ–љ—Л–є —Б–њ–Њ—Б–Њ–± —Б–љ–Є–ґ–µ–љ–Є—П –Њ–±—К–µ–Љ–∞ –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –Ј–∞–Ї–ї—О—З–∞–µ—В—Б—П –≤ —Г–≤–µ–ї–Є—З–µ–љ–Є–Є checkpoint_interval).

- wal_buffers

–Ъ–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ–∞–Љ—П—В–Є –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ–Њ–µ –≤ SHARED MEMORY –і–ї—П –≤–µ–і–µ–љ–Є—П —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Њ–љ–љ—Л—Е –ї–Њ–≥–Њ–≤3. –°—В–Њ–Є—В —Г–≤–µ–ї–Є—З–Є—В—М –±—Г—Д–µ—А –і–Њ 256-512 –Ї–С, —З—В–Њ –њ–Њ–Ј–≤–Њ–ї–Є—В –ї—Г—З—И–µ —А–∞–±–Њ—В–∞—В—М —Б –±–Њ–ї—М—И–Є–Љ–Є —В—А–∞–љ–Ј–∞–Ї—Ж–Є—П–Љ–Є. –Э–∞–њ—А–Є–Љ–µ—А, –њ—А–Є –і–Њ—Б—В—Г–њ–љ–Њ–є –њ–∞–Љ—П—В–Є 1-4 –У–С —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П —Г—Б—В–∞–љ–∞–≤–ї–Є–≤–∞—В—М 256-1024 –Ъ–С.

3 –Я–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї –Ј–∞–њ—А–Њ—Б–Њ–≤

–°–ї–µ–і—Г—О—Й–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є –њ–Њ–Љ–Њ–≥–∞—О—В –њ–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї—Г –Ј–∞–њ—А–Њ—Б–Њ–≤ –њ—А–∞–≤–Є–ї—М–љ–Њ –Њ—Ж–µ–љ–Є–≤–∞—В—М —Б—В–Њ–Є–Љ–Њ—Б—В–Є —А–∞–Ј–ї–Є—З–љ—Л—Е –Њ–њ–µ—А–∞—Ж–Є–є –Є –≤—Л–±–Є—А–∞—В—М –Њ–њ—В–Є–Љ–∞–ї—М–љ—Л–є –њ–ї–∞–љ –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–∞. –°—Г—Й–µ—Б—В–≤—Г—О—В 3 –љ–∞—Б—В—А–Њ–є–Ї–Є –њ–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї–∞, –љ–∞ –Ї–Њ—В–Њ—А—Л–µ —Б—В–Њ–Є—В –Њ–±—А–∞—В–Є—В—М –≤–љ–Є–Љ–∞–љ–Є–µ:- default_statistics_target

–≠—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –Ј–∞–і–∞—С—В –Њ–±—К—С–Љ —Б—В–∞—В–Є—Б—В–Є–Ї–Є, —Б–Њ–±–Є—А–∞–µ–Љ–Њ–є –Ї–Њ–Љ–∞–љ–і–Њ–є ANALYZE (—Б–Љ. –њ—Г–љ–Ї—В 3.1.2). –£–≤–µ–ї–Є—З–µ–љ–Є–µ –њ–∞—А–∞–Љ–µ—В—А–∞ –Ј–∞—Б—В–∞–≤–Є—В —Н—В—Г –Ї–Њ–Љ–∞–љ–і—Г —А–∞–±–Њ—В–∞—В—М –і–Њ–ї—М—И–µ, –љ–Њ –Љ–Њ–ґ–µ—В –њ–Њ–Ј–≤–Њ–ї–Є—В—М –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А—Г —Б—В—А–Њ–Є—В—М –±–Њ–ї–µ–µ –±—Л—Б—В—А—Л–µ –њ–ї–∞–љ—Л, –Є—Б–њ–Њ–ї—М–Ј—Г—П –њ–Њ–ї—Г—З–µ–љ–љ—Л–µ –і–Њ–њ–Њ–ї–љ–Є—В–µ–ї—М–љ—Л–µ –і–∞–љ–љ—Л–µ. –Ю–±—К—С–Љ —Б—В–∞—В–Є—Б—В–Є–Ї–Є –і–ї—П –Ї–Њ–љ–Ї—А–µ—В–љ–Њ–≥–Њ –њ–Њ–ї—П –Љ–Њ–ґ–µ—В –±—Л—В—М –Ј–∞–і–∞–љ –Ї–Њ–Љ–∞–љ–і–Њ–є ALTER TABLE ...SET STATISTICS.

- effective_cache_size

–≠—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А —Б–Њ–Њ–±—Й–∞–µ—В PostgreSQL –њ—А–Є–Љ–µ—А–љ—Л–є –Њ–±—К—С–Љ —Д–∞–є–ї–Њ–≤–Њ–≥–Њ –Ї—Н—И–∞ –Њ–њ–µ—А–∞—Ж–Є–Њ–љ–љ–Њ–є —Б–Є—Б—В–µ–Љ—Л, –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В —Н—В—Г –Њ—Ж–µ–љ–Ї—Г –і–ї—П –њ–Њ—Б—В—А–Њ–µ–љ–Є—П –њ–ї–∞–љ–∞ –Ј–∞–њ—А–Њ—Б–∞4.

–Я—Г—Б—В—М –≤ –≤–∞—И–µ–Љ –Ї–Њ–Љ–њ—М—О—В–µ—А–µ 1,5 –У–С –њ–∞–Љ—П—В–Є, –њ–∞—А–∞–Љ–µ—В—А shared_buffers —Г—Б—В–∞–љ–Њ–≤–ї–µ–љ –≤ 32 –Ь–С, –∞ –њ–∞—А–∞–Љ–µ—В—А effective_cache_size –≤ 800 –Ь–С. –Х—Б–ї–Є –Ј–∞–њ—А–Њ—Б—Г –љ—Г–ґ–љ–Њ 700 –Ь–С –і–∞–љ–љ—Л—Е, —В–Њ PostgreSQL –Њ—Ж–µ–љ–Є—В, —З—В–Њ –≤—Б–µ –љ—Г–ґ–љ—Л–µ –і–∞–љ–љ—Л–µ —Г–ґ–µ –µ—Б—В—М –≤ –њ–∞–Љ—П—В–Є –Є –≤—Л–±–µ—А–µ—В –±–Њ–ї–µ–µ –∞–≥—А–µ—Б—Б–Є–≤–љ—Л–є –њ–ї–∞–љ —Б –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ–Љ –Є–љ–і–µ–Ї—Б–Њ–≤ –Є merge joins. –Э–Њ –µ—Б–ї–Є effective_cache_size –±—Г–і–µ—В –≤—Б–µ–≥–Њ 200 –Ь–С, —В–Њ –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А –≤–њ–Њ–ї–љ–µ –Љ–Њ–ґ–µ—В –≤—Л–±—А–∞—В—М –±–Њ–ї–µ–µ —Н—Д—Д–µ–Ї—В–Є–≤–љ—Л–є –і–ї—П –і–Є—Б–Ї–Њ–≤–Њ–є —Б–Є—Б—В–µ–Љ—Л –њ–ї–∞–љ, –≤–Ї–ї—О—З–∞—О—Й–Є–є –њ–Њ–ї–љ—Л–є –њ—А–Њ—Б–Љ–Њ—В—А —В–∞–±–ї–Є—Ж—Л.

–Э–∞ –≤—Л–і–µ–ї–µ–љ–љ–Њ–Љ —Б–µ—А–≤–µ—А–µ –Є–Љ–µ–µ—В —Б–Љ—Л—Б–ї –≤—Л—Б—В–∞–≤–ї—П—В—М effective_cache_size –≤ 2/3 –Њ—В –≤—Б–µ–є –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є; –љ–∞ —Б–µ—А–≤–µ—А–µ —Б –і—А—Г–≥–Є–Љ–Є –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П–Љ–Є —Б–љ–∞—З–∞–ї–∞ –љ—Г–ґ–љ–Њ –≤—Л—З–µ—Б—В—М –Є–Ј –≤—Б–µ–≥–Њ –Њ–±—К–µ–Љ–∞ RAM —А–∞–Ј–Љ–µ—А –і–Є—Б–Ї–Њ–≤–Њ–≥–Њ –Ї—Н—И–∞ –Ю–° –Є –њ–∞–Љ—П—В—М, –Ј–∞–љ—П—В—Г—О –Њ—Б—В–∞–ї—М–љ—Л–Љ–Є –њ—А–Њ—Ж–µ—Б—Б–∞–Љ–Є.

- random_page_cost

–Я–µ—А–µ–Љ–µ–љ–љ–∞—П, —Г–Ї–∞–Ј—Л–≤–∞—О—Й–∞—П –љ–∞ —Г—Б–ї–Њ–≤–љ—Г—О —Б—В–Њ–Є–Љ–Њ—Б—В—М –Є–љ–і–µ–Ї—Б–љ–Њ–≥–Њ –і–Њ—Б—В—Г–њ–∞ –Ї —Б—В—А–∞–љ–Є—Ж–∞–Љ –і–∞–љ–љ—Л—Е. –Э–∞ —Б–µ—А–≤–µ—А–∞—Е —Б –±—Л—Б—В—А—Л–Љ–Є –і–Є—Б–Ї–Њ–≤—Л–Љ–Є –Љ–∞—Б—Б–Є–≤–∞–Љ–Є –Є–Љ–µ–µ—В —Б–Љ—Л—Б–ї —Г–Љ–µ–љ—М—И–∞—В—М –Є–Ј–љ–∞—З–∞–ї—М–љ—Г—О –љ–∞—Б—В—А–Њ–є–Ї—Г –і–Њ 3.0, 2.5 –Є–ї–Є –і–∞–ґ–µ –і–Њ 2.0. –Х—Б–ї–Є –ґ–µ –∞–Ї—В–Є–≤–љ–∞—П —З–∞—Б—В—М –≤–∞—И–µ–є –±–∞–Ј—Л –і–∞–љ–љ—Л—Е –љ–∞–Љ–љ–Њ–≥–Њ –±–Њ–ї—М—И–µ —А–∞–Ј–Љ–µ—А–Њ–≤ –Њ–њ–µ—А–∞—В–Є–≤–љ–Њ–є –њ–∞–Љ—П—В–Є, –њ–Њ–њ—А–Њ–±—Г–є—В–µ –њ–Њ–і–љ—П—В—М –Ј–љ–∞—З–µ–љ–Є–µ –њ–∞—А–∞–Љ–µ—В—А–∞. –Ь–Њ–ґ–љ–Њ –њ–Њ–і–Њ–є—В–Є –Ї –≤—Л–±–Њ—А—Г –Њ–њ—В–Є–Љ–∞–ї—М–љ–Њ–≥–Њ –Ј–љ–∞—З–µ–љ–Є—П –Є —Б–Њ —Б—В–Њ—А–Њ–љ—Л –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є –Ј–∞–њ—А–Њ—Б–Њ–≤. –Х—Б–ї–Є –њ–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї –Ј–∞–њ—А–Њ—Б–Њ–≤ —З–∞—Й–µ, —З–µ–Љ –љ–µ–Њ–±—Е–Њ–і–Є–Љ–Њ, –њ—А–µ–і–њ–Њ—З–Є—В–∞–µ—В –њ–Њ—Б–ї–µ–і–Њ–≤–∞—В–µ–ї—М–љ—Л–µ –њ—А–Њ—Б–Љ–Њ—В—А—Л (sequential scans) –њ—А–Њ—Б–Љ–Њ—В—А–∞–Љ —Б –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ–Љ –Є–љ–і–µ–Ї—Б–∞ (index scans), –њ–Њ–љ–Є–ґ–∞–є—В–µ –Ј–љ–∞—З–µ–љ–Є–µ. –Ш –љ–∞–Њ–±–Њ—А–Њ—В, –µ—Б–ї–Є –њ–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї –≤—Л–±–Є—А–∞–µ—В –њ—А–Њ—Б–Љ–Њ—В—А –њ–Њ –Љ–µ–і–ї–µ–љ–љ–Њ–Љ—Г –Є–љ–і–µ–Ї—Б—Г, –Ї–Њ–≥–і–∞ –љ–µ –і–Њ–ї–ґ–µ–љ —Н—В–Њ–≥–Њ –і–µ–ї–∞—В—М, –љ–∞—Б—В—А–Њ–є–Ї—Г –Є–Љ–µ–µ—В —Б–Љ—Л—Б–ї —Г–≤–µ–ї–Є—З–Є—В—М. –Я–Њ—Б–ї–µ –Є–Ј–Љ–µ–љ–µ–љ–Є—П —В—Й–∞—В–µ–ї—М–љ–Њ —В–µ—Б—В–Є—А—Г–є—В–µ —А–µ–Ј—Г–ї—М—В–∞—В—Л –љ–∞ –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ —И–Є—А–Њ–Ї–Њ–Љ –љ–∞–±–Њ—А–µ –Ј–∞–њ—А–Њ—Б–Њ–≤. –Э–Є–Ї–Њ–≥–і–∞ –љ–µ –Њ–њ—Г—Б–Ї–∞–є—В–µ –Ј–љ–∞—З–µ–љ–Є–µ random_page_cost –љ–Є–ґ–µ 2.0; –µ—Б–ї–Є –≤–∞–Љ –Ї–∞–ґ–µ—В—Б—П, —З—В–Њ random_page_cost –љ—Г–ґ–љ–Њ –µ—Й–µ –њ–Њ–љ–Є–ґ–∞—В—М, —А–∞–Ј—Г–Љ–љ–µ–µ –≤ —Н—В–Њ–Љ —Б–ї—Г—З–∞–µ –Љ–µ–љ—П—В—М –љ–∞—Б—В—А–Њ–є–Ї–Є —Б—В–∞—В–Є—Б—В–Є–Ї–Є –њ–ї–∞–љ–Є—А–Њ–≤—Й–Є–Ї–∞.

4 –°–±–Њ—А —Б—В–∞—В–Є—Б—В–Є–Ї–Є

–£ PostgreSQL —В–∞–Ї–ґ–µ –µ—Б—В—М —Б–њ–µ—Ж–Є–∞–ї—М–љ–∞—П –њ–Њ–і—Б–Є—Б—В–µ–Љ–∞ -- —Б–±–Њ—А—Й–Є–Ї —Б—В–∞—В–Є—Б—В–Є–Ї–Є, -- –Ї–Њ—В–Њ—А–∞—П –≤ —А–µ–∞–ї—М–љ–Њ–Љ –≤—А–µ–Љ–µ–љ–Є —Б–Њ–±–Є—А–∞–µ—В –і–∞–љ–љ—Л–µ –Њ–± –∞–Ї—В–Є–≤–љ–Њ—Б—В–Є —Б–µ—А–≤–µ—А–∞. –Я–Њ—Б–Ї–Њ–ї—М–Ї—Г —Б–±–Њ—А —Б—В–∞—В–Є—Б—В–Є–Ї–Є —Б–Њ–Ј–і–∞–µ—В –і–Њ–њ–Њ–ї–љ–Є—В–µ–ї—М–љ—Л–µ –љ–∞–Ї–ї–∞–і–љ—Л–µ —А–∞—Б—Е–Њ–і—Л –љ–∞ –±–∞–Ј—Г –і–∞–љ–љ—Л—Е, —В–Њ —Б–Є—Б—В–µ–Љ–∞ –Љ–Њ–ґ–µ—В –±—Л—В—М –љ–∞—Б—В—А–Њ–µ–љ–∞ –Ї–∞–Ї –љ–∞ —Б–±–Њ—А, —В–∞–Ї –Є –љ–µ —Б–±–Њ—А —Б—В–∞—В–Є—Б—В–Є–Ї–Є –≤–Њ–Њ–±—Й–µ. –≠—В–∞ —Б–Є—Б—В–µ–Љ–∞ –Ї–Њ–љ—В—А–Њ–ї–Є—А—Г–µ—В—Б—П —Б–ї–µ–і—Г—О—Й–Є–Љ–Є –њ–∞—А–∞–Љ–µ—В—А–∞–Љ–Є, –њ—А–Є–љ–Є–Љ–∞—О—Й–Є–Љ–Є –Ј–љ–∞—З–µ–љ–Є—П true/false:- track_counts –≤–Ї–ї—О—З–∞—В—М –ї–Є —Б–±–Њ—А —Б—В–∞—В–Є—Б—В–Є–Ї–Є. –Я–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О –≤–Ї–ї—О—З—С–љ, –њ–Њ—Б–Ї–Њ–ї—М–Ї—Г autovacuum –і–µ–Љ–Њ–љ—Г —В—А–µ–±—Г–µ—В—Б—П —Б–±–Њ—А —Б—В–∞—В–Є—Б—В–Є–Ї–Є. –Ю—В–Ї–ї—О—З–∞–є—В–µ, —В–Њ–ї—М–Ї–Њ –µ—Б–ї–Є —Б—В–∞—В–Є—Б—В–Є–Ї–∞ –≤–∞—Б —Б–Њ–≤–µ—А—И–µ–љ–љ–Њ –љ–µ –Є–љ—В–µ—А–µ—Б—Г–µ—В (–Ї–∞–Ї –Є autovacuum).

- track_functions –Њ—В—Б–ї–µ–ґ–Є–≤–∞–љ–Є–µ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П –Њ–њ—А–µ–і–µ–ї–µ–љ–љ—Л—Е –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї–µ–Љ —Д—Г–љ–Ї—Ж–Є–є.

- track_activities –њ–µ—А–µ–і–∞–≤–∞—В—М –ї–Є —Б–±–Њ—А—Й–Є–Ї—Г —Б—В–∞—В–Є—Б—В–Є–Ї–Є –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—О –Њ —В–µ–Ї—Г—Й–µ–є –≤—Л–њ–Њ–ї–љ—П–µ–Љ–Њ–є –Ї–Њ–Љ–∞–љ–і–µ –Є –≤—А–µ–Љ–µ–љ–Є –љ–∞—З–∞–ї–∞ –µ—С –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П. –Я–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О —Н—В–∞ –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В—М –≤–Ї–ї—О—З–µ–љ–∞. –°–ї–µ–і—Г–µ—В –Њ—В–Љ–µ—В–Є—В—М, —З—В–Њ —Н—В–∞ –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П –±—Г–і–µ—В –і–Њ—Б—В—Г–њ–љ–∞ —В–Њ–ї—М–Ї–Њ –њ—А–Є–≤–Є–ї–µ–≥–Є—А–Њ–≤–∞–љ–љ—Л–Љ –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—П–Љ –Є –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—П–Љ, –Њ—В –ї–Є—Ж–∞ –Ї–Њ—В–Њ—А—Л—Е –Ј–∞–њ—Г—Й–µ–љ—Л –Ї–Њ–Љ–∞–љ–і—Л, —В–∞–Ї —З—В–Њ –њ—А–Њ–±–ї–µ–Љ —Б –±–µ–Ј–Њ–њ–∞—Б–љ–Њ—Б—В—М—О –±—Л—В—М –љ–µ –і–Њ–ї–ґ–љ–Њ.

–Ф–∞–љ–љ—Л–µ, –њ–Њ–ї—Г—З–µ–љ–љ—Л–µ —Б–±–Њ—А—Й–Є–Ї–Њ–Љ —Б—В–∞—В–Є—Б—В–Є–Ї–Є, –і–Њ—Б—В—Г–њ–љ—Л —З–µ—А–µ–Ј —Б–њ–µ—Ж–Є–∞–ї—М–љ—Л–µ —Б–Є—Б—В–µ–Љ–љ—Л–µ –њ—А–µ–і—Б—В–∞–≤–ї–µ–љ–Є—П. –Я—А–Є —Г—Б—В–∞–љ–Њ–≤–Ї–∞—Е –њ–Њ —Г–Љ–Њ–ї—З–∞–љ–Є—О —Б–Њ–±–Є—А–∞–µ—В—Б—П –Њ—З–µ–љ—М –Љ–∞–ї–Њ –Є–љ—Д–Њ—А–Љ–∞—Ж–Є–Є, —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П –≤–Ї–ї—О—З–Є—В—М –≤—Б–µ –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В–Є: –і–Њ–њ–Њ–ї–љ–Є—В–µ–ї—М–љ–∞—П –љ–∞–≥—А—Г–Ј–Ї–∞ –±—Г–і–µ—В –љ–µ–≤–µ–ї–Є–Ї–∞, –≤ —В–Њ –≤—А–µ–Љ—П –Ї–∞–Ї –њ–Њ–ї—Г—З–µ–љ–љ—Л–µ –і–∞–љ–љ—Л–µ –њ–Њ–Ј–≤–Њ–ї—П—В –Њ–њ—В–Є–Љ–Є–Ј–Є—А–Њ–≤–∞—В—М –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –Є–љ–і–µ–Ї—Б–Њ–≤ (–∞ —В–∞–Ї–ґ–µ –њ–Њ–Љ–Њ–≥—Г—В –Њ–њ—В–Є–Љ–∞–ї—М–љ–Њ–є —А–∞–±–Њ—В–µ autovacuum –і–µ–Љ–Њ–љ—Г).

3 –Ф–Є—Б–Ї–Є –Є —Д–∞–є–ї–Њ–≤—Л–µ —Б–Є—Б—В–µ–Љ—Л

–Ю—З–µ–≤–Є–і–љ–Њ, —З—В–Њ –Њ—В –Ї–∞—З–µ—Б—В–≤–µ–љ–љ–Њ–є –і–Є—Б–Ї–Њ–≤–Њ–є –њ–Њ–і—Б–Є—Б—В–µ–Љ—Л –≤ —Б–µ—А–≤–µ—А–µ –С–Ф –Ј–∞–≤–Є—Б–Є—В –љ–µ–Љ–∞–ї–∞—П —З–∞—Б—В—М –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є. –Т–Њ–њ—А–Њ—Б—Л –≤—Л–±–Њ—А–∞ –Є —В–Њ–љ–Ї–Њ–є –љ–∞—Б—В—А–Њ–є–Ї–Є «–ґ–µ–ї–µ–Ј–∞», –≤–њ—А–Њ—З–µ–Љ, –љ–µ —П–≤–ї—П—О—В—Б—П —В–µ–Љ–Њ–є –і–∞–љ–љ–Њ–є —Б—В–∞—В—М–Є, –Њ–≥—А–∞–љ–Є—З–Є–Љ—Б—П —Г—А–Њ–≤–љ–µ–Љ —Д–∞–є–ї–Њ–≤–Њ–є —Б–Є—Б—В–µ–Љ—Л.–Х–і–Є–љ–Њ–≥–Њ –Љ–љ–µ–љ–Є—П –љ–∞—Б—З—С—В –љ–∞–Є–±–Њ–ї–µ–µ –њ–Њ–і—Е–Њ–і—П—Й–µ–є –і–ї—П PostgreSQL —Д–∞–є–ї–Њ–≤–Њ–є —Б–Є—Б—В–µ–Љ—Л –љ–µ—В, –њ–Њ—Н—В–Њ–Љ—Г —А–µ–Ї–Њ–Љ–µ–љ–і—Г–µ—В—Б—П –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —В—Г, –Ї–Њ—В–Њ—А–∞—П –ї—Г—З—И–µ –≤—Б–µ–≥–Њ –њ–Њ–і–і–µ—А–ґ–Є–≤–∞–µ—В—Б—П –≤–∞—И–µ–є –Њ–њ–µ—А–∞—Ж–Є–Њ–љ–љ–Њ–є —Б–Є—Б—В–µ–Љ–Њ–є. –Я—А–Є —Н—В–Њ–Љ —Г—З—В–Є—В–µ, —З—В–Њ —Б–Њ–≤—А–µ–Љ–µ–љ–љ—Л–µ –ґ—Г—А–љ–∞–ї–Є—А—Г—О—Й–Є–µ —Д–∞–є–ї–Њ–≤—Л–µ —Б–Є—Б—В–µ–Љ—Л –љ–µ –љ–∞–Љ–љ–Њ–≥–Њ –Љ–µ–і–ї–µ–љ–љ–µ–µ –љ–µ–ґ—Г—А–љ–∞–ї–Є—А—Г—О—Й–Є—Е, –∞ –≤—Л–Є–≥—А—Л—И -- –±—Л—Б—В—А–Њ–µ –≤–Њ—Б—Б—В–∞–љ–Њ–≤–ї–µ–љ–Є–µ –њ–Њ—Б–ї–µ —Б–±–Њ–µ–≤ -- –Њ—В –Є—Е –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П –≤–µ–ї–Є–Ї.

–Т—Л –ї–µ–≥–Ї–Њ –Љ–Њ–ґ–µ—В–µ –њ–Њ–ї—Г—З–Є—В—М –≤—Л–Є–≥—А—Л—И –≤ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є –±–µ–Ј –њ–Њ–±–Њ—З–љ—Л—Е —Н—Д—Д–µ–Ї—В–Њ–≤, –µ—Б–ї–Є –њ—А–Є–Љ–Њ–љ—В–Є—А—Г–µ—В–µ —Д–∞–є–ї–Њ–≤—Г—О —Б–Є—Б—В–µ–Љ—Г, —Б–Њ–і–µ—А–ґ–∞—Й—Г—О –±–∞–Ј—Г –і–∞–љ–љ—Л—Е, —Б –њ–∞—А–∞–Љ–µ—В—А–Њ–Љ noatime5.

1 –Я–µ—А–µ–љ–Њ—Б –ґ—Г—А–љ–∞–ї–∞ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –љ–∞ –Њ—В–і–µ–ї—М–љ—Л–є –і–Є—Б–Ї

–Я—А–Є –і–Њ—Б—В—Г–њ–µ –Ї –і–Є—Б–Ї—Г –Є–Ј—А—П–і–љ–Њ–µ –≤—А–µ–Љ—П –Ј–∞–љ–Є–Љ–∞–µ—В –љ–µ —В–Њ–ї—М–Ї–Њ —Б–Њ–±—Б—В–≤–µ–љ–љ–Њ —З—В–µ–љ–Є–µ –і–∞–љ–љ—Л—Е, –љ–Њ –Є –њ–µ—А–µ–Љ–µ—Й–µ–љ–Є–µ –Љ–∞–≥–љ–Є—В–љ–Њ–є –≥–Њ–ї–Њ–≤–Ї–Є.–Х—Б–ї–Є –≤ –≤–∞—И–µ–Љ —Б–µ—А–≤–µ—А–µ –µ—Б—В—М –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ —Д–Є–Ј–Є—З–µ—Б–Ї–Є—Е –і–Є—Б–Ї–Њ–≤6, —В–Њ –≤—Л –Љ–Њ–ґ–µ—В–µ —А–∞–Ј–љ–µ—Б—В–Є —Д–∞–є–ї—Л –±–∞–Ј—Л –і–∞–љ–љ—Л—Е –Є –ґ—Г—А–љ–∞–ї —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є –њ–Њ —А–∞–Ј–љ—Л–Љ –і–Є—Б–Ї–∞–Љ. –Ф–∞–љ–љ—Л–µ –≤ —Б–µ–≥–Љ–µ–љ—В—Л –ґ—Г—А–љ–∞–ї–∞ –њ–Є—И—Г—В—Б—П –њ–Њ—Б–ї–µ–і–Њ–≤–∞—В–µ–ї—М–љ–Њ, –±–Њ–ї–µ–µ —В–Њ–≥–Њ, –Ј–∞–њ–Є—Б–Є –≤ –ґ—Г—А–љ–∞–ї–µ —В—А–∞–љ–Ј–∞–Ї—Ж–Є–є —Б—А–∞–Ј—Г —Б–±—А–∞—Б—Л–≤–∞—О—В—Б—П –љ–∞ –і–Є—Б–Ї, –њ–Њ—Н—В–Њ–Љ—Г –≤ —Б–ї—Г—З–∞–µ –љ–∞—Е–Њ–ґ–і–µ–љ–Є—П –µ–≥–Њ –љ–∞ –Њ—В–і–µ–ї—М–љ–Њ–Љ –і–Є—Б–Ї–µ –Љ–∞–≥–љ–Є—В–љ–∞—П –≥–Њ–ї–Њ–≤–Ї–∞ –љ–µ –±—Г–і–µ—В –ї–Є—И–љ–Є–є —А–∞–Ј –і–≤–Є–≥–∞—В—М—Б—П, —З—В–Њ –њ–Њ–Ј–≤–Њ–ї–Є—В —Г—Б–Ї–Њ—А–Є—В—М –Ј–∞–њ–Є—Б—М.

–Я–Њ—А—П–і–Њ–Ї –і–µ–є—Б—В–≤–Є–є:

- –Ю—Б—В–∞–љ–Њ–≤–Є—В–µ —Б–µ—А–≤–µ—А (!).

- –Я–µ—А–µ–љ–µ—Б–Є—В–µ –Ї–∞—В–∞–ї–Њ–≥–Є pg_clog –Є pg_xlog, –љ–∞—Е–Њ–і—П—Й–Є–є—Б—П –≤ –Ї–∞—В–∞–ї–Њ–≥–µ —Б –±–∞–Ј–∞–Љ–Є –і–∞–љ–љ—Л—Е, –љ–∞ –і—А—Г–≥–Њ–є –і–Є—Б–Ї.

- –°–Њ–Ј–і–∞–є—В–µ –љ–∞ —Б—В–∞—А–Њ–Љ –Љ–µ—Б—В–µ —Б–Є–Љ–≤–Њ–ї–Є—З–µ—Б–Ї—Г—О —Б—Б—Л–ї–Ї—Г.

- –Ч–∞–њ—Г—Б—В–Є—В–µ —Б–µ—А–≤–µ—А.

–Я—А–Є–Љ–µ—А–љ–Њ —В–∞–Ї–Є–Љ –ґ–µ –Њ–±—А–∞–Ј–Њ–Љ –Љ–Њ–ґ–љ–Њ –њ–µ—А–µ–љ–µ—Б—В–Є –Є —З–∞—Б—В—М —Д–∞–є–ї–Њ–≤, —Б–Њ–і–µ—А–ґ–∞—Й–Є—Е —В–∞–±–ї–Є—Ж—Л –Є –Є–љ–і–µ–Ї—Б—Л, –љ–∞ –і—А—Г–≥–Њ–є –і–Є—Б–Ї, –љ–Њ –Ј–і–µ—Б—М –њ–Њ—В—А–µ–±—Г–µ—В—Б—П –±–Њ–ї—М—И–µ –Ї—А–Њ–њ–Њ—В–ї–Є–≤–Њ–є —А—Г—З–љ–Њ–є —А–∞–±–Њ—В—Л, –∞ –њ—А–Є –≤–љ–µ—Б–µ–љ–Є–Є –Є–Ј–Љ–µ–љ–µ–љ–Є–є –≤ —Б—Е–µ–Љ—Г –±–∞–Ј—Л –њ—А–Њ—Ж–µ–і—Г—А—Г, –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ, –њ—А–Є–і—С—В—Б—П –њ–Њ–≤—В–Њ—А–Є—В—М.

4 –Я—А–Є–Љ–µ—А—Л –љ–∞—Б—В—А–Њ–µ–Ї

1 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–є –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є

–Т–Њ–Ј–Љ–Њ–ґ–љ–Њ –і–ї—П –Ї–Њ–љ–Ї—А–µ—В–љ–Њ–≥–Њ —Б–ї—Г—З–∞—О –ї—Г—З—И–µ –њ–Њ–і–Њ–є–і—Г—В –і—А—Г–≥–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є. –Т–љ–Є–Љ–∞—В–µ–ї—М–љ–Њ –Є–Ј—Г—З–Є—В–µ –і–∞–љ–љ–Њ–µ —А—Г–Ї–Њ–≤–Њ–і—Б—В–≤–Њ –Є –љ–∞—Б—В—А–Њ–є—В–µ PostgreSQL –Њ–њ–µ—А–∞—П—Б—М –љ–∞ —Н—В—Г –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—О.

RAM -- —А–∞–Ј–Љ–µ—А –њ–∞–Љ—П—В–Є;

- shared_buffers = 1/8 RAM –Є–ї–Є –±–Њ–ї—М—И–µ (–љ–Њ –љ–µ –±–Њ–ї–µ–µ 1/4);

- work_mem –≤ 1/20 RAM;

- maintenance_work_mem –≤ 1/4 RAM;

- max_fsm_relations –≤ –њ–ї–∞–љ–Є—А—Г–µ–Љ–Њ–µ –Ї–Њ–ї-–≤–Њ —В–∞–±–ї–Є—Ж –≤ –±–∞–Ј–∞—Е * 1.5;

- max_fsm_pages –≤ max_fsm_relations * 2000;

- fsync = true;

- wal_sync_method = fdatasync;

- commit_delay = –Њ—В 10 –і–Њ 100 ;

- commit_siblings = –Њ—В 5 –і–Њ 10;

- effective_cache_size = 0.9 –Њ—В –Ј–љ–∞—З–µ–љ–Є—П cached, –Ї–Њ—В–Њ—А–Њ–µ –њ–Њ–Ї–∞–Ј—Л–≤–∞–µ—В free;

- random_page_cost = 2 –і–ї—П –±—Л—Б—В—А—Л—Е cpu, 4 –і–ї—П –Љ–µ–і–ї–µ–љ–љ—Л—Е;

- cpu_tuple_cost = 0.001 –і–ї—П –±—Л—Б—В—А—Л—Е cpu, 0.01 –і–ї—П –Љ–µ–і–ї–µ–љ–љ—Л—Е;

- cpu_index_tuple_cost = 0.0005 –і–ї—П –±—Л—Б—В—А—Л—Е cpu, 0.005 –і–ї—П –Љ–µ–і–ї–µ–љ–љ—Л—Е;

- autovacuum = on;

- autovacuum_vacuum_threshold = 1800;

- autovacuum_analyze_threshold = 900;

2 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П –Њ–Ї–Њ–љ–љ–Њ–≥–Њ –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П (1–°), 2 –У–С –њ–∞–Љ—П—В–Є

- maintenance_work_mem = 128MB

- effective_cache_size = 512MB

- work_mem = 640kB

- wal_buffers = 1536kB

- shared_buffers = 128MB

- max_connections = 500

3 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П Web –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, 2 –У–С –њ–∞–Љ—П—В–Є

- maintenance_work_mem = 128MB;

- checkpoint_completion_target = 0.7

- effective_cache_size = 1536MB

- work_mem = 4MB

- wal_buffers = 4MB

- checkpoint_segments = 8

- shared_buffers = 512MB

- max_connections = 500

4 –°—А–µ–і–љ–µ—Б—В–∞—В–Є—Б—В–Є—З–µ—Б–Ї–∞—П –љ–∞—Б—В—А–Њ–є–Ї–∞ –і–ї—П Web –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, 8 –У–С –њ–∞–Љ—П—В–Є

- maintenance_work_mem = 512MB

- checkpoint_completion_target = 0.7

- effective_cache_size = 6GB

- work_mem = 16MB

- wal_buffers = 4MB

- checkpoint_segments = 8

- shared_buffers = 2GB

- max_connections = 500

5 –Р–≤—В–Њ–Љ–∞—В–Є—З–µ—Б–Ї–Њ–µ —Б–Њ–Ј–і–∞–љ–Є–µ –Њ–њ—В–Є–Љ–∞–ї—М–љ—Л—Е –љ–∞—Б—В—А–Њ–µ–Ї: pgtune

–Ф–ї—П –Њ–њ—В–Є–Љ–Є–Ј–∞—Ж–Є–Є –љ–∞—Б—В—А–Њ–µ–Ї –і–ї—П PostgreSQL Gregory Smith —Б–Њ–Ј–і–∞–ї —Г—В–Є–ї–Є—В—Г pgtune7

–≤ —А–∞—Б—З–µ—В–µ –љ–∞ –Њ–±–µ—Б–њ–µ—З–µ–љ–Є–µ –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–є –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В–Є –і–ї—П –Ј–∞–і–∞–љ–љ–Њ–є –∞–њ–њ–∞—А–∞—В–љ–Њ–є –Ї–Њ–љ—Д–Є–≥—Г—А–∞—Ж–Є–Є.

–£—В–Є–ї–Є—В–∞ –њ—А–Њ—Б—В–∞ –≤ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–Є –Є –≤ –Љ–љ–Њ–≥–Є—Е Linux —Б–Є—Б—В–µ–Љ–∞—Е –Љ–Њ–ґ–µ—В –Є–і—В–Є –≤ —Б–Њ—Б—В–∞–≤–µ –њ–∞–Ї–µ—В–Њ–≤.

–Х—Б–ї–Є –ґ–µ –љ–µ—В, –Љ–Њ–ґ–љ–Њ –њ—А–Њ—Б—В–Њ —Б–Ї–∞—З–∞—В—М –∞—А—Е–Є–≤ –Є —А–∞—Б–њ–∞–Ї–Њ–≤–∞—В—М.

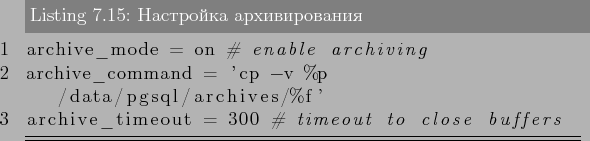

–Ф–ї—П –љ–∞—З–∞–ї–∞:

![\begin{lstlisting}[label=lst:p_settings1,caption=Pgtune]

pgtune -i $PGDATA/postgresql.conf \

-o $PGDATA/postgresql.conf.pgtune

\end{lstlisting}](postgresql-img3.png)

–Њ–њ—Ж–Є–µ–є

[frame=tblr]-i, -input-config

—Г–Ї–∞–Ј—Л–≤–∞–µ–Љ —В–µ–Ї—Г—Й–Є–є —Д–∞–є–ї postgresql.conf,

–∞

[frame=tblr]-o, -output-config

—Г–Ї–∞–Ј—Л–≤–∞–µ–Љ –Є–Љ—П —Д–∞–є–ї–∞ –і–ї—П –љ–Њ–≤–Њ–≥–Њ postgresql.conf.

–Х—Б—В—М —В–∞–Ї–ґ–µ –і–Њ–њ–Њ–ї–љ–Є—В–µ–ї—М–љ—Л–µ –Њ–њ—Ж–Є–Є –і–ї—П –љ–∞—Б—В—А–Њ–є–Ї–Є –Ї–Њ–љ—Д–Є–≥–∞.

- [frame=single]-M, -memory

–Ш—Б–њ–Њ–ї—М–Ј—Г–є—В–µ —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А, —З—В–Њ–±—Л –Њ–њ—А–µ–і–µ–ї–Є—В—М –Њ–±—Й–Є–є –Њ–±—К–µ–Љ —Б–Є—Б—В–µ–Љ–љ–Њ–є –њ–∞–Љ—П—В–Є.

–Х—Б–ї–Є –љ–µ —Г–Ї–∞–Ј–∞–љ–Њ, pgtune –±—Г–і–µ—В –њ—Л—В–∞—В—М—Б—П –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —В–µ–Ї—Г—Й–Є–є –Њ–±—К–µ–Љ —Б–Є—Б—В–µ–Љ–љ–Њ–є –њ–∞–Љ—П—В–Є.

- [frame=single]-T, -type

–£–Ї–∞–Ј—Л–≤–∞–µ—В —В–Є–њ –±–∞–Ј—Л –і–∞–љ–љ—Л—Е. –Ю–њ—Ж–Є–Є: DW, OLTP, Web, Mixed, Desktop.

- [frame=single]-c, -connections

–£–Ї–∞–Ј—Л–≤–∞–µ—В –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —Б–Њ–µ–і–Є–љ–µ–љ–Є–є. –Х—Б–ї–Є –Њ–љ –љ–µ —Г–Ї–∞–Ј–∞–љ, —Н—В–Њ –±—Г–і–µ—В –±—А–∞—В—Б—П –≤–Ј–∞–≤–Є—Б–Є–Љ–Њ—Б—В–Є –Њ—В —В–Є–њ–∞ –±–∞–Ј—Л –і–∞–љ–љ—Л—Е.

–•–Њ—З–µ—В—Б—П —Б—А–∞–Ј—Г –і–Њ–±–∞–≤–Є—В—М, —З—В–Њ pgtune –љ–µ –њ–∞–љ–∞—Ж–µ—П –і–ї—П –Њ–њ—В–Є–Љ–Є–Ј–∞—Ж–Є–Є –љ–∞—Б—В—А–Њ–є–Ї–Є PostgreSQL. –Ь–љ–Њ–≥–Є–µ –љ–∞—Б—В—А–Њ–є–Ї–Є –Ј–∞–≤–Є—Б—П—В –љ–µ —В–Њ–ї—М–Ї–Њ –Њ—В –∞–њ–њ–∞—А–∞—В–љ–Њ–є –Ї–Њ–љ—Д–Є–≥—Г—А–∞—Ж–Є–Є, –љ–Њ –Є –Њ—В —А–∞–Ј–Љ–µ—А–∞ –±–∞–Ј—Л –і–∞–љ–љ—Л—Е, —З–Є—Б–ї–∞ —Б–Њ–µ–і–Є–љ–µ–љ–Є–є –Є —Б–ї–Њ–ґ–љ–Њ—Б—В—М –Ј–∞–њ—А–Њ—Б–Њ–≤, —В–∞–Ї —З—В–Њ –Њ–њ—В–Є–Љ–∞–ї—М–љ–Њ –љ–∞—Б—В—А–Њ–Є—В—М –±–∞–Ј—Г –і–∞–љ–љ—Л—Е –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ —Г—З–Є—В—Л–≤–∞—П –≤—Б–µ —Н—В–Є –њ–∞—А–∞–Љ–µ—В—А—Л.

6 –Ю–њ—В–Є–Љ–Є–Ј–∞—Ж–Є—П –С–Ф –Є –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П

–Ф–ї—П –±—Л—Б—В—А–Њ–є —А–∞–±–Њ—В—Л –Ї–∞–ґ–і–Њ–≥–Њ –Ј–∞–њ—А–Њ—Б–∞ –≤ –≤–∞—И–µ–є –±–∞–Ј–µ –≤ –Њ—Б–љ–Њ–≤–љ–Њ–Љ —В—А–µ–±—Г–µ—В—Б—П —Б–ї–µ–і—Г—О—Й–µ–µ:- –Ю—В—Б—Г—В—Б—В–≤–Є–µ –≤ –±–∞–Ј–µ –Љ—Г—Б–Њ—А–∞, –Љ–µ—И–∞—О—Й–µ–≥–Њ –і–Њ–±—А–∞—В—М—Б—П –і–Њ –∞–Ї—В—Г–∞–ї—М–љ—Л—Е –і–∞–љ–љ—Л—Е. –Ь–Њ–ґ–љ–Њ —Б—Д–Њ—А–Љ—Г–ї–Є—А–Њ–≤–∞—В—М –і–≤–µ –њ–Њ–і–Ј–∞–і–∞—З–Є:

- –У—А–∞–Љ–Њ—В–љ–Њ–µ –њ—А–Њ–µ–Ї—В–Є—А–Њ–≤–∞–љ–Є–µ –±–∞–Ј—Л. –Ю—Б–≤–µ—Й–µ–љ–Є–µ —Н—В–Њ–≥–Њ –≤–Њ–њ—А–Њ—Б–∞ –≤—Л—Е–Њ–і–Є—В –і–∞–ї–µ–Ї–Њ –Ј–∞ —А–∞–Љ–Ї–Є —Н—В–Њ–є —Б—В–∞—В—М–Є.

- –°–±–Њ—А–Ї–∞ –Љ—Г—Б–Њ—А–∞, –≤–Њ–Ј–љ–Є–Ї–∞—О—Й–µ–≥–Њ –њ—А–Є —А–∞–±–Њ—В–µ –°–£–С–Ф.

- –Э–∞–ї–Є—З–Є–µ –±—Л—Б—В—А—Л—Е –њ—Г—В–µ–є –і–Њ—Б—В—Г–њ–∞ –Ї –і–∞–љ–љ—Л–Љ -- –Є–љ–і–µ–Ї—Б–Њ–≤.

- –Т–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В—М –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А–Њ–Љ —Н—В–Є—Е –±—Л—Б—В—А—Л—Е –њ—Г—В–µ–є.

- –Ю–±—Е–Њ–і –Є–Ј–≤–µ—Б—В–љ—Л—Е –њ—А–Њ–±–ї–µ–Љ.

1 –Я–Њ–і–і–µ—А–ґ–∞–љ–Є–µ –±–∞–Ј—Л –≤ –њ–Њ—А—П–і–Ї–µ

–Т –і–∞–љ–љ–Њ–Љ —А–∞–Ј–і–µ–ї–µ –Њ–њ–Є—Б–∞–љ—Л –і–µ–є—Б—В–≤–Є—П, –Ї–Њ—В–Њ—А—Л–µ –і–Њ–ї–ґ–љ—Л –њ–µ—А–Є–Њ–і–Є—З–µ—Б–Ї–Є –≤—Л–њ–Њ–ї–љ—П—В—М—Б—П –і–ї—П –Ї–∞–ґ–і–Њ–є –±–∞–Ј—Л. –Ю—В —А–∞–Ј—А–∞–±–Њ—В—З–Є–Ї–∞ —В—А–µ–±—Г–µ—В—Б—П —В–Њ–ї—М–Ї–Њ –љ–∞—Б—В—А–Њ–Є—В—М –Є—Е –∞–≤—В–Њ–Љ–∞—В–Є—З–µ—Б–Ї–Њ–µ –≤—Л–њ–Њ–ї–љ–µ–љ–Є–µ (–њ—А–Є –њ–Њ–Љ–Њ—Й–Є cron) –Є –Њ–њ—Л—В–љ—Л–Љ –њ—Г—В—С–Љ –њ–Њ–і–Њ–±—А–∞—В—М –µ–≥–Њ –Њ–њ—В–Є–Љ–∞–ї—М–љ—Г—О —З–∞—Б—В–Њ—В—Г.

1 –Ъ–Њ–Љ–∞–љ–і–∞ ANALYZE

–°–ї—Г–ґ–Є—В –і–ї—П –Њ–±–љ–Њ–≤–ї–µ–љ–Є—П –Є–љ—Д–Њ—А–Љ–∞—Ж–Є–Є –Њ —А–∞—Б–њ—А–µ–і–µ–ї–µ–љ–Є–Є –і–∞–љ–љ—Л—Е –≤ —В–∞–±–ї–Є—Ж–µ. –≠—В–∞ –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В—Б—П –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А–Њ–Љ –і–ї—П –≤—Л–±–Њ—А–∞ –љ–∞–Є–±–Њ–ї–µ–µ –±—Л—Б—В—А–Њ–≥–Њ –њ–ї–∞–љ–∞ –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–∞.–Ю–±—Л—З–љ–Њ –Ї–Њ–Љ–∞–љ–і–∞ –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В—Б—П –≤ —Б–≤—П–Ј–Ї–µ VACUUM ANALYZE. –Х—Б–ї–Є –≤ –±–∞–Ј–µ –µ—Б—В—М —В–∞–±–ї–Є—Ж—Л, –і–∞–љ–љ—Л–µ –≤ –Ї–Њ—В–Њ—А—Л—Е –љ–µ –Є–Ј–Љ–µ–љ—П—О—В—Б—П –Є –љ–µ —Г–і–∞–ї—П—О—В—Б—П, –∞ –ї–Є—И—М –і–Њ–±–∞–≤–ї—П—О—В—Б—П, —В–Њ –і–ї—П —В–∞–Ї–Є—Е —В–∞–±–ї–Є—Ж –Љ–Њ–ґ–љ–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –Њ—В–і–µ–ї—М–љ—Г—О –Ї–Њ–Љ–∞–љ–і—Г ANALYZE. –Ґ–∞–Ї–ґ–µ —Б—В–Њ–Є—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —Н—В—Г –Ї–Њ–Љ–∞–љ–і—Г –і–ї—П –Њ—В–і–µ–ї—М–љ–Њ–є —В–∞–±–ї–Є—Ж—Л –њ–Њ—Б–ї–µ –і–Њ–±–∞–≤–ї–µ–љ–Є—П –≤ –љ–µ—С –±–Њ–ї—М—И–Њ–≥–Њ –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ –Ј–∞–њ–Є—Б–µ–є.

2 –Ъ–Њ–Љ–∞–љ–і–∞ REINDEX

–Ъ–Њ–Љ–∞–љ–і–∞ REINDEX –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В—Б—П –і–ї—П –њ–µ—А–µ—Б—В—А–Њ–є–Ї–Є —Б—Г—Й–µ—Б—В–≤—Г—О—Й–Є—Е –Є–љ–і–µ–Ї—Б–Њ–≤. –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –µ—С –Є–Љ–µ–µ—В —Б–Љ—Л—Б–ї –≤ —Б–ї—Г—З–∞–µ:- –њ–Њ—А—З–Є –Є–љ–і–µ–Ї—Б–∞;

- –њ–Њ—Б—В–Њ—П–љ–љ–Њ–≥–Њ —Г–≤–µ–ї–Є—З–µ–љ–Є—П –µ–≥–Њ —А–∞–Ј–Љ–µ—А–∞.

–Т—В–Њ—А–Њ–є —Б–ї—Г—З–∞–є —В—А–µ–±—Г–µ—В –њ–Њ—П—Б–љ–µ–љ–Є–є. –Ш–љ–і–µ–Ї—Б, –Ї–∞–Ї –Є —В–∞–±–ї–Є—Ж–∞, —Б–Њ–і–µ—А–ґ–Є—В –±–ї–Њ–Ї–Є —Б–Њ —Б—В–∞—А—Л–Љ–Є –≤–µ—А—Б–Є—П–Љ–Є –Ј–∞–њ–Є—Б–µ–є. PostgreSQL –љ–µ –≤—Б–µ–≥–і–∞ –Љ–Њ–ґ–µ—В –Ј–∞–љ–Њ–≤–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —Н—В–Є –±–ї–Њ–Ї–Є, –Є –њ–Њ—Н—В–Њ–Љ—Г —Д–∞–є–ї —Б –Є–љ–і–µ–Ї—Б–Њ–Љ –њ–Њ—Б—В–µ–њ–µ–љ–љ–Њ —Г–≤–µ–ї–Є—З–Є–≤–∞–µ—В—Б—П –≤ —А–∞–Ј–Љ–µ—А–∞—Е. –Х—Б–ї–Є –і–∞–љ–љ—Л–µ –≤ —В–∞–±–ї–Є—Ж–µ —З–∞—Б—В–Њ –Љ–µ–љ—П—О—В—Б—П, —В–Њ —А–∞—Б—В–Є –Њ–љ –Љ–Њ–ґ–µ—В –≤–µ—Б—М–Љ–∞ –±—Л—Б—В—А–Њ.

–Х—Б–ї–Є –≤—Л –Ј–∞–Љ–µ—В–Є–ї–Є –њ–Њ–і–Њ–±–љ–Њ–µ –њ–Њ–≤–µ–і–µ–љ–Є–µ –Ї–∞–Ї–Њ–≥–Њ-—В–Њ –Є–љ–і–µ–Ї—Б–∞, —В–Њ —Б—В–Њ–Є—В –љ–∞—Б—В—А–Њ–Є—В—М –і–ї—П –љ–µ–≥–Њ –њ–µ—А–Є–Њ–і–Є—З–µ—Б–Ї–Њ–µ –≤—Л–њ–Њ–ї–љ–µ–љ–Є–µ –Ї–Њ–Љ–∞–љ–і—Л REINDEX. –£—З—В–Є—В–µ: –Ї–Њ–Љ–∞–љ–і–∞ REINDEX, –Ї–∞–Ї –Є VACUUM FULL, –њ–Њ–ї–љ–Њ—Б—В—М—О –±–ї–Њ–Ї–Є—А—Г–µ—В —В–∞–±–ї–Є—Ж—Г, –њ–Њ—Н—В–Њ–Љ—Г –≤—Л–њ–Њ–ї–љ—П—В—М –µ—С –љ–∞–і–Њ —В–Њ–≥–і–∞, –Ї–Њ–≥–і–∞ –Ј–∞–≥—А—Г–Ј–Ї–∞ —Б–µ—А–≤–µ—А–∞ –Љ–Є–љ–Є–Љ–∞–ї—М–љ–∞.

2 –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –Є–љ–і–µ–Ї—Б–Њ–≤

–Ю–њ—Л—В –њ–Њ–Ї–∞–Ј—Л–≤–∞–µ—В, —З—В–Њ –љ–∞–Є–±–Њ–ї–µ–µ –Ј–љ–∞—З–Є—В–µ–ї—М–љ—Л–µ –њ—А–Њ–±–ї–µ–Љ—Л —Б –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М—О –≤—Л–Ј—Л–≤–∞—О—В—Б—П –Њ—В—Б—Г—В—Б—В–≤–Є–µ–Љ –љ—Г–ґ–љ—Л—Е –Є–љ–і–µ–Ї—Б–Њ–≤. –Я–Њ—Н—В–Њ–Љ—Г —Б—В–Њ–ї–Ї–љ—Г–≤—И–Є—Б—М —Б –Љ–µ–і–ї–µ–љ–љ—Л–Љ –Ј–∞–њ—А–Њ—Б–Њ–Љ, –≤ –њ–µ—А–≤—Г—О –Њ—З–µ—А–µ–і—М –њ—А–Њ–≤–µ—А—М—В–µ, —Б—Г—Й–µ—Б—В–≤—Г—О—В –ї–Є –Є–љ–і–µ–Ї—Б—Л, –Ї–Њ—В–Њ—А—Л–µ –Њ–љ –Љ–Њ–ґ–µ—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М. –Х—Б–ї–Є –љ–µ—В -- –њ–Њ—Б—В—А–Њ–є—В–µ –Є—Е. –Ш–Ј–ї–Є—И–µ–Ї –Є–љ–і–µ–Ї—Б–Њ–≤, –≤–њ—А–Њ—З–µ–Љ, —В–Њ–ґ–µ —З—А–µ–≤–∞—В –њ—А–Њ–±–ї–µ–Љ–∞–Љ–Є:- –Ъ–Њ–Љ–∞–љ–і—Л, –Є–Ј–Љ–µ–љ—П—О—Й–Є–µ –і–∞–љ–љ—Л–µ –≤ —В–∞–±–ї–Є—Ж–µ, –і–Њ–ї–ґ–љ—Л –Є–Ј–Љ–µ–љ–Є—В—М —В–∞–Ї–ґ–µ –Є –Є–љ–і–µ–Ї—Б—Л. –Ю—З–µ–≤–Є–і–љ–Њ, —З–µ–Љ –±–Њ–ї—М—И–µ –Є–љ–і–µ–Ї—Б–Њ–≤ –њ–Њ—Б—В—А–Њ–µ–љ–Њ –і–ї—П —В–∞–±–ї–Є—Ж—Л, —В–µ–Љ –Љ–µ–і–ї–µ–љ–љ–µ–µ —Н—В–Њ –±—Г–і–µ—В –њ—А–Њ–Є—Б—Е–Њ–і–Є—В—М.

- –Ю–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А –њ–µ—А–µ–±–Є—А–∞–µ—В –≤–Њ–Ј–Љ–Њ–ґ–љ—Л–µ –њ—Г—В–Є –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–Њ–≤. –Х—Б–ї–Є –њ–Њ—Б—В—А–Њ–µ–љ–Њ –Љ–љ–Њ–≥–Њ –љ–µ–љ—Г–ґ–љ—Л—Е –Є–љ–і–µ–Ї—Б–Њ–≤, —В–Њ —Н—В–Њ—В –њ–µ—А–µ–±–Њ—А –±—Г–і–µ—В –Є–і—В–Є –і–Њ–ї—М—И–µ.

1 –Ъ–Њ–Љ–∞–љ–і–∞ EXPLAIN [ANALYZE]

–Ъ–Њ–Љ–∞–љ–і–∞ EXPLAIN [–Ј–∞–њ—А–Њ—Б] –њ–Њ–Ї–∞–Ј—Л–≤–∞–µ—В, –Ї–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ PostgreSQL —Б–Њ–±–Є—А–∞–µ—В—Б—П –≤—Л–њ–Њ–ї–љ—П—В—М –≤–∞—И –Ј–∞–њ—А–Њ—Б. –Ъ–Њ–Љ–∞–љ–і–∞ EXPLAIN ANALYZE [–Ј–∞–њ—А–Њ—Б] –≤—Л–њ–Њ–ї–љ—П–µ—В –Ј–∞–њ—А–Њ—Б8 –Є –њ–Њ–Ї–∞–Ј—Л–≤–∞–µ—В –Ї–∞–Ї –Є–Ј–љ–∞—З–∞–ї—М–љ—Л–є –њ–ї–∞–љ, —В–∞–Ї –Є —А–µ–∞–ї—М–љ—Л–є –њ—А–Њ—Ж–µ—Б—Б –µ–≥–Њ –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П.–І—В–µ–љ–Є–µ –≤—Л–≤–Њ–і–∞ —Н—В–Є—Е –Ї–Њ–Љ–∞–љ–і -- –Є—Б–Ї—Г—Б—Б—В–≤–Њ, –Ї–Њ—В–Њ—А–Њ–µ –њ—А–Є—Е–Њ–і–Є—В —Б –Њ–њ—Л—В–Њ–Љ. –Ф–ї—П –љ–∞—З–∞–ї–∞ –Њ–±—А–∞—Й–∞–є—В–µ –≤–љ–Є–Љ–∞–љ–Є–µ –љ–∞ —Б–ї–µ–і—Г—О—Й–µ–µ:

- –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –њ–Њ–ї–љ–Њ–≥–Њ –њ—А–Њ—Б–Љ–Њ—В—А–∞ —В–∞–±–ї–Є—Ж—Л (seq scan).

- –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –љ–∞–Є–±–Њ–ї–µ–µ –њ—А–Є–Љ–Є—В–Є–≤–љ–Њ–≥–Њ —Б–њ–Њ—Б–Њ–±–∞ –Њ–±—К–µ–і–Є–љ–µ–љ–Є—П —В–∞–±–ї–Є—Ж (nested loop).

- –Ф–ї—П EXPLAIN ANALYZE: –љ–µ—В –ї–Є –±–Њ–ї—М—И–Є—Е –Њ—В–ї–Є—З–Є–є –≤ –њ—А–µ–і–њ–Њ–ї–∞–≥–∞–µ–Љ–Њ–Љ –Ї–Њ–ї–Є—З–µ—Б—В–≤–µ –Ј–∞–њ–Є—Б–µ–є –Є —А–µ–∞–ї—М–љ–Њ –≤—Л–±—А–∞–љ–љ–Њ–Љ? –Х—Б–ї–Є –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В —Г—Б—В–∞—А–µ–≤—И—Г—О —Б—В–∞—В–Є—Б—В–Є–Ї—Г, —В–Њ –Њ–љ –Љ–Њ–ґ–µ—В –≤—Л–±–Є—А–∞—В—М –љ–µ —Б–∞–Љ—Л–є –±—Л—Б—В—А—Л–є –њ–ї–∞–љ –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–∞.

–°–ї–µ–і—Г–µ—В –Њ—В–Љ–µ—В–Є—В—М, —З—В–Њ –њ–Њ–ї–љ—Л–є –њ—А–Њ—Б–Љ–Њ—В—А —В–∞–±–ї–Є—Ж—Л –і–∞–ї–µ–Ї–Њ –љ–µ –≤—Б–µ–≥–і–∞ –Љ–µ–і–ї–µ–љ–љ–µ–µ –њ—А–Њ—Б–Љ–Њ—В—А–∞ –њ–Њ –Є–љ–і–µ–Ї—Б—Г. –Х—Б–ї–Є, –љ–∞–њ—А–Є–Љ–µ—А, –≤ —В–∞–±–ї–Є—Ж–µ-—Б–њ—А–∞–≤–Њ—З–љ–Є–Ї–µ –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ —Б–Њ—В–µ–љ –Ј–∞–њ–Є—Б–µ–є, —Г–Љ–µ—Й–∞—О—Й–Є—Е—Б—П –≤ –Њ–і–љ–Њ–Љ-–і–≤—Г—Е –±–ї–Њ–Ї–∞—Е –љ–∞ –і–Є—Б–Ї–µ, —В–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –Є–љ–і–µ–Ї—Б–∞ –њ—А–Є–≤–µ–і—С—В –ї–Є—И—М –Ї —В–Њ–Љ—Г, —З—В–Њ –њ—А–Є–і—С—В—Б—П —З–Є—В–∞—В—М –µ—Й—С –Є –њ–∞—А—Г –ї–Є—И–љ–Є—Е –±–ї–Њ–Ї–Њ–≤ –Є–љ–і–µ–Ї—Б–∞. –Х—Б–ї–Є –≤ –Ј–∞–њ—А–Њ—Б–µ –њ—А–Є–і—С—В—Б—П –≤—Л–±—А–∞—В—М 80% –Ј–∞–њ–Є—Б–µ–є –Є–Ј –±–Њ–ї—М—И–Њ–є —В–∞–±–ї–Є—Ж—Л, —В–Њ –њ–Њ–ї–љ—Л–є –њ—А–Њ—Б–Љ–Њ—В—А –Њ–њ—П—В—М –ґ–µ –њ–Њ–ї—Г—З–Є—В—Б—П –±—Л—Б—В—А–µ–µ.

–Я—А–Є —В–µ—Б—В–Є—А–Њ–≤–∞–љ–Є–Є –Ј–∞–њ—А–Њ—Б–Њ–≤ —Б –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ–Љ EXPLAIN ANALYZE –Љ–Њ–ґ–љ–Њ –≤–Њ—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М—Б—П –љ–∞—Б—В—А–Њ–є–Ї–∞–Љ–Є, –Ј–∞–њ—А–µ—Й–∞—О—Й–Є–Љ–Є –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А—Г –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –Њ–њ—А–µ–і–µ–ї—С–љ–љ—Л–µ –њ–ї–∞–љ—Л –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П. –Э–∞–њ—А–Є–Љ–µ—А,

SET enable_seqscan=false;

–Ј–∞–њ—А–µ—В–Є—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ –њ–Њ–ї–љ–Њ–≥–Њ –њ—А–Њ—Б–Љ–Њ—В—А–∞ —В–∞–±–ї–Є—Ж—Л, –Є –≤—Л —Б–Љ–Њ–ґ–µ—В–µ –≤—Л—П—Б–љ–Є—В—М, –њ—А–∞–≤ –ї–Є –±—Л–ї –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А, –Њ—В–Ї–∞–Ј—Л–≤–∞—П—Б—М –Њ—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є—П –Є–љ–і–µ–Ї—Б–∞. –Э–Є –≤ –Ї–Њ–µ–Љ —Б–ї—Г—З–∞–µ –љ–µ —Б–ї–µ–і—Г–µ—В –њ—А–Њ–њ–Є—Б—Л–≤–∞—В—М –њ–Њ–і–Њ–±–љ—Л–µ –Ї–Њ–Љ–∞–љ–і—Л –≤ postgresql.conf! –≠—В–Њ –Љ–Њ–ґ–µ—В —Г—Б–Ї–Њ—А–Є—В—М –≤—Л–њ–Њ–ї–љ–µ–љ–Є–µ –љ–µ—Б–Ї–Њ–ї—М–Ї–Є—Е –Ј–∞–њ—А–Њ—Б–Њ–≤, –љ–Њ —Б–Є–ї—М–љ–Њ –Ј–∞–Љ–µ–і–ї–Є—В –≤—Б–µ –Њ—Б—В–∞–ї—М–љ—Л–µ!

2 –Ш—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ —Б–Њ–±—А–∞–љ–љ–Њ–є —Б—В–∞—В–Є—Б—В–Є–Ї–Є

–†–µ–Ј—Г–ї—М—В–∞—В—Л —А–∞–±–Њ—В—Л —Б–±–Њ—А—Й–Є–Ї–∞ —Б—В–∞—В–Є—Б—В–Є–Ї–Є –і–Њ—Б—В—Г–њ–љ—Л —З–µ—А–µ–Ј —Б–њ–µ—Ж–Є–∞–ї—М–љ—Л–µ —Б–Є—Б—В–µ–Љ–љ—Л–µ –њ—А–µ–і—Б—В–∞–≤–ї–µ–љ–Є—П. –Э–∞–Є–±–Њ–ї–µ–µ –Є–љ—В–µ—А–µ—Б–љ—Л –і–ї—П –љ–∞—И–Є—Е —Ж–µ–ї–µ–є —Б–ї–µ–і—Г—О—Й–Є–µ:- pg_stat_user_tables —Б–Њ–і–µ—А–ґ–Є—В -- –і–ї—П –Ї–∞–ґ–і–Њ–є –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—М—Б–Ї–Њ–є —В–∞–±–ї–Є—Ж—Л –≤ —В–µ–Ї—Г—Й–µ–є –±–∞–Ј–µ –і–∞–љ–љ—Л—Е -- –Њ–±—Й–µ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ–Њ–ї–љ—Л—Е –њ—А–Њ—Б–Љ–Њ—В—А–Њ–≤ –Є –њ—А–Њ—Б–Љ–Њ—В—А–Њ–≤ —Б –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ–Љ –Є–љ–і–µ–Ї—Б–Њ–≤, –Њ–±—Й–Є–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ –Ј–∞–њ–Є—Б–µ–є, –Ї–Њ—В–Њ—А—Л–µ –±—Л–ї–Є –≤–Њ–Ј–≤—А–∞—Й–µ–љ—Л –≤ —А–µ–Ј—Г–ї—М—В–∞—В–µ –Њ–±–Њ–Є—Е —В–Є–њ–Њ–≤ –њ—А–Њ—Б–Љ–Њ—В—А–∞, –∞ —В–∞–Ї–ґ–µ –Њ–±—Й–Є–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ –≤—Б—В–∞–≤–ї–µ–љ–љ—Л—Е, –Є–Ј–Љ–µ–љ—С–љ–љ—Л—Е –Є —Г–і–∞–ї—С–љ–љ—Л—Е –Ј–∞–њ–Є—Б–µ–є.

- pg_stat_user_indexes —Б–Њ–і–µ—А–ґ–Є—В -- –і–ї—П –Ї–∞–ґ–і–Њ–≥–Њ –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—М—Б–Ї–Њ–≥–Њ –Є–љ–і–µ–Ї—Б–∞ –≤ —В–µ–Ї—Г—Й–µ–є –±–∞–Ј–µ –і–∞–љ–љ—Л—Е -- –Њ–±—Й–µ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ—А–Њ—Б–Љ–Њ—В—А–Њ–≤, –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–≤—И–Є—Е —Н—В–Њ—В –Є–љ–і–µ–Ї—Б, –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ—А–Њ—З–Є—В–∞–љ–љ—Л—Е –Ј–∞–њ–Є—Б–µ–є, –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ —Г—Б–њ–µ—И–љ–Њ –њ—А–Њ—З–Є—В–∞–љ–љ—Л—Е –Ј–∞–њ–Є—Б–µ–є –≤ —В–∞–±–ї–Є—Ж–µ (–Љ–Њ–ґ–µ—В –±—Л—В—М –Љ–µ–љ—М—И–µ –њ—А–µ–і—Л–і—Г—Й–µ–≥–Њ –Ј–љ–∞—З–µ–љ–Є—П, –µ—Б–ї–Є –≤ –Є–љ–і–µ–Ї—Б–µ –µ—Б—В—М –Ј–∞–њ–Є—Б–Є, —Г–Ї–∞–Ј—Л–≤–∞—О—Й–Є–µ –љ–∞ —Г—Б—В–∞—А–µ–≤—И–Є–µ –Ј–∞–њ–Є—Б–Є –≤ —В–∞–±–ї–Є—Ж–µ).

- pg_statio_user_tables —Б–Њ–і–µ—А–ґ–Є—В -- –і–ї—П –Ї–∞–ґ–і–Њ–є –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї—М—Б–Ї–Њ–є —В–∞–±–ї–Є—Ж—Л –≤ —В–µ–Ї—Г—Й–µ–є –±–∞–Ј–µ –і–∞–љ–љ—Л—Е -- –Њ–±—Й–µ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –±–ї–Њ–Ї–Њ–≤, –њ—А–Њ—З–Є—В–∞–љ–љ—Л—Е –Є–Ј —В–∞–±–ї–Є—Ж—Л, –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –±–ї–Њ–Ї–Њ–≤, –Њ–Ї–∞–Ј–∞–≤—И–Є—Е—Б—П –њ—А–Є —Н—В–Њ–Љ –≤ –±—Г—Д–µ—А–µ (—Б–Љ. –њ—Г–љ–Ї—В 2.1.1), –∞ —В–∞–Ї–ґ–µ –∞–љ–∞–ї–Њ–≥–Є—З–љ—Г—О —Б—В–∞—В–Є—Б—В–Є–Ї—Г –і–ї—П –≤—Б–µ—Е –Є–љ–і–µ–Ї—Б–Њ–≤ –њ–Њ —В–∞–±–ї–Є—Ж–µ –Є, –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ, –њ–Њ —Б–≤—П–Ј–∞–љ–љ–Њ–є —Б –љ–µ–є —В–∞–±–ї–Є—Ж–µ–є TOAST.

–Ш–Ј —Н—В–Є—Е –њ—А–µ–і—Б—В–∞–≤–ї–µ–љ–Є–є –Љ–Њ–ґ–љ–Њ —Г–Ј–љ–∞—В—М, –≤ —З–∞—Б—В–љ–Њ—Б—В–Є

- –Ф–ї—П –Ї–∞–Ї–Є—Е —В–∞–±–ї–Є—Ж —Б—В–Њ–Є—В —Б–Њ–Ј–і–∞—В—М –љ–Њ–≤—Л–µ –Є–љ–і–µ–Ї—Б—Л (–Є–љ–і–Є–Ї–∞—В–Њ—А–Њ–Љ —Б–ї—Г–ґ–Є—В –±–Њ–ї—М—И–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ–Њ–ї–љ—Л—Е –њ—А–Њ—Б–Љ–Њ—В—А–Њ–≤ –Є –±–Њ–ї—М—И–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –њ—А–Њ—З–Є—В–∞–љ–љ—Л—Е –±–ї–Њ–Ї–Њ–≤).

- –Ъ–∞–Ї–Є–µ –Є–љ–і–µ–Ї—Б—Л –≤–Њ–Њ–±—Й–µ –љ–µ –Є—Б–њ–Њ–ї—М–Ј—Г—О—В—Б—П –≤ –Ј–∞–њ—А–Њ—Б–∞—Е. –Ш—Е –Є–Љ–µ–µ—В —Б–Љ—Л—Б–ї —Г–і–∞–ї–Є—В—М, –µ—Б–ї–Є, –Ї–Њ–љ–µ—З–љ–Њ, —А–µ—З—М –љ–µ –Є–і—С—В –Њ–± –Є–љ–і–µ–Ї—Б–∞—Е, –Њ–±–µ—Б–њ–µ—З–Є–≤–∞—О—Й–Є—Е –≤—Л–њ–Њ–ї–љ–µ–љ–Є–µ –Њ–≥—А–∞–љ–Є—З–µ–љ–Є–є PRIMARY KEY –Є UNIQUE.

- –Ф–Њ—Б—В–∞—В–Њ—З–µ–љ –ї–Є –Њ–±—К—С–Љ –±—Г—Д–µ—А–∞ —Б–µ—А–≤–µ—А–∞.

–Ґ–∞–Ї–ґ–µ –≤–Њ–Ј–Љ–Њ–ґ–µ–љ «–і–µ–і—Г–Ї—В–Є–≤–љ—Л–є» –њ–Њ–і—Е–Њ–і, –њ—А–Є –Ї–Њ—В–Њ—А–Њ–Љ —Б–љ–∞—З–∞–ї–∞ —Б–Њ–Ј–і–∞—С—В—Б—П –±–Њ–ї—М—И–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –Є–љ–і–µ–Ї—Б–Њ–≤, –∞ –Ј–∞—В–µ–Љ –љ–µ–Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л–µ –Є–љ–і–µ–Ї—Б—Л —Г–і–∞–ї—П—О—В—Б—П.

3 –Т–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В–Є –Є–љ–і–µ–Ї—Б–Њ–≤ –≤ PostgreSQL

–§—Г–љ–Ї—Ж–Є–Њ–љ–∞–ї—М–љ—Л–µ –Є–љ–і–µ–Ї—Б—Л –Т—Л –Љ–Њ–ґ–µ—В–µ –њ–Њ—Б—В—А–Њ–Є—В—М –Є–љ–і–µ–Ї—Б –љ–µ —В–Њ–ї—М–Ї–Њ –њ–Њ –њ–Њ–ї—О/–љ–µ—Б–Ї–Њ–ї—М–Ї–Є–Љ –њ–Њ–ї—П–Љ —В–∞–±–ї–Є—Ж—Л, –љ–Њ –Є –њ–Њ –≤—Л—А–∞–ґ–µ–љ–Є—О, –Ј–∞–≤–Є—Б—П—Й–µ–Љ—Г –Њ—В –њ–Њ–ї–µ–є. –Я—Г—Б—В—М, –љ–∞–њ—А–Є–Љ–µ—А, –≤ –≤–∞—И–µ–є —В–∞–±–ї–Є—Ж–µ foo –µ—Б—В—М –њ–Њ–ї–µ foo_name, –Є –≤—Л–±–Њ—А–Ї–Є —З–∞—Б—В–Њ –і–µ–ї–∞—О—В—Б—П –њ–Њ —Г—Б–ї–Њ–≤–Є—О «–њ–µ—А–≤–∞—П –±—Г–Ї–≤–∞ foo_name = '–±—Г–Ї–≤–∞', –≤ –ї—О–±–Њ–Љ —А–µ–≥–Є—Б—В—А–µ». –Т—Л –Љ–Њ–ґ–µ—В–µ —Б–Њ–Ј–і–∞—В—М –Є–љ–і–µ–Ї—БCREATE INDEX foo_name_first_idx ON foo ((lower(substr(foo_name, 1, 1))));–Є –Ј–∞–њ—А–Њ—Б –≤–Є–і–∞

SELECT * FROM foo WHERE lower(substr(foo_name, 1, 1)) = '—Л';–±—Г–і–µ—В –µ–≥–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М.

–І–∞—Б—В–Є—З–љ—Л–µ –Є–љ–і–µ–Ї—Б—Л (partial indexes) –Я–Њ–і —З–∞—Б—В–Є—З–љ—Л–Љ –Є–љ–і–µ–Ї—Б–Њ–Љ –њ–Њ–љ–Є–Љ–∞–µ—В—Б—П –Є–љ–і–µ–Ї—Б —Б –њ—А–µ–і–Є–Ї–∞—В–Њ–Љ WHERE. –Я—Г—Б—В—М, –љ–∞–њ—А–Є–Љ–µ—А, —Г –≤–∞—Б –µ—Б—В—М –≤ –±–∞–Ј–µ —В–∞–±–ї–Є—Ж–∞ scheta —Б –њ–∞—А–∞–Љ–µ—В—А–Њ–Љ uplocheno —В–Є–њ–∞ boolean. –Ч–∞–њ–Є—Б–µ–є, –≥–і–µ uplocheno = false –Љ–µ–љ—М—И–µ, —З–µ–Љ –Ј–∞–њ–Є—Б–µ–є —Б uplocheno = true, –∞ –Ј–∞–њ—А–Њ—Б—Л –њ–Њ –љ–Є–Љ –≤—Л–њ–Њ–ї–љ—П—О—В—Б—П –Ј–љ–∞—З–Є—В–µ–ї—М–љ–Њ —З–∞—Й–µ. –Т—Л –Љ–Њ–ґ–µ—В–µ —Б–Њ–Ј–і–∞—В—М –Є–љ–і–µ–Ї—Б

CREATE INDEX scheta_neuplocheno ON scheta (id) WHERE NOT uplocheno;–Ї–Њ—В–Њ—А—Л–є –±—Г–і–µ—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М—Б—П –Ј–∞–њ—А–Њ—Б–Њ–Љ –≤–Є–і–∞

SELECT * FROM scheta WHERE NOT uplocheno AND ...;–Ф–Њ—Б—В–Њ–Є–љ—Б—В–≤–Њ –њ–Њ–і—Е–Њ–і–∞ –≤ —В–Њ–Љ, —З—В–Њ –Ј–∞–њ–Є—Б–Є, –љ–µ —Г–і–Њ–≤–ї–µ—В–≤–Њ—А—П—О—Й–Є–µ —Г—Б–ї–Њ–≤–Є—О WHERE, –њ—А–Њ—Б—В–Њ –љ–µ –њ–Њ–њ–∞–і—Г—В –≤ –Є–љ–і–µ–Ї—Б.

3 –Я–µ—А–µ–љ–Њ—Б –ї–Њ–≥–Є–Ї–Є –љ–∞ —Б—В–Њ—А–Њ–љ—Г —Б–µ—А–≤–µ—А–∞

–≠—В–Њ—В –њ—Г–љ–Ї—В –Њ—З–µ–≤–Є–і–µ–љ –і–ї—П –Њ–њ—Л—В–љ—Л—Е –њ–Њ–ї—М–Ј–Њ–≤–∞—В–µ–ї–µ–є PostrgeSQL –Є –њ—А–µ–і–љ–∞–Ј–љ–∞—З–µ–љ –і–ї—П —В–µ—Е, –Ї—В–Њ –Є—Б–њ–Њ–ї—М–Ј—Г–µ—В –Є–ї–Є –њ–µ—А–µ–љ–Њ—Б–Є—В –љ–∞ PostgreSQL –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П, –љ–∞–њ–Є—Б–∞–љ–љ—Л–µ –Є–Ј–љ–∞—З–∞–ї—М–љ–Њ –і–ї—П –±–Њ–ї–µ–µ –њ—А–Є–Љ–Є—В–Є–≤–љ—Л—Е –°–£–С–Ф.–†–µ–∞–ї–Є–Ј–∞—Ж–Є—П —З–∞—Б—В–Є –ї–Њ–≥–Є–Ї–Є –љ–∞ —Б—В–Њ—А–Њ–љ–µ —Б–µ—А–≤–µ—А–∞ —З–µ—А–µ–Ј —Е—А–∞–љ–Є–Љ—Л–µ –њ—А–Њ—Ж–µ–і—Г—А—Л, —В—А–Є–≥–≥–µ—А—Л, –њ—А–∞–≤–Є–ї–∞9 —З–∞—Б—В–Њ –њ–Њ–Ј–≤–Њ–ї—П–µ—В —Г—Б–Ї–Њ—А–Є—В—М —А–∞–±–Њ—В—Г –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П. –Ф–µ–є—Б—В–≤–Є—В–µ–ї—М–љ–Њ, –µ—Б–ї–Є –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ –Ј–∞–њ—А–Њ—Б–Њ–≤ –Њ–±—К–µ–і–Є–љ–µ–љ—Л –≤ –њ—А–Њ—Ж–µ–і—Г—А—Г, —В–Њ –љ–µ —В—А–µ–±—Г–µ—В—Б—П

- –њ–µ—А–µ—Б—Л–ї–Ї–∞ –њ—А–Њ–Љ–µ–ґ—Г—В–Њ—З–љ—Л—Е –Ј–∞–њ—А–Њ—Б–Њ–≤ –љ–∞ —Б–µ—А–≤–µ—А;

- –њ–Њ–ї—Г—З–µ–љ–Є–µ –њ—А–Њ–Љ–µ–ґ—Г—В–Њ—З–љ—Л—Е —А–µ–Ј—Г–ї—М—В–∞—В–Њ–≤ –љ–∞ –Ї–ї–Є–µ–љ—В –Є –Є—Е –Њ–±—А–∞–±–Њ—В–Ї–∞.

–Ъ—А–Њ–Љ–µ —В–Њ–≥–Њ, —Е—А–∞–љ–Є–Љ—Л–µ –њ—А–Њ—Ж–µ–і—Г—А—Л —Г–њ—А–Њ—Й–∞—О—В –њ—А–Њ—Ж–µ—Б—Б —А–∞–Ј—А–∞–±–Њ—В–Ї–Є –Є –њ–Њ–і–і–µ—А–ґ–Ї–Є: –Є–Ј–Љ–µ–љ–µ–љ–Є—П –љ–∞–і–Њ –≤–љ–Њ—Б–Є—В—М —В–Њ–ї—М–Ї–Њ –љ–∞ —Б—В–Њ—А–Њ–љ–µ —Б–µ—А–≤–µ—А–∞, –∞ –љ–µ –Љ–µ–љ—П—В—М –Ј–∞–њ—А–Њ—Б—Л –≤–Њ –≤—Б–µ—Е –њ—А–Є–ї–Њ–ґ–µ–љ–Є—П—Е.

4 –Ю–њ—В–Є–Љ–Є–Ј–∞—Ж–Є—П –Ї–Њ–љ–Ї—А–µ—В–љ—Л—Е –Ј–∞–њ—А–Њ—Б–Њ–≤

–Т —Н—В–Њ–Љ —А–∞–Ј–і–µ–ї–µ –Њ–њ–Є—Б—Л–≤–∞—О—В—Б—П –Ј–∞–њ—А–Њ—Б—Л, –і–ї—П –Ї–Њ—В–Њ—А—Л—Е –њ–Њ —А–∞–Ј–љ—Л–Љ –њ—А–Є—З–Є–љ–∞–Љ –љ–µ–ї—М–Ј—П –Ј–∞—Б—В–∞–≤–Є—В—М –Њ–њ—В–Є–Љ–Є–Ј–∞—В–Њ—А –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –Є–љ–і–µ–Ї—Б—Л, –Є –Ї–Њ—В–Њ—А—Л–µ –±—Г–і—Г—В –≤—Б–µ–≥–і–∞ –≤—Л–Ј—Л–≤–∞—В—М –њ–Њ–ї–љ—Л–є –њ—А–Њ—Б–Љ–Њ—В—А —В–∞–±–ї–Є—Ж—Л. –Ґ–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, –µ—Б–ї–Є –≤–∞–Љ —В—А–µ–±—Г–µ—В—Б—П –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М —Н—В–Є –Ј–∞–њ—А–Њ—Б—Л –≤ —В—А–µ–±–Њ–≤–∞—В–µ–ї—М–љ–Њ–Љ –Ї –±—Л—Б—В—А–Њ–і–µ–є—Б—В–≤–Є—О –њ—А–Є–ї–Њ–ґ–µ–љ–Є–Є, —В–Њ –њ—А–Є–і—С—В—Б—П –Є—Е –Є–Ј–Љ–µ–љ–Є—В—М.

1 SELECT count(*) FROM <–Њ–≥—А–Њ–Љ–љ–∞—П —В–∞–±–ї–Є—Ж–∞>

–§—Г–љ–Ї—Ж–Є—П count() —А–∞–±–Њ—В–∞–µ—В –Њ—З–µ–љ—М –њ—А–Њ—Б—В–Њ: —Б–љ–∞—З–∞–ї–∞ –≤—Л–±–Є—А–∞—О—В—Б—П –≤—Б–µ –Ј–∞–њ–Є—Б–Є, —Г–і–Њ–≤–ї–µ—В–≤–Њ—А—П—О—Й–Є–µ —Г—Б–ї–Њ–≤–Є—О, –∞ –њ–Њ—В–Њ–Љ –Ї –њ–Њ–ї—Г—З–µ–љ–љ–Њ–Љ—Г –љ–∞–±–Њ—А—Г –Ј–∞–њ–Є—Б–µ–є –њ—А–Є–Љ–µ–љ—П–µ—В—Б—П –∞–≥—А–µ–≥–∞—В–љ–∞—П —Д—Г–љ–Ї—Ж–Є—П -- —Б—З–Є—В–∞–µ—В—Б—П –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –≤—Л–±—А–∞–љ—Л—Е —Б—В—А–Њ–Ї. –Ш–љ—Д–Њ—А–Љ–∞—Ж–Є—П –Њ –≤–Є–і–Є–Љ–Њ—Б—В–Є –Ј–∞–њ–Є—Б–Є –і–ї—П —В–µ–Ї—Г—Й–µ–є —В—А–∞–љ–Ј–∞–Ї—Ж–Є–Є (–∞ –Ї–Њ–љ–Ї—Г—А–µ–љ—В–љ—Л–Љ —В—А–∞–љ–Ј–∞–Ї—Ж–Є—П–Љ –Љ–Њ–ґ–µ—В –±—Л—В—М –≤–Є–і–Є–Љ–Њ —А–∞–Ј–љ–Њ–µ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ –Ј–∞–њ–Є—Б–µ–є –≤ —В–∞–±–ї–Є—Ж–µ!) –љ–µ —Е—А–∞–љ–Є—В—Б—П –≤ –Є–љ–і–µ–Ї—Б–µ, –њ–Њ—Н—В–Њ–Љ—Г, –і–∞–ґ–µ –µ—Б–ї–Є –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –і–ї—П –≤—Л–њ–Њ–ї–љ–µ–љ–Є—П –Ј–∞–њ—А–Њ—Б–∞ –Є–љ–і–µ–Ї—Б –њ–µ—А–≤–Є—З–љ–Њ–≥–Њ –Ї–ї—О—З–∞ —В–∞–±–ї–Є—Ж—Л, –≤—Б—С —А–∞–≤–љ–Њ –њ–Њ—В—А–µ–±—Г–µ—В—Б—П —З—В–µ–љ–Є–µ –Ј–∞–њ–Є—Б–µ–є —Б–Њ–±—Б—В–≤–µ–љ–љ–Њ –Є–Ј —Д–∞–є–ї–∞ —В–∞–±–ї–Є—Ж—Л.

–Я—А–Њ–±–ї–µ–Љ–∞ –Ч–∞–њ—А–Њ—Б –≤–Є–і–∞

![\begin{lstlisting}[language=SQL,label=lst:sql_performance1,caption=SQL]

SELECT count(*) FROM foo;

\end{lstlisting}](postgresql-img4.png)

–Њ—Б—Г—Й–µ—Б—В–≤–ї—П–µ—В –њ–Њ–ї–љ—Л–є –њ—А–Њ—Б–Љ–Њ—В—А —В–∞–±–ї–Є—Ж—Л foo, —З—В–Њ –≤–µ—Б—М–Љ–∞ –і–Њ–ї–≥–Њ –і–ї—П —В–∞–±–ї–Є—Ж —Б –±–Њ–ї—М—И–Є–Љ –Ї–Њ–ї–Є—З–µ—Б—В–≤–Њ–Љ –Ј–∞–њ–Є—Б–µ–є.

–†–µ—И–µ–љ–Є–µ –Я—А–Њ—Б—В–Њ–≥–Њ —А–µ—И–µ–љ–Є—П –њ—А–Њ–±–ї–µ–Љ—Л, –Ї —Б–Њ–ґ–∞–ї–µ–љ–Є—О, –љ–µ—В. –Т–Њ–Ј–Љ–Њ–ґ–љ—Л —Б–ї–µ–і—Г- —О—Й–Є–µ –њ–Њ–і—Е–Њ–і—Л:

- –Х—Б–ї–Є —В–Њ—З–љ–Њ–µ —З–Є—Б–ї–Њ –Ј–∞–њ–Є—Б–µ–є –љ–µ –≤–∞–ґ–љ–Њ, –∞ –≤–∞–ґ–µ–љ –њ–Њ—А—П–і–Њ–Ї10, —В–Њ –Љ–Њ–ґ–љ–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—О –Њ –Ї–Њ–ї–Є—З–µ—Б—В–≤–µ

–Ј–∞–њ–Є—Б–µ–є –≤ —В–∞–±–ї–Є—Ж–µ, —Б–Њ–±—А–∞–љ–љ—Г—О –њ—А–Є –≤—Л–њ–Њ–ї–љ–µ–љ–Є–Є –Ї–Њ–Љ–∞–љ–і—Л ANALYZE:

![\begin{lstlisting}[language=SQL,label=lst:sql_performance2,caption=SQL]

SELECT reltuples FROM pg_class WHERE relname = 'foo';

\end{lstlisting}](postgresql-img5.png)

- –Х—Б–ї–Є –њ–Њ–і–Њ–±–љ—Л–µ –≤—Л–±–Њ—А–Ї–Є –≤—Л–њ–Њ–ї–љ—П—О—В—Б—П —З–∞—Б—В–Њ, –∞ –Є–Ј–Љ–µ–љ–µ–љ–Є—П –≤ —В–∞–±–ї–Є—Ж–µ –і–Њ—Б—В–∞—В–Њ—З–љ–Њ —А–µ–і–Ї–Є, —В–Њ –Љ–Њ–ґ–љ–Њ –Ј–∞–≤–µ—Б—В–Є –≤—Б–њ–Њ–Љ–Њ–≥–∞—В–µ–ї—М–љ—Г—О —В–∞–±–ї–Є—Ж—Г, —Е—А–∞–љ—П—Й—Г—О —З–Є—Б–ї–Њ –Ј–∞–њ–Є—Б–µ–є –≤ –Њ—Б–љ–Њ–≤–љ–Њ–є. –Э–∞ –Њ—Б–љ–Њ–≤–љ—Г—О –ґ–µ —В–∞–±–ї–Є—Ж—Г –њ–Њ–≤–µ—Б–Є—В—М —В—А–Є–≥–≥–µ—А, –Ї–Њ—В–Њ—А—Л–є –±—Г–і–µ—В —Г–Љ–µ–љ—М—И–∞—В—М —Н—В–Њ —З–Є—Б–ї–Њ –≤ —Б–ї—Г—З–∞–µ —Г–і–∞–ї–µ–љ–Є—П –Ј–∞–њ–Є—Б–Є –Є —Г–≤–µ–ї–Є—З–Є–≤–∞—В—М –≤ —Б–ї—Г—З–∞–µ –≤—Б—В–∞–≤–Ї–Є. –Ґ–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, –і–ї—П –њ–Њ–ї—Г—З–µ–љ–Є—П –Ї–Њ–ї–Є—З–µ—Б—В–≤–∞ –Ј–∞–њ–Є—Б–µ–є –њ–Њ—В—А–µ–±—Г–µ—В—Б—П –ї–Є—И—М –≤—Л–±—А–∞—В—М –Њ–і–љ—Г –Ј–∞–њ–Є—Б—М –Є–Ј –≤—Б–њ–Њ–Љ–Њ–≥–∞—В–µ–ї—М–љ–Њ–є —В–∞–±–ї–Є—Ж—Л.

- –Т–∞—А–Є–∞–љ—В –њ—А–µ–і—Л–і—Г—Й–µ–≥–Њ –њ–Њ–і—Е–Њ–і–∞, –љ–Њ –і–∞–љ–љ—Л–µ –≤–Њ –≤—Б–њ–Њ–Љ–Њ–≥–∞—В–µ–ї—М–љ–Њ–є —В–∞–±–ї–Є—Ж–µ –Њ–±–љ–Њ–≤–ї—П—О—В—Б—П —З–µ—А–µ–Ј –Њ–њ—А–µ–і–µ–ї—С–љ–љ—Л–µ –њ—А–Њ–Љ–µ–ґ—Г—В–Ї–Є –≤—А–µ–Љ–µ–љ–Є (cron).

2 –Ь–µ–і–ї–µ–љ—Л–є DISTINCT

–Ґ–µ–Ї—Г—Й–∞—П —А–µ–∞–ї–Є–Ј–∞—Ж–Є—П DISTINCT –і–ї—П –±–Њ–ї—М—И–Є—Е —В–∞–±–ї–Є—Ж –Њ—З–µ–љ—М –Љ–µ–і–ї–µ–љ–љ–∞. –Э–Њ –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М GROUP BY –≤–Ј–∞–Љ–µ–љ DISTINCT. GROUP BY –Љ–Њ–ґ–µ—В –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞—В—М –∞–≥—А–µ–≥–Є—А—Г—О—Й–Є–є —Е—Н—И, —З—В–Њ –Ј–љ–∞—З–Є—В–µ–ї—М–љ–Њ –±—Л—Б—В—А–µ–µ, —З–µ–Љ DISTINCT.

![\begin{lstlisting}[language=SQL,label=lst:sql_performance3,caption=DISTINCT]

pos...

... from g) a;

count

-------

19125

(1 row)

\par

Time: 36,281 ms

\end{lstlisting}](postgresql-img6.png)

![\begin{lstlisting}[language=SQL,label=lst:sql_performance4,caption=GROUP BY]

pos...

... i) a;

count

-------

19125

(1 row)

\par

Time: 25,270 ms

\par

\end{lstlisting}](postgresql-img7.png)

5 –Ю–њ—В–Є–Љ–Є–Ј–∞—Ж–Є—П –Ј–∞–њ—А–Њ—Б–Њ–≤ —Б –њ–Њ–Љ–Њ—Й—М—О pgFouine

pgFouine11 -- —Н—В–Њ –∞–љ–∞–ї–Є–Ј–∞—В–Њ—А log-—Д–∞–є–ї–Њ–≤ –і–ї—П PostgreSQL, –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л–є –і–ї—П –≥–µ–љ–µ—А–∞—Ж–Є–Є –і–µ—В–∞–ї—М–љ—Л—Е –Њ—В—З–µ—В–Њ–≤ –Є–Ј log-—Д–∞–є–ї–Њ–≤ PostgreSQL. pgFouine –њ–Њ–Љ–Њ–ґ–µ—В –Њ–њ—А–µ–і–µ–ї–Є—В—М, –Ї–∞–Ї–Є–µ –Ј–∞–њ—А–Њ—Б—Л —Б–ї–µ–і—Г–µ—В –Њ–њ—В–Є–Љ–Є–Ј–Є—А–Њ–≤–∞—В—М –≤ –њ–µ—А–≤—Г—О –Њ—З–µ—А–µ–і—М. pgFouine –љ–∞–њ–Є—Б–∞–љ –љ–∞ —П–Ј—Л–Ї–µ –њ—А–Њ–≥—А–∞–Љ–Љ–Є—А–Њ–≤–∞–љ–Є—П PHP —Б –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–µ–Љ –Њ–±—К–µ–Ї—В–љ–Њ-–Њ—А–Є–µ–љ—В–Є—А–Њ–≤–∞–љ–љ—Л—Е —В–µ—Е–љ–Њ–ї–Њ–≥–Є–є –Є –ї–µ–≥–Ї–Њ —А–∞—Б—И–Є—А—П–µ—В—Б—П –і–ї—П –њ–Њ–і–і–µ—А–ґ–Ї–Є —Б–њ–µ—Ж–Є–∞–ї–Є–Ј–Є—А–Њ–≤–∞–љ–љ—Л—Е –Њ—В—З–µ—В–Њ–≤, —П–≤–ї—П–µ—В—Б—П —Б–≤–Њ–±–Њ–і–љ—Л–Љ –њ—А–Њ–≥—А–∞–Љ–Љ–љ—Л–Љ –Њ–±–µ—Б–њ–µ—З–µ–љ–Є–µ–Љ –Є —А–∞—Б–њ—А–Њ—Б—В—А–∞–љ—П–µ—В—Б—П –љ–∞ —Г—Б–ї–Њ–≤–Є—П—Е GNU General Public License. –£—В–Є–ї–Є—В–∞ —Б–њ—А–Њ–µ–Ї—В–Є—А–Њ–≤–∞–љ–∞ —В–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, —З—В–Њ–±—Л –Њ–±—А–∞–±–Њ—В–Ї–∞ –Њ—З–µ–љ—М –±–Њ–ї—М—И–Є—Е log-—Д–∞–є–ї–Њ–≤ –љ–µ —В—А–µ–±–Њ–≤–∞–ї–∞ –Љ–љ–Њ–≥–Њ —А–µ—Б—Г—А—Б–Њ–≤.–Ф–ї—П —А–∞–±–Њ—В—Л —Б pgFouine —Б–љ–∞—З–∞–ї–∞ –љ—Г–ґ–љ–Њ —Б–Ї–Њ–љ—Д–Є–≥—Г—А–Є—А–Њ–≤–∞—В—М PostgreSQL –і–ї—П —Б–Њ–Ј–і–∞–љ–Є—П –љ—Г–ґ–љ–Њ–≥–Њ —Д–Њ—А–Љ–∞—В–∞ log-—Д–∞–є–ї–Њ–≤:

- –І—В–Њ–±—Л –≤–Ї–ї—О—З–Є—В—М –њ—А–Њ—В–Њ–Ї–Њ–ї–Є—А–Њ–≤–∞–љ–Є–µ –≤ syslog

![\begin{lstlisting}[label=lst:sql_performance5,caption=pgFouine]

log_destination = 'syslog'

redirect_stderr = off

silent_mode = on

\end{lstlisting}](postgresql-img8.png)

- –Ф–ї—П –Ј–∞–њ–Є—Б–Є –Ј–∞–њ—А–Њ—Б–Њ–≤, –і–ї—П—Й–Є—Е—Б—П –і–Њ–ї—М—И–µ n –Љ–Є–ї–ї–Є—Б–µ–Ї—Г–љ–і:

![\begin{lstlisting}[label=lst:sql_performance6,caption=pgFouine]

log_min_duration_statement = n

log_duration = off

log_statement = 'none'

\end{lstlisting}](postgresql-img9.png)

–Ф–ї—П –Ј–∞–њ–Є—Б–Є –Ї–∞–ґ–і–Њ–≥–Њ –Њ–±—А–∞–±–Њ—В–∞–љ–љ–Њ–≥–Њ –Ј–∞–њ—А–Њ—Б–∞ —Г—Б—В–∞–љ–Њ–≤–Є—В–µ log_min_duration_statement –љ–∞ 0. –І—В–Њ–±—Л –Њ—В–Ї–ї—О—З–Є—В—М –Ј–∞–њ–Є—Б—М –Ј–∞–њ—А–Њ—Б–Њ–≤, —Г—Б—В–∞–љ–Њ–≤–Є—В–µ —Н—В–Њ—В –њ–∞—А–∞–Љ–µ—В—А –љ–∞ -1.

pgFouine -- –њ—А–Њ—Б—В–Њ–є –≤ –Є—Б–њ–Њ–ї—М–Ј–Њ–≤–∞–љ–Є–Є –Є–љ—Б—В—А—Г–Љ–µ–љ—В –Ї–Њ–Љ–∞–љ–і–љ–Њ–є —Б—В—А–Њ–Ї–Є. –°–ї–µ–і—Г—О—Й–∞—П –Ї–Њ–Љ–∞–љ–і–∞ —Б–Њ–Ј–і–∞—С—В

HTML-–Њ—В—З—С—В —Б–Њ —Б—В–∞–љ–і–∞—А—В–љ—Л–Љ–Є –њ–∞—А–∞–Љ–µ—В—А–∞–Љ–Є:

![\begin{lstlisting}[label=lst:sql_performance7,caption=pgFouine]

pgfouine.php -file your/log/file.log > your-report.html

\end{lstlisting}](postgresql-img10.png)

–° –њ–Њ–Љ–Њ—Й—М—О —Н—В–Њ–є —Б—В—А–Њ–Ї–Є –Љ–Њ–ґ–љ–Њ –Њ—В–Њ–±—А–∞–Ј–Є—В—М —В–µ–Ї—Б—В–Њ–≤—Л–є –Њ—В—З—С—В —Б 10 –Ј–∞–њ—А–Њ—Б–∞–Љ–Є –љ–∞ –Ї–∞–ґ–і—Л–є —Н–Ї—А–∞–љ –љ–∞ —Б—В–∞–љ–і–∞—А—В–љ–Њ–Љ –≤—Л–≤–Њ–і–µ:

![\begin{lstlisting}[label=lst:sql_performance8,caption=pgFouine]

pgfouine.php -file your/log/file.log -top 10 -format text

\end{lstlisting}](postgresql-img11.png)

–С–Њ–ї–µ–µ –њ–Њ–і—А–Њ–±–љ–Њ –Њ –≤–Њ–Ј–Љ–Њ–ґ–љ–Њ—Б—В—П—Е, –∞ —В–∞–Ї–ґ–µ –Љ–љ–Њ–≥–Њ –њ–Њ–ї–µ–Ј–љ—Л—Е –њ—А–Є–Љ–µ—А–Њ–≤, –Љ–Њ–ґ–љ–Њ –љ–∞–є—В–Є –љ–∞ –Њ—Д–Є—Ж–Є–∞–ї—М–љ–Њ–Љ —Б–∞–є—В–∞ –њ—А–Њ–µ–Ї—В–∞ -- http://pgfouine.projects.postgresql.org.

7 –Ч–∞–Ї–ї—О—З–µ–љ–Є–µ

–Ъ —Б—З–∞—Б—В—М—О, PostgreSQL –љ–µ —В—А–µ–±—Г–µ—В –Њ—Б–Њ–±–Њ —Б–ї–Њ–ґ–љ–Њ–є –љ–∞—Б—В—А–Њ–є–Ї–Є. –Т –±–Њ–ї—М—И–Є–љ—Б—В–≤–µ —Б–ї—Г—З–∞–µ–≤ –≤–њ–Њ–ї–љ–µ –і–Њ—Б—В–∞—В–Њ—З–љ–Њ –±—Г–і–µ—В —Г–≤–µ–ї–Є—З–Є—В—М –Њ–±—К—С–Љ –≤—Л–і–µ–ї–µ–љ–љ–Њ–є –њ–∞–Љ—П—В–Є, –љ–∞—Б—В—А–Њ–Є—В—М –њ–µ—А–Є–Њ–і–Є—З–µ—Б–Ї–Њ–µ –њ–Њ–і–і–µ—А–ґ–∞–љ–Є–µ –±–∞–Ј—Л –≤ –њ–Њ—А—П–і–Ї–µ –Є –њ—А–Њ–≤–µ—А–Є—В—М –љ–∞–ї–Є—З–Є–µ –љ–µ–Њ–±—Е–Њ–і–Є–Љ—Л—Е –Є–љ–і–µ–Ї—Б–Њ–≤. –С–Њ–ї–µ–µ —Б–ї–Њ–ґ–љ—Л–µ –≤–Њ–њ—А–Њ—Б—Л –Љ–Њ–ґ–љ–Њ –Њ–±—Б—Г–і–Є—В—М –≤ —Б–њ–µ—Ж–Є–∞–ї–Є–Ј–Є—А–Њ–≤–∞–љ–љ–Њ–Љ —Б–њ–Є—Б–Ї–µ —А–∞—Б—Б—Л–ї–Ї–Є.3 –Я–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ

1 –Т–≤–µ–і–µ–љ–Є–µ

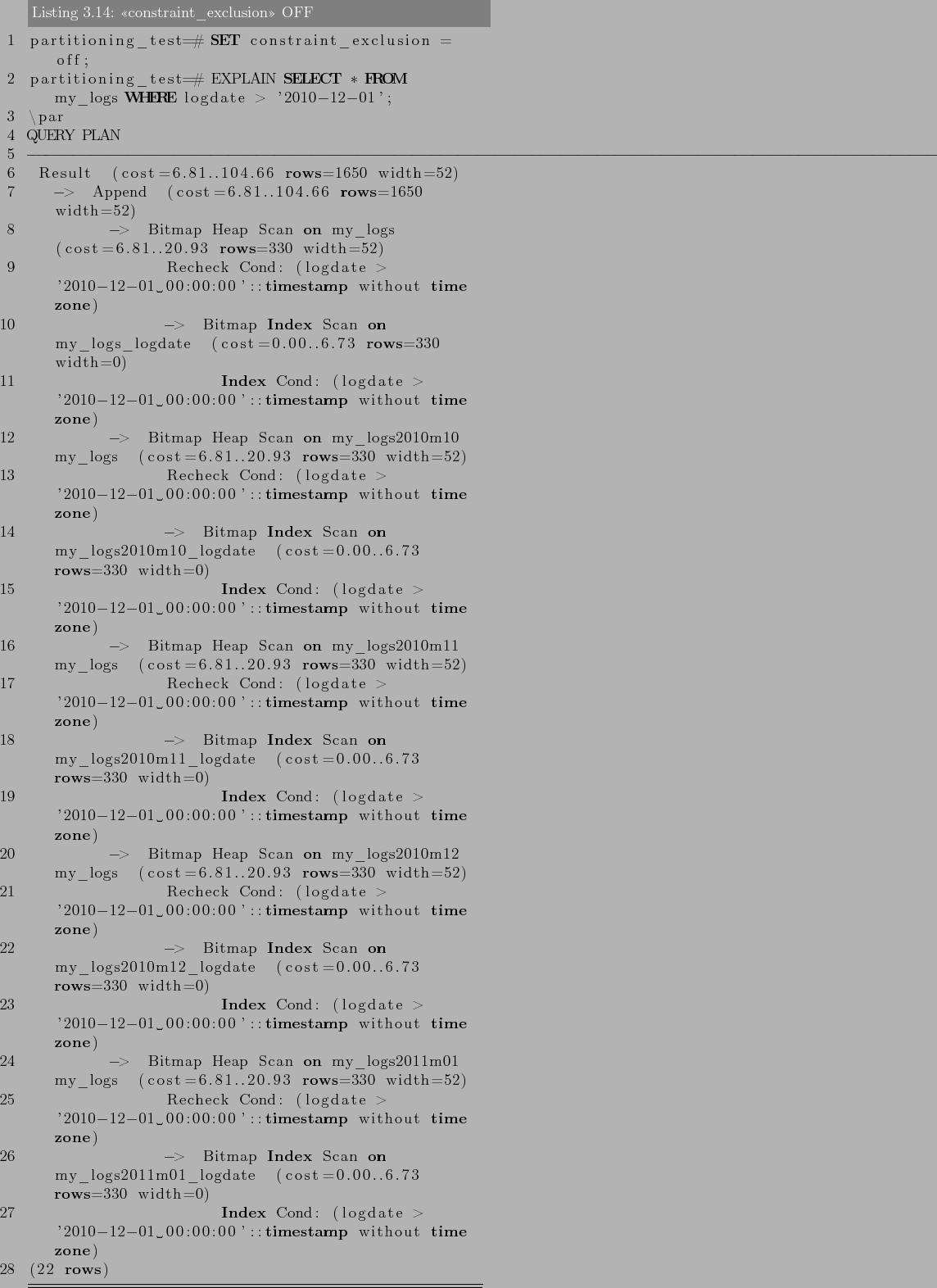

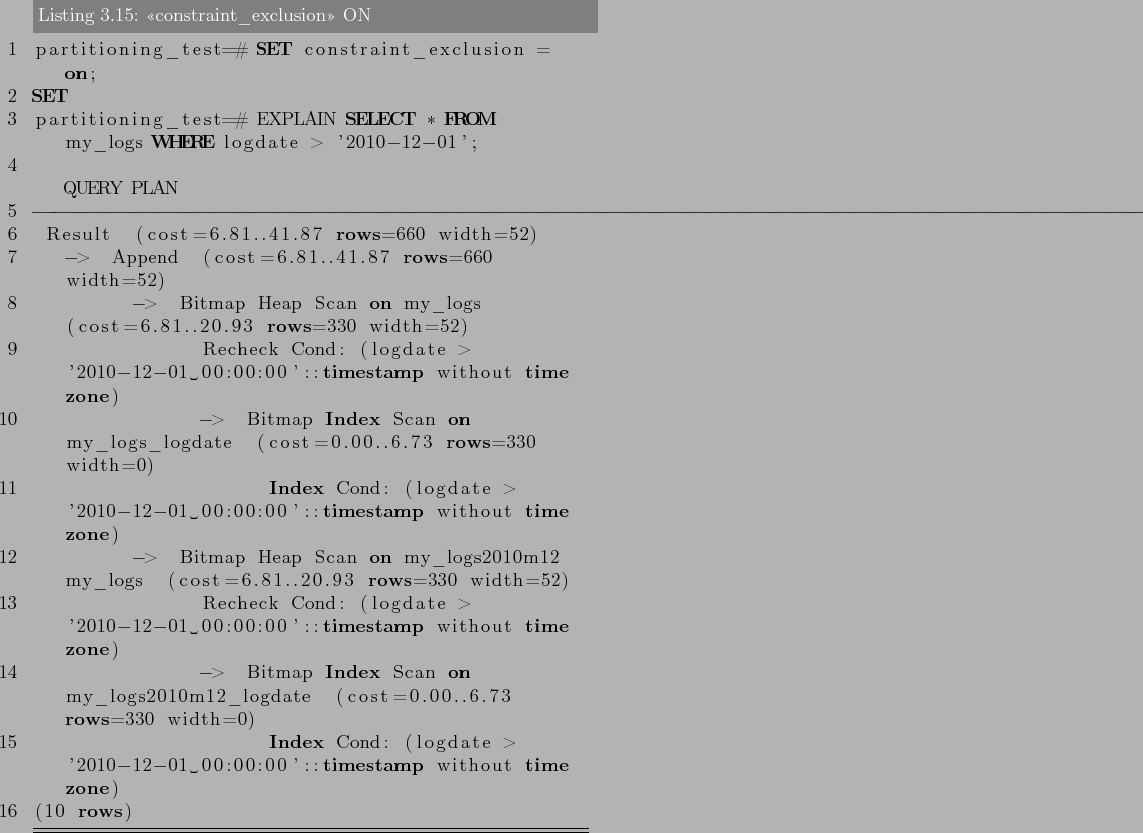

–Я–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ (partitioning, —Б–µ–Ї—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ) -- —Н—В–Њ —А–∞–Ј–±–Є–µ–љ–Є–µ –±–Њ–ї—М—И–Є—Е —Б—В—А—Г–Ї—В—Г—А –±–∞–Ј –і–∞–љ–љ—Л—Е (—В–∞–±–ї–Є—Ж—Л, –Є–љ–і–µ–Ї—Б—Л) —А–∞–Ј–±–Є—В—М –љ–∞ –Љ–µ–љ—М—И–Є–µ –Ї—Г—Б–Њ—З–Ї–Є. –Ч–≤—Г—З–Є—В —Б–ї–Њ–ґ–љ–Њ, –љ–Њ –љ–∞ –њ—А–∞–Ї—В–Є–Ї–µ –≤—Б–µ –њ—А–Њ—Б—В–Њ.–°–Ї–Њ—А–µ–µ –≤—Б–µ–≥–Њ —Г –Т–∞—Б –µ—Б—В—М –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ –Њ–≥—А–Њ–Љ–љ—Л—Е —В–∞–±–ї–Є—Ж (–Њ–±—Л—З–љ–Њ –≤—Б—О –љ–∞–≥—А—Г–Ј–Ї—Г –Њ–±–µ—Б–њ–µ—З–Є–≤–∞—О—В –≤—Б–µ–≥–Њ –љ–µ—Б–Ї–Њ–ї—М–Ї–Њ —В–∞–±–ї–Є—Ж –°–£–С–Ф –Є–Ј –≤—Б–µ—Е –Є–Љ–µ—О—Й–Є—Е—Б—П). –Я—А–Є—З–µ–Љ —З—В–µ–љ–Є–µ –≤ –±–Њ–ї—М—И–Є–љ—Б—В–≤–µ —Б–ї—Г—З–∞–µ–≤ –њ—А–Є—Е–Њ–і–Є—В—Б—П —В–Њ–ї—М–Ї–Њ –љ–∞ —Б–∞–Љ—Г—О –њ–Њ—Б–ї–µ–і–љ—О—О –Є—Е —З–∞—Б—В—М (—В.–µ. –∞–Ї—В–Є–≤–љ–Њ —З–Є—В–∞—О—В—Б—П —В–µ –і–∞–љ–љ—Л–µ, –Ї–Њ—В–Њ—А—Л–µ –љ–µ–і–∞–≤–љ–Њ –њ–Њ—П–≤–Є–ї–Є—Б—М). –Я—А–Є–Љ–µ—А–Њ–Љ —В–Њ–Љ—Г –Љ–Њ–ґ–µ—В —Б–ї—Г–ґ–Є—В—М –±–ї–Њ–≥ -- –љ–∞ –њ–µ—А–≤—Г—О —Б—В—А–∞–љ–Є—Ж—Г (—Н—В–Њ –њ–Њ—Б–ї–µ–і–љ–Є–µ 5...10 –њ–Њ—Б—В–Њ–≤) –њ—А–Є—Е–Њ–і–Є—В—Б—П 40...50% –≤—Б–µ–є –љ–∞–≥—А—Г–Ј–Ї–Є, –Є–ї–Є –љ–Њ–≤–Њ—Б—В–љ–Њ–є –њ–Њ—А—В–∞–ї (—Б—Г—В—М –Њ–і–љ–∞ –Є —В–∞ –ґ–µ), –Є–ї–Є —Б–Є—Б—В–µ–Љ—Л –ї–Є—З–љ—Л—Е —Б–Њ–Њ–±—Й–µ–љ–Є–євА¶ –≤–њ—А–Њ—З–µ–Љ –њ–Њ–љ—П—В–љ–Њ. –Я–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ —В–∞–±–ї–Є—Ж—Л –њ–Њ–Ј–≤–Њ–ї—П–µ—В –±–∞–Ј–µ –і–∞–љ–љ—Л—Е –і–µ–ї–∞—В—М –Є–љ—В–µ–ї–ї–µ–Ї—В—Г–∞–ї—М–љ—Г—О –≤—Л–±–Њ—А–Ї—Г -- —Б–љ–∞—З–∞–ї–∞ –°–£–С–Ф —Г—В–Њ—З–љ–Є—В, –Ї–∞–Ї–Њ–є –њ–∞—А—В–Є—Ж–Є–Є —Б–Њ–Њ—В–≤–µ—В—Б—В–≤—Г–µ—В –Т–∞—И –Ј–∞–њ—А–Њ—Б (–µ—Б–ї–Є —Н—В–Њ —А–µ–∞–ї—М–љ–Њ) –Є —В–Њ–ї—М–Ї–Њ –њ–Њ—В–Њ–Љ —Б–і–µ–ї–∞–µ—В —Н—В–Њ—В –Ј–∞–њ—А–Њ—Б, –њ—А–Є–Љ–µ–љ–Є—В–µ–ї—М–љ–Њ –Ї –љ—Г–ґ–љ–Њ–є –њ–∞—А—В–Є—Ж–Є–Є (–Є–ї–Є –љ–µ—Б–Ї–Њ–ї—М–Ї–Є–Љ –њ–∞—А—В–Є—Ж–Є—П–Љ). –Ґ–∞–Ї–Є–Љ –Њ–±—А–∞–Ј–Њ–Љ, –≤ —А–∞—Б—Б–Љ–Њ—В—А–µ–љ–љ–Њ–Љ —Б–ї—Г—З–∞–µ, –Т—Л —А–∞—Б–њ—А–µ–і–µ–ї–Є—В–µ –љ–∞–≥—А—Г–Ј–Ї—Г –љ–∞ —В–∞–±–ї–Є—Ж—Г –њ–Њ –µ–µ –њ–∞—А—В–Є—Ж–Є—П–Љ. –°–ї–µ–і–Њ–≤–∞—В–µ–ї—М–љ–Њ –≤—Л–±–Њ—А–Ї–∞ —В–Є–њ–∞ «SELECT * FROM articles ORDER BY id DESC LIMIT 10» –±—Г–і–µ—В –≤—Л–њ–Њ–ї–љ—П—В—М—Б—П —В–Њ–ї—М–Ї–Њ –љ–∞–і –њ–Њ—Б–ї–µ–і–љ–µ–є –њ–∞—А—В–Є—Ж–Є–µ–є, –Ї–Њ—В–Њ—А–∞—П –Ј–љ–∞—З–Є—В–µ–ї—М–љ–Њ –Љ–µ–љ—М—И–µ –≤—Б–µ–є —В–∞–±–ї–Є—Ж—Л.

–Ш—В–∞–Ї, –њ–∞—А—В–Є—Ж–Є–Њ–љ–Є—А–Њ–≤–∞–љ–Є–µ –і–∞–µ—В —А—П–і –њ—А–µ–Є–Љ—Г—Й–µ—Б—В–≤:

- –Э–∞ –Њ–њ—А–µ–і–µ–ї–µ–љ–љ—Л–µ –≤–Є–і—Л –Ј–∞–њ—А–Њ—Б–Њ–≤ (–Ї–Њ—В–Њ—А—Л–µ, –≤ —Б–≤–Њ—О –Њ—З–µ—А–µ–і—М, —Б–Њ–Ј–і–∞—О—В –Њ—Б–љ–Њ–≤–љ—Г—О –љ–∞–≥—А—Г–Ј–Ї—Г –љ–∞ –°–£–С–Ф) –Љ—Л –Љ–Њ–ґ–µ–Љ —Г–ї—Г—З—И–Є—В—М –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї—М–љ–Њ—Б—В—М.

- –Ь–∞—Б—Б–Њ–≤–Њ–µ —Г–і–∞–ї–µ–љ–Є–µ –Љ–Њ–ґ–µ—В –±—Л—В—М –њ—А–Њ–Є–Ј–≤–µ–і–µ–љ–Њ –њ—Г—В–µ–Љ —Г–і–∞–ї–µ–љ–Є—П –Њ–і–љ–Њ–є –Є–ї–Є –љ–µ—Б–Ї–Њ–ї—М–Ї–Є—Е –њ–∞—А—В–Є—Ж–Є–є (DROP TABLE –≥–Њ—А–∞–Ј–і–Њ –±—Л—Б—В—А–µ–µ, —З–µ–Љ –Љ–∞—Б—Б–Њ–≤—Л–є DELETE).

- –†–µ–і–Ї–Њ –Є—Б–њ–Њ–ї—М–Ј—Г–µ–Љ—Л–µ –і–∞–љ–љ—Л–µ –Љ–Њ–≥—Г—В –±—Л—В—М –њ–µ—А–µ–љ–µ—Б–µ–љ—Л –≤ –і—А—Г–≥–Њ–µ —Е—А–∞–љ–Є–ї–Є—Й–µ.

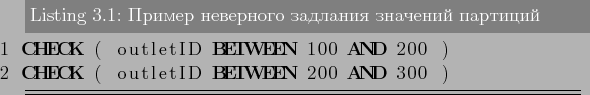

2 –Ґ–µ–Њ—А–Є—П